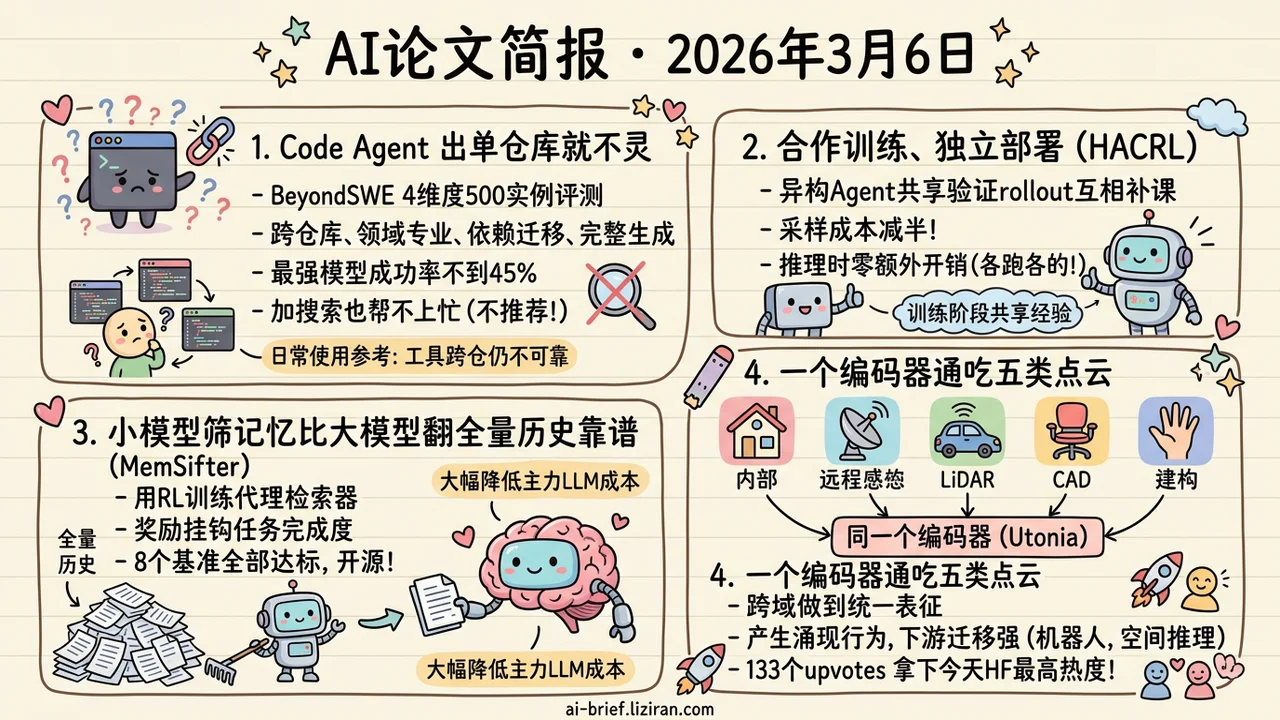

今日概览

- Code agent出了单仓库就不灵,BeyondSWE四维度500实例评测,最强模型成功率不到45%,加搜索也帮不上忙

- 合作训练、独立部署:HACRL让异构agent共享验证rollout互相补课。采样成本减半,推理时零额外开销

- 小模型筛记忆比大模型翻全量历史更靠谱——MemSifter用RL训练代理检索器,奖励直接挂钩任务完成度,8个基准全部达标

- 一个编码器通吃五类点云。Utonia在密度和几何特性完全不同的五个域做到统一表征,133个upvotes拿下今天HF最高热度

重点关注

01 代码智能 SWE-bench只测了code agent能力的一个切面

当前主流的code agent评测几乎只覆盖一种场景:单仓库bug修复。BeyondSWE把评测范围扩展到四个方向——跨仓库推理、领域专业问题、依赖驱动迁移和完整仓库生成,用500个真实实例勾勒出更完整的能力画像。结果不意外但值得重视:即使是最强的前沿模型,成功率也停留在45%以下,且没有任何一个模型能在所有任务类型上保持一致表现。研究者还构建了SearchSWE框架,测试给agent加上深度搜索能力能否改善表现——结论是效果不稳定,某些情况下搜索反而拉低了成绩。这说明开发者在写代码时那种搜索与推理交替进行的工作流,目前的agent还远没学会。对日常使用code agent的团队来说,这份评测提供了一个实用参考:知道你的工具在跨仓库协作和大规模代码生成上还不可靠,能帮你更好地规划人机协作的边界。

原文:BeyondSWE: Can Current Code Agent Survive Beyond Single-Repo Bug Fixing?

02 训练优化 别人做对的题,为什么不拿来用?

不同模型犯的错不一样——A解不出的数学题,B可能轻松搞定,反过来也成立。HACRL抓住了这个直觉:既然各家agent的rollout已经产生了,为什么不互相共享验证过的成功经验?具体做法是在训练阶段让异构agent(不同架构、不同规模)共享验证通过的rollout,通过HACPO算法解决策略分布偏移问题,保证优势估计无偏。关键在于推理时完全独立——不需要协调部署,不需要多模型联动,每个agent各跑各的,但训练时已经「偷学」了彼此的长处。实验显示平均比GSPO高3.3%,而rollout采样成本只有一半,92个HF upvotes说明社区对这种「合作训练、独立部署」的范式很感兴趣。

原文:Heterogeneous Agent Collaborative Reinforcement Learning

03 检索 用小模型做记忆筛选,成本和准确率两全

Agent跑得越久,积累的历史记忆越多,检索就越成问题:让主力LLM处理全部记忆太贵太慢,建索引(如记忆图谱)计算量大还容易丢信息。MemSifter加了一个小模型当「筛选层」——先推理当前任务需要什么,再从记忆库中精准召回给主力LLM。训练方式比较务实:用RL,奖励信号直接挂钩主力LLM拿到检索结果后的任务完成度,而不是传统的检索相关性指标。在8个记忆基准上(包括Deep Research任务),检索准确率和任务完成度均达到或超过现有方案,索引阶段几乎零额外计算,模型权重和代码已开源。

原文:MemSifter: Offloading LLM Memory Retrieval via Outcome-Driven Proxy Reasoning

04 模型架构 五种几何特性完全不同的点云,一个编码器真能通吃?

点云数据一直是「各管各的」——遥感、LiDAR、室内RGB-D、CAD模型、视频重建,每种的密度、几何结构和先验差异巨大,没人指望一个模型全搞定。Utonia偏要试:用同一个自监督点云Transformer编码器跨五个域训练,结果不仅没有互相拖后腿,统一表征反而带来了单域训练看不到的涌现行为。更实用的是下游迁移效果:把Utonia特征接到视觉-语言-动作策略上,机器人操作任务有提升;接到VLM(视觉语言模型)上,空间推理也变强了。NLP早就走过了「统一预训练表征」这条路,点云领域现在可能正站在同样的起跑线上——133个upvotes拿下今天HF最高热度,说明做3D和具身智能的团队已经在关注了。

也值得关注

今日观察

今天三篇独立工作不约而同指向了同一个问题:从「单一任务做得好」到「跨场景泛化」之间的鸿沟,靠堆参数量填不平。

BeyondSWE的数据最直接——code agent在SWE-bench式的单仓库bug修复上已经很强,但换到跨仓库推理和依赖迁移,成功率断崖式下跌到45%以下。能力没有自动迁移,搜索增强也救不回来。Utonia从正面证明这个gap可以被显式设计解决:同一个点云编码器跨遥感、LiDAR、室内、CAD、视频重建五个域做到一致表征,关键不是更大的模型或更多数据,而是重新设计了跨域一致性的学习目标。HACRL提供了第三个视角:让不同架构的agent互相共享验证过的训练经验,用协作机制绕过单一模型的泛化天花板,采样成本还减了一半。

三篇的共同信号:扩展能力边界的杠杆可能不在模型规模,而在训练范式和评估维度的重新设计。如果你在用code agent做超出单仓库修复的工作,BeyondSWE的四维度评测框架值得拿来审视一下自己团队的实际使用场景——知道工具的能力边界在哪,比盲目信任更有价值。