今日概览

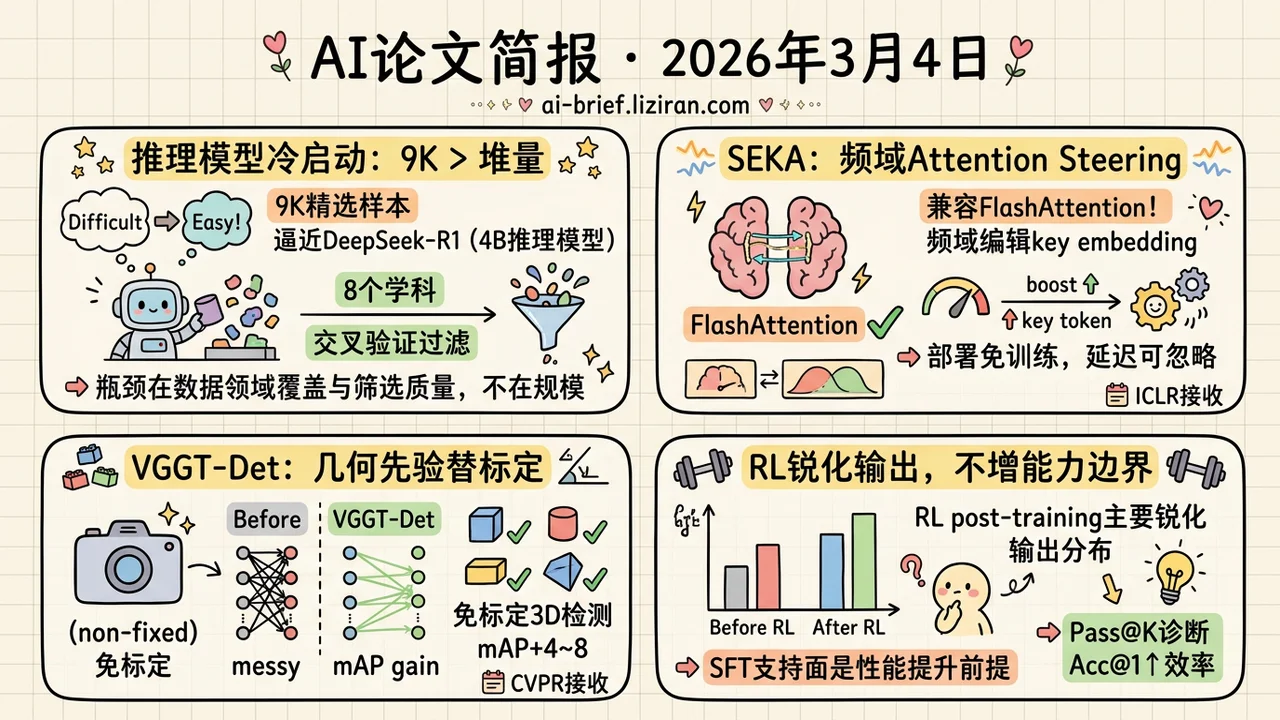

- 9K精选样本训出逼近DeepSeek-R1的4B推理模型,CHIMERA证明推理训练的真正瓶颈在数据的领域覆盖和筛选质量,不在规模

- Attention steering第一次能进生产部署:SEKA在频域编辑key embedding绕开FlashAttention兼容性限制,训练免、延迟可忽略。ICLR接收

- 基础视觉模型的几何先验强到可以替代传感器标定。VGGT-Det在免标定3D检测上比前最优高出4-8个mAP,CVPR接收

- RL post-training主要锐化输出分布,不扩展能力边界,控制变量实验显示SFT的支持面才是性能提升的前提

重点关注

01 推理 9K条数据训出的4B模型,凭什么接近DeepSeek-R1?

想训一个能推理的模型,第一步就卡住:你需要长链思维(CoT)轨迹做训练数据,但生成靠谱的CoT轨迹本身就需要一个会推理的模型。这个冷启动困境之外还有两个痛点——开源推理数据集几乎全是数学题,领域覆盖严重偏科;难题的人工标注成本高到不可行。CHIMERA的思路是用现有最强推理模型合成种子数据,但核心贡献不在「合成」本身,而是一套完整的数据工程方案:构建覆盖8个学科、1000+细粒度主题的层级分类法来确保领域均衡;用强模型交叉验证来过滤问题有效性和答案正确性。最终只保留9K条样本——用这些数据post-train的4B Qwen3模型在GPQA-Diamond、AIME 24/25/26等基准上接近或持平DeepSeek-R1和Qwen3-235B。9K条够用这件事反过来说明,推理训练的真正瓶颈在数据的覆盖度和筛选质量,不在规模。对想做推理训练但缺乏数据积累的团队,这是一条门槛显著降低的可复现路径。

原文:CHIMERA: Compact Synthetic Data for Generalizable LLM Reasoning

02 模型架构 Attention steering终于能在生产环境用了

FlashAttention绕开完整注意力矩阵来省显存,但这也堵死了所有需要操作注意力矩阵的steering方法——想让模型优先关注指定文本(高亮关键指令、强调特定上下文段落),研究里早就能做到,生产环境却一直部署不了。SEKA换了个思路:不碰注意力矩阵,直接在频域对key embedding做谱分解,把目标token对应的潜在方向放大,效果等价但完全兼容高效推理。进阶版AdaSEKA还能根据prompt语义动态组合多个专家子空间,不同意图自动选不同的steering策略。训练免、额外延迟可忽略、显存开销极低,ICLR接收——attention steering第一次真正能进生产部署了。

原文:Spectral Attention Steering for Prompt Highlighting

03 多模态 精确标定相机位姿?基础模型里可能已经学会了

VGGT(Visual Geometry Grounded Transformer)这类大规模视觉几何模型在训练过程中,内部特征已经隐含了相当强的3D几何先验。VGGT-Det顺着这个发现,设计了两个模块来提取这些先验:一个从VGGT的注意力图中获取语义信息来初始化检测query,另一个跨层聚合几何特征将2D信息逐步提升到3D。这样就绕过了多视角3D检测对精确相机位姿标定的硬性依赖——在ScanNet和ARKitScenes的免标定设定下,分别比之前最好方法高出4.4和8.6个mAP@0.25。CVPR接收,方向务实:与其优化标定流程,不如直接从基础模型里挖出替代品。

原文:VGGT-Det: Mining VGGT Internal Priors for Sensor-Geometry-Free Multi-View Indoor 3D Object Detection

04 训练优化 RL post-training的提升,大部分其实该归SFT

一个控制变量实验给出了不太舒服的答案:在医疗VLM上,RL主要做的是「锐化」——把SFT阶段已经学到的能力更稳定地表达出来,而不是学到新能力。研究者在MedMNIST上沿视觉感知、SFT、RL三个轴做隔离测试,发现RL只在模型已有较高Pass@K(采样多次能答对)时才有效,它提升的是Acc@1(一次答对率)和采样效率。换句话说,SFT阶段没把「支持面」撑起来,RL再怎么训也没用。这个发现虽然来自医疗场景,但逻辑适用于所有RL post-training——你看到的提升,到底是RL学到了新东西,还是只是把SFT的成果表达得更稳定?先用Pass@K做个诊断再决定要不要上RL,可能省下不少算力。

原文:When Does RL Help Medical VLMs? Disentangling Vision, SFT, and RL Gains

也值得关注

今日观察

RL-for-reasoning有一个具体的工程瓶颈:当问题难度超过模型当前能力时,采样得不到正确轨迹,reward信号归零,训练在这个难度区间完全停滞。今天三篇独立工作各自在不同层级攻击这同一个问题。

CHIMERA在数据层解决:通过合成数据加难度校准,确保训练集在模型能力边界附近有足够密度的样本,让正确轨迹从一开始就有被采到的可能。Learn Hard Problems在搜索策略层解决:模型自己搜不到正解时,用人类参考解引导RL的探索方向——不是直接SFT模仿(超出分布的证明模仿不了),而是把参考解作为搜索空间的锚点。DIVA-GRPO在损失函数层解决:标准GRPO的advantage在过难和过易的问题上都趋近于零,通过自适应难度调整advantage计算来恢复梯度信号。

数据工程、搜索策略、损失函数——三条路线覆盖了训练pipeline的三个不同层级,而它们同时出现指向一个已经收敛的判断:reward sparsity是当前RL-for-reasoning最大的工程瓶颈,比RL算法选择(GRPO vs PPO vs REINFORCE)本身更重要。这个收敛信号比任何单篇论文的实验结果更有信息量,因为它反映的是不同团队在实际训练中反复撞到的同一面墙。

如果你在做推理模型训练,建议先建立一套按难度分桶的诊断机制:检查每个难度区间的Pass@K和非零reward比例。信号断裂的区间就是你最需要投入的地方——数据覆盖、探索引导、损失校正,三条路至少选一条补上。