今日概览

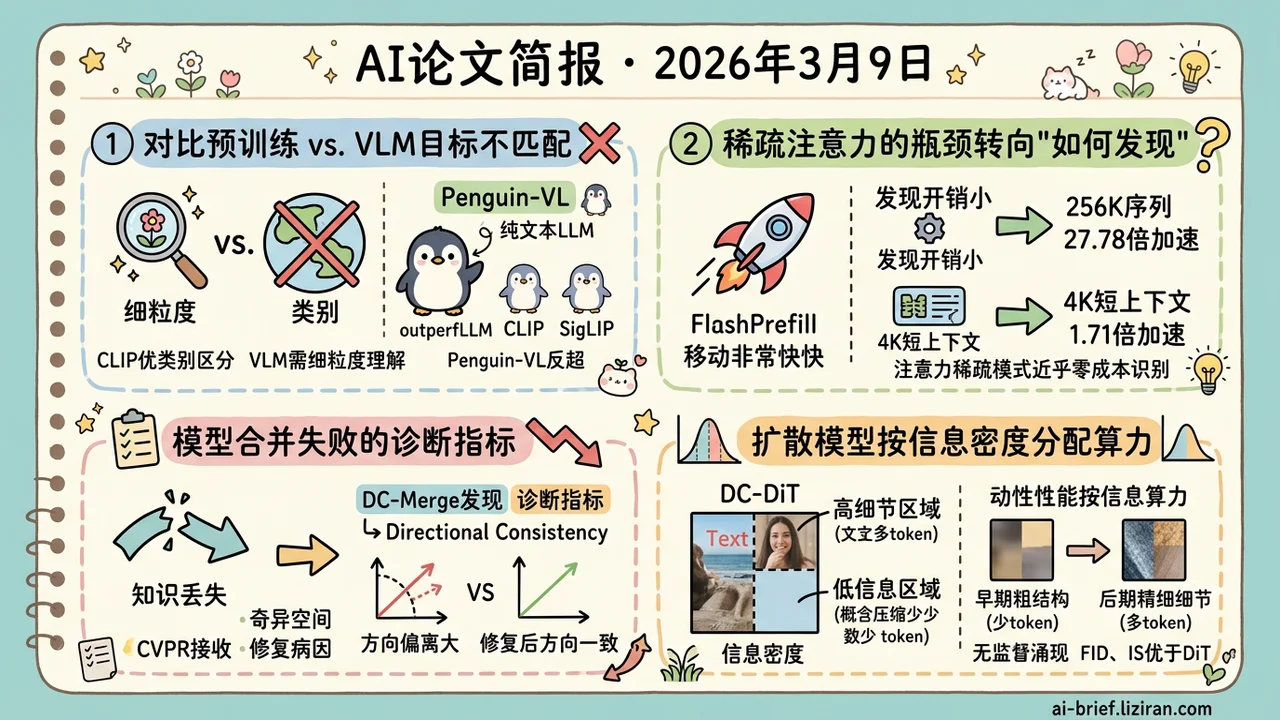

- 对比预训练与VLM目标天然不匹配,CLIP优化类别区分而VLM需要细粒度理解。腾讯Penguin-VL用纯文本LLM初始化视觉编码器,在2B和8B规模上反超CLIP/SigLIP方案。

- 稀疏注意力的瓶颈从「如何稀疏」转向「如何发现」 — FlashPrefill证明注意力的稀疏模式可以近乎零成本识别,256K序列实现28倍加速,4K短上下文也不退化。

- 模型合并失败有了可量化的诊断指标:DC-Merge发现合并后任务向量在奇异空间的方向偏离程度直接对应知识丢失程度,修复方向一致性即可系统性改善合并质量。

- 扩散模型开始按信息密度分配算力。DC-DiT让高细节区域获得更多token、低信息区域压缩处理,且压缩策略随去噪阶段自适应变化,可从现有DiT检查点热启动。

重点关注

01 多模态 视觉编码器不需要「看过图」也能理解图像?

几乎所有主流VLM都默认用CLIP或SigLIP做视觉编码器——毕竟这些模型见过海量图文对,理应最懂图像。但腾讯的研究团队发现了一个根本性的目标不匹配:对比学习优化的是粗粒度的类别区分能力(「这是猫还是狗」),而VLM真正需要的是细粒度的视觉理解(「图里第三行写了什么」)。为了追求检索相似度,CLIP反而主动压制了空间细节和局部特征。Penguin-VL的做法出人意料——直接用纯文本LLM初始化视觉编码器,完全跳过对比预训练。结果在2B和8B参数规模上,文档理解、视觉知识、多视角视频理解等任务全面超过了用SigLIP的同级模型,数学推理也打平了Qwen3-VL。这说明在紧凑模型上,更好的视觉表示比堆参数更关键。不过这个结论目前只在小模型上验证过,更大规模下CLIP的对比预训练是否仍然是次优选择,还是个开放问题。

原文:Penguin-VL: Exploring the Efficiency Limits of VLM with LLM-based Vision Encoders

02 推理加速 稀疏注意力的搜索开销,可能比注意力本身还贵

稀疏注意力加速prefill的思路不新鲜,但多数方案有个尴尬的共性:找出哪些token重要这件事本身就很耗时,省下的注意力计算被搜索开销吃回去了。FlashPrefill换了个思路——它发现注意力的稀疏模式(vertical、slash、block-sparse三种)可以通过快速块搜索近乎零成本地识别,不需要排序或累加注意力分数。配合动态阈值机制砍掉长尾分布来提升稀疏度,256K序列上实现27.78倍加速。更值得注意的是短上下文场景也没退化,4K长度仍有1.71倍加速——这意味着它不是只在极端长度下才有用的trick,日常推理也能受益。

03 训练优化 模型合并丢知识的根因,可能藏在奇异值方向里

模型合并(model merging)效果不稳定是个老问题,但之前缺乏清晰的诊断框架来解释「为什么这次合并失败了」。DC-Merge提出了一个可操作的指标:合并后的多任务向量与各单任务向量在奇异空间中的方向一致性——方向偏离越大,知识丢失越严重。论文发现两个具体病因:一是奇异值能量分布不均,少数主导成分淹没了语义上重要但较弱的信号;二是任务向量在参数空间中的几何结构不一致,直接合并会扭曲方向。对应的修复是先平滑奇异值分布,再投影到共享正交子空间对齐几何结构,在视觉和视觉语言基准上全量微调和LoRA两种设定都达到了当前最优,被CVPR接收。

原文:DC-Merge: Improving Model Merging with Directional Consistency

04 图像生成 扩散模型学会按信息密度分配计算了

Diffusion Transformer的patchify操作把图像切成固定大小的token序列——背景天空和复杂纹理拿到同样多的计算资源。DC-DiT在DiT骨干上加了一组encoder-router-decoder模块,端到端学习按区域信息密度分配token:低信息区域压缩成更少token,高细节区域保留更多,且这种视觉分割是无监督涌现的。分配策略也随去噪阶段变化——早期噪声阶段用更少token处理粗结构,后期才增加token数量来捕捉精细细节。在ImageNet 256×256上,无论参数量匹配还是计算量匹配的对比,DC-DiT的FID和IS都优于DiT基线。实用性上,它可以从预训练DiT检查点热启动,最多只需八分之一的训练步数,也能和其他动态计算方法组合进一步降低推理开销。

也值得关注

今日观察

CLIP视觉编码器(2021)、ViT固定patch(2020)、全注意力prefill(2017)——这些组件被广泛采纳,不是因为最优,而是因为在scaling-up路线下「够用且可靠」。算力充裕时,没人会为节省20%的冗余计算去冒架构风险。

效率约束改变了审视标准。当2B模型要上终端、256K上下文要实时响应、图像生成要压缩推理成本,「够用」就不再够用了。Penguin-VL发现CLIP的对比学习目标根本不适合细粒度理解,FlashPrefill发现注意力稀疏模式几乎免费就能识别,DC-DiT发现大量patch处理的是毫无信息量的区域——三个独立的发现指向同一个结论:这些组件最初被采纳时的假设条件,在当前的效率约束下已经不成立。它们同时被质疑不是巧合,而是部署侧的硬约束(端侧算力、延迟预算、推理成本)在过去两年迅速收紧,把原本「可优化但没必要」的冗余推到了「必须解决」的位置。

更值得留意的是方法论层面的连锁效应:一旦某个「标准组件」在特定约束下被证伪,同样的质疑逻辑会迅速蔓延到其他继承性设计。如果你在做模型优化或系统架构,建议列出pipeline中每一个「因为大家都这么用」而保留的组件,逐个对照它被采纳时的假设和你当前的部署约束——下一个被替换的默认组件,很可能就在你的清单里。