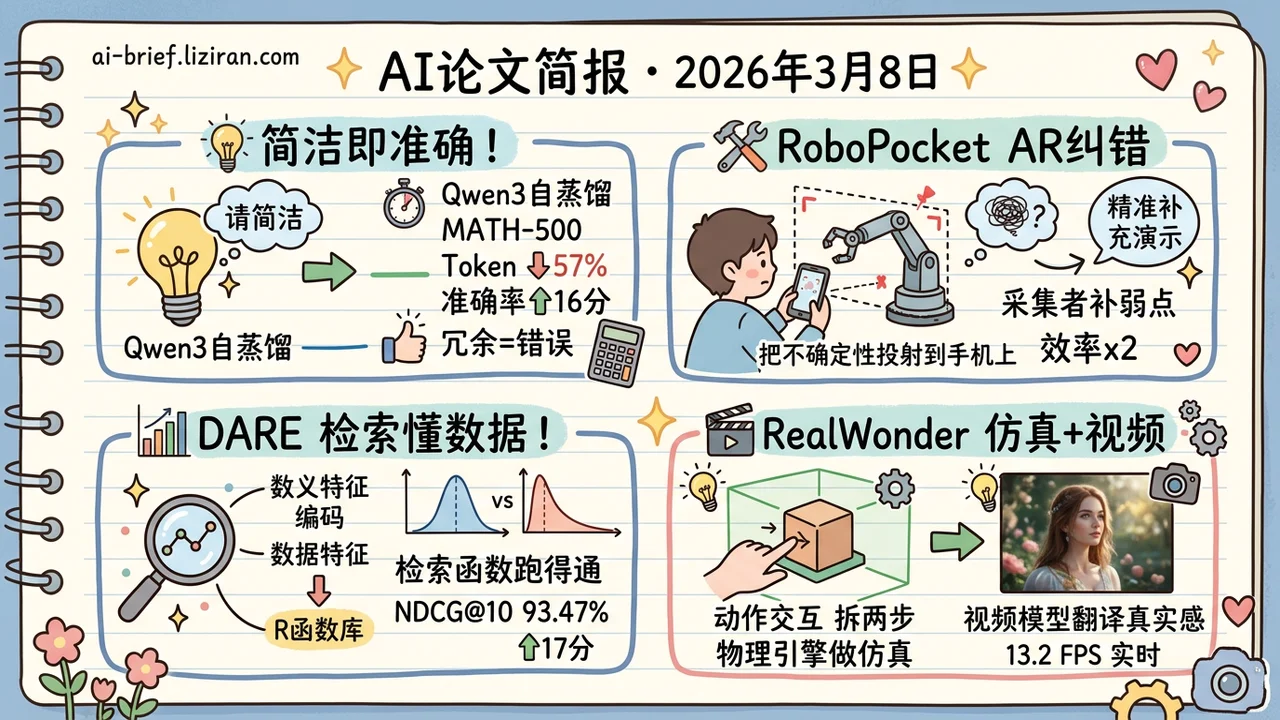

今日概览

- 一句「请简洁」就能自蒸馏,Qwen3在MATH-500上token砍半、准确率反涨16分,冗余推理不只浪费算力还主动制造错误

- 策略自己知道哪里会失败——RoboPocket把模型的不确定性AR投射到手机上,让数据采集者针对弱点补演示,效率翻倍

- RAG只看语义不看数据分布,检索到的函数跑不通。 DARE把数据特征编码进检索向量,NDCG@10达93.47%,高出最好的开源模型17分

- 物理仿真做桥梁,视频模型不用学物理。 RealWonder把动作交互拆成仿真+翻译两步,480×832分辨率下13.2FPS实时生成

重点关注

01 推理加速 一句「请简洁」,token砍半准确率反涨?

整个方法可以一句话讲完:给同一个模型加上「请简洁回答」的指令,用它生成的logits作为teacher,在模型自己的rollout上做reverse KL蒸馏。没有外部teacher模型,没有人工标注的答案,没有预设的token预算,也没有题目难度估计器。就是纯粹的自蒸馏——让模型的简洁模式教会它的默认模式。但效果出奇地好:Qwen3-8B和14B在MATH-500上减少57%-59%的推理token,准确率反而提升了9-16个百分点。更意外的是,14B模型在竞赛级的AIME 2024上也涨了10分,同时压缩41%的token。论文给出的解释很有说服力:推理模型生成的大量中间步骤不只是冗余,而是在主动制造错误——每多一个不必要的token都在累积偏差。模型其实已经具备简洁推理的能力,这个方法只是把它从「被动模式」蒸馏回了「默认模式」。

原文:On-Policy Self-Distillation for Reasoning Compression

02 机器人 采集再多演示数据也没用,如果你不知道策略哪里薄弱

模仿学习的数据瓶颈不在量,在针对性。手持设备让「野外」数据采集成了规模化方案,但操作员并不知道当前策略哪些动作已经学会、哪些还不行,大量演示浪费在模型已经掌握的场景上。RoboPocket的思路是把策略的预测轨迹通过AR实时投射到手机屏幕上,采集者能直观看到策略可能在哪失败,然后针对性地补充演示。配合异步在线微调,整个纠错循环几分钟就能闭合,数据效率比离线采集策略提升2倍。

原文:RoboPocket: Improve Robot Policies Instantly with Your Phone

03 检索 语义匹配满分,推荐的函数却跑不通

LLM agent做统计分析时,RAG检索R函数有个被忽略的盲区:现有方法只看函数描述的语义相似度,完全不考虑实际数据的分布特征。结果就是检索到的函数描述完美契合需求,但数据根本不满足使用前提——比如数据明显偏态,却推荐了假设正态分布的检验方法。DARE的做法出人意料地直接:把数据分布特征编码进检索向量,让检索同时理解「想做什么」和「数据长什么样」。在8191个CRAN包构建的知识库上,检索准确率(NDCG@10)93.47%,比最好的开源embedding模型高17个百分点,而且参数量更少。思路本身并不复杂,但它戳中了一个更普遍的问题:当前大多数RAG系统都只编码静态语义,完全无视运行时上下文——这个盲区远不止统计分析一个场景。

原文:DARE: Aligning LLM Agents with the R Statistical Ecosystem via Distribution-Aware Retrieval

04 视频生成 视频模型不懂物理?那就别让它学

视频生成模型擅长生成逼真画面,但对「推一下这个杯子会怎样」这类物理交互毫无概念——它缺乏3D场景结构的理解。RealWonder的思路是不去硬教视频模型理解物理,而是引入物理仿真做中间层:先用物理引擎把动作(力、机械臂操控)转成仿真画面(光流和RGB),再让视频模型只负责从仿真到真实感的「翻译」。这个拆解很务实——物理引擎本就擅长模拟力的后果,视频模型本就擅长生成逼真画面,各做各的。系统集成了单图3D重建、物理仿真和一个只需4步扩散的蒸馏视频生成器,在480×832分辨率下跑到13.2FPS,覆盖刚体、可变形体、流体和颗粒材料。

原文:RealWonder: Real-Time Physical Action-Conditioned Video Generation

也值得关注

今日观察

OPSDC用「请简洁」指令提取模型自身的简洁推理能力,RoboPocket把策略网络的不确定性信号投射给人类采集者,DARE把数据分布编码进检索向量。三个系统解决的问题完全不同,但突破点共享一个结构:改进所需的信号已经存在于系统内部,只是没人用。

模型已经会简洁推理——默认模式不启用而已。策略已经知道哪里不确定——没人看这个输出而已。数据分布已经是最好的检索上下文——没人编码它而已。三个团队做的事本质上一样:把系统自身已有的信号接入决策回路。

这个模式对日常工程有直接参考价值。下次系统表现不理想,先别急着加模块、换模型、堆数据——盘点一下系统内部已经产生但没被使用的信号:模型的logits分布、中间层表示、预测不确定性、输入数据的统计特征。具体做法:选一个当前表现最差的环节,打印出模型在该环节的中间输出,看看有没有可以直接利用的信号。「接上已有信号」比「引入新能力」部署更快、风险更低,而且往往效果更好。