今日概览

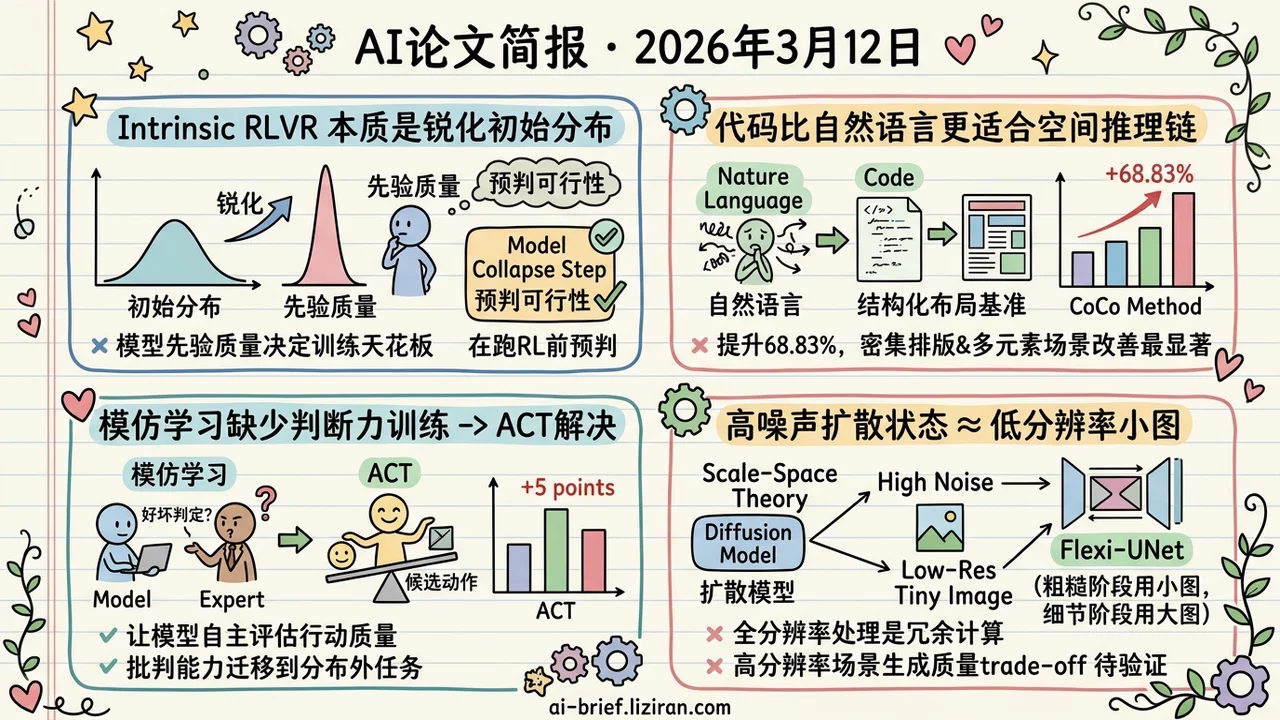

- 所有intrinsic RLVR本质是锐化初始分布,模型先验质量决定训练天花板。Model Collapse Step可在跑RL前预判可行性,避免无效投入

- 代码比自然语言更适合做空间推理链:结构化布局基准提升68.83%,密集排版和多元素场景改善最为显著

- 模仿学习的结构性缺陷是缺少判断力训练。 ACT用RL让模型在候选动作间做对比评估,批判能力可迁移到分布外任务

- 高噪声扩散状态的信息量等价于低分辨率小图,全分辨率处理是冗余计算。理论扎实,但高分辨率场景的质量tradeoff待验证

重点关注

01 训练优化 Intrinsic reward先升后降,无监督RL训练的天花板在哪?

Intrinsic RLVR(用模型自身信号做奖励的无监督强化学习)近期实验不少,但多数工作只展示了「能涨」,没说清楚天花板在哪。这篇给出了迄今最系统的分析:先将URLVR方法分为intrinsic(模型自身信号)和external(外部计算验证)两类,再用统一理论框架证明——所有intrinsic方法本质上都在做同一件事:锐化模型的初始分布。当模型初始置信度与正确性对齐时,锐化有效;不对齐时,会灾难性崩溃。实验印证了这个结论:intrinsic reward在所有方法上都呈现先升后降的规律,崩溃时间点取决于模型先验质量而非工程调参。值得注意的是,intrinsic reward在小数据集的test-time training场景仍然有价值,论文还提出了Model Collapse Step作为预判指标——相当于在跑RL之前先做一次「可行性检查」。另一个方向是external reward的初步探索:利用计算不对称性(生成难、验证易)构建奖励信号,初步实验显示有望绕过intrinsic方法的置信度天花板,但目前还只是early evidence。

原文:How Far Can Unsupervised RLVR Scale LLM Training?

02 图像生成 代码即推理链:先写程序再画图,复杂排版提升68%

让模型先写一段代码再画图——听起来绕远路,但CoCo证明这恰恰是捷径。做法是让模型根据文本提示生成可执行代码来定义场景的空间布局,在沙盒中渲染出确定性草图,再精修为高保真图像。代码天然具备精确坐标、循环和条件判断,这些正是自然语言CoT(链式推理)描述不了的东西——尤其在密集文字排版和多元素复杂场景下差距巨大。在结构化布局基准上比直接生成提升68.83%,比其他CoT方法也全面领先,证明了程序化表达是比自由文本更好的空间推理语言。

原文:CoCo: Code as CoT for Text-to-Image Preview and Rare Concept Generation

03 Agent 只看正确示范,能学会判断力吗?

你可以通过看无数正确示范学会执行,但执行不等于理解——模型照着专家动作做,却从不对比好与坏,缺少对行动质量的判断力。有些工作尝试让模型模仿预写好的反思文本来弥补,但模仿反思和真正学会反思是两回事。ACT换了个思路:用RL训练模型在两个候选动作中判断哪个更好,根据判断正确与否给奖励,让模型自主发展出评估行动质量的能力。三个Agent benchmark上比模仿学习平均高5个点,比直接RL也高4.6个点,且泛化到分布外任务和通用推理——说明学到的是判断力本身,不只是任务特定的反应模式。

04 模型架构 噪声越大的扩散步骤,其实只需要一张缩略图

尺度空间理论(scale-space theory)和扩散模型看似两个领域,但Scale Space Diffusion做了一个形式化的连接,结论有点反直觉:高噪声状态所包含的信息量,数学上等价于一张降采样后的低分辨率小图。换句话说,扩散模型在早期去噪步骤中用全分辨率处理,本质上是在对「不存在的细节」做无用功。基于这个发现,他们提出了Flexi-UNet——只在需要的分辨率和网络深度上做去噪,噪声大时处理小图,细节逐步出现时再提升分辨率。理论推导很优雅,但在CelebA和ImageNet上的实验还需要关注一个关键tradeoff:效率提升的同时,生成质量是否打了折扣,目前只看到了scaling行为分析,高质量生成场景下的表现有待验证。

也值得关注

今日观察

今天三篇重点论文做了同一件事:替换掉一种传统监督信号。RLVR用模型内在奖励替代ground-truth标签,ACT用学习到的批判信号替代专家示范,CoCo用代码结构替代自然语言规划。

表面看三个方向毫不相关,但底层问题是同一个:不是监督数据不够多,而是标准监督形式的表达力不足。标签只说对错,不说为什么错;示范只展示做什么,不解释为什么不做另一种选择;自然语言描述「左边放A、右边放B、中间留30像素」天然不精确。

当前正在发生的不是「去监督化」,而是监督信号从低保真度向高保真度的系统性升级——从单bit的对/错判定,走向能承载结构、因果和定量关系的信号形式。

如果你正在设计训练流程,值得停下来审视一个问题:当前使用的监督信号,是否真的表达了你希望模型学会的东西?标签、示范、自然语言描述各有表达力边界。选错信号形式,再多数据也补不回来。