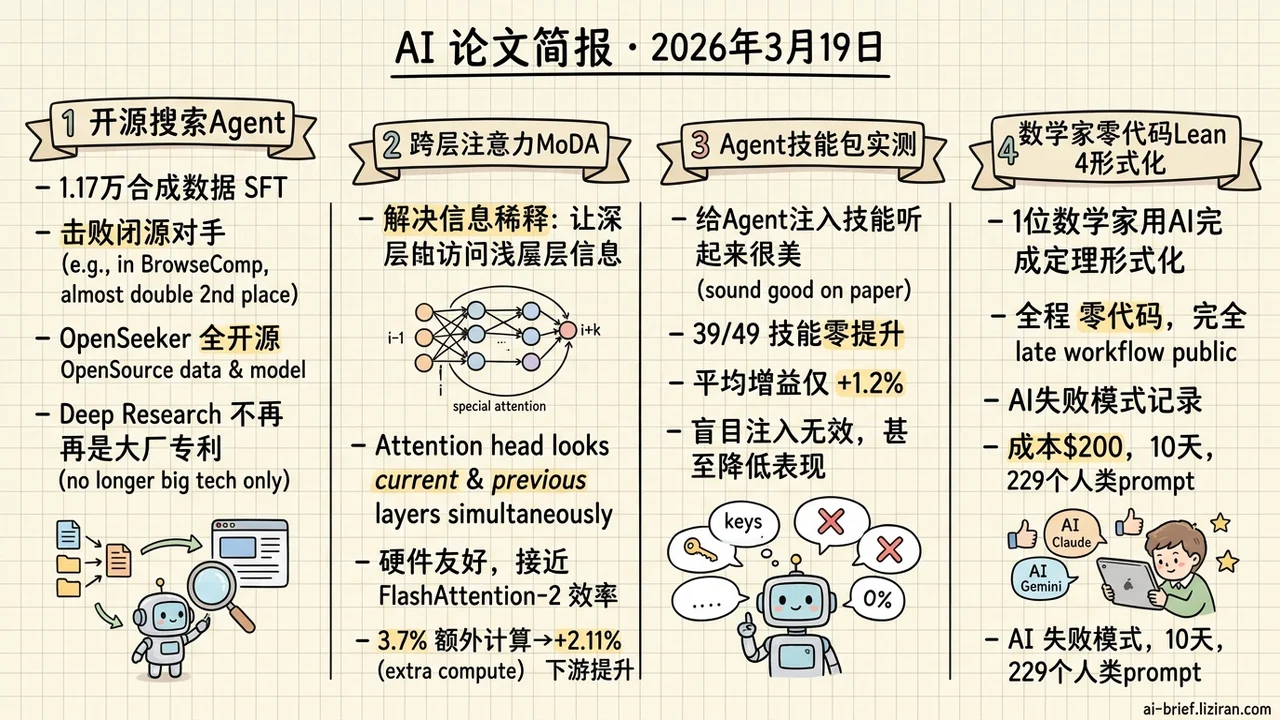

今日概览

- 1.17万条合成数据训出的开源搜索Agent击败闭源对手,OpenSeeker在BrowseComp上几乎翻倍第二名,数据和模型全开源,Deep Research不再是大厂专利。

- 跨层注意力让深层信息不再被稀释:MoDA让每个注意力头同时关注当前层和前层的KV,仅3.7%额外计算换来下游任务平均+2.11%,已开源。

- 给Agent注入技能听起来很美,实测39/49个技能零提升。SWE-Skills-Bench首次严格评估Agent Skills实际效用,平均增益仅+1.2%。

- 一位数学家零代码10天完成等离子体定理的Lean 4形式化,AI辅助数学研究的完整工作流首次被公开复盘,成本$200。

重点关注

01 Agent 1万条数据就够了:开源搜索Agent凭什么碾压闭源?

Deep Search能力已成为LLM Agent标配,但高性能搜索Agent一直被大厂垄断——缺的不是模型,是高质量训练数据。OpenSeeker直接解决了这个问题:通过反向工程web知识图谱自动合成多跳推理任务,配合回顾式总结去噪轨迹质量,仅用1.17万条合成数据做SFT就在BrowseComp上拿到29.5%,几乎翻倍第二名DeepDive的15.3%。更意外的是,它甚至在BrowseComp-ZH上超过了用大规模继续预训练+SFT+RL训练的通义DeepResearch(48.4% vs 46.7%)。数据和权重全部开源,对想自建搜索Agent的团队来说,数据合成管线可能比模型本身更有价值。

原文:OpenSeeker: Democratizing Frontier Search Agents by Fully Open-Sourcing Training Data

02 模型架构 模型越深信号越弱?让注意力跨层「回头看」

LLM越堆越深,但深层有个老问题:浅层形成的有用特征会被反复residual更新逐渐稀释,深层想用却捡不回来。MoDA(Mixture-of-Depths Attention)的做法很直觉——让每个注意力头不只看当前层的KV,还能同时关注前面层的KV。更关键的是工程实现:他们设计了硬件友好的算法解决非连续内存访问问题,在64K序列长度下达到FlashAttention-2效率的97.3%。1.5B参数模型上,平均perplexity降了0.2,下游任务平均提升2.11%,额外计算开销仅3.7%。附带发现:MoDA配post-norm比pre-norm效果更好。代码已开源,对做深层模型架构的团队是一个值得纳入的设计原语。

原文:Mixture-of-Depths Attention

03 代码智能 Agent Skills听起来很美,实测39个技能零提升

「给Agent注入技能包」已成为增强LLM编程能力的流行做法,但效果到底怎样?SWE-Skills-Bench给出了第一个严格的实测答案:49个公开Agent Skills配合真实GitHub仓库,565个任务实例覆盖6个子领域。结果相当冷静——39个技能零pass率提升,平均增益仅+1.2%。Token开销从略有节省到暴增451%不等,pass率纹丝不动。只有7个高度专业化的技能产生了有意义的提升(最高+30%),还有3个因为版本不匹配的指导与项目上下文冲突,反而降低了表现(最高-10%)。Agent Skills是窄干预,有效性高度依赖领域匹配度、抽象层级和上下文兼容性。下次往Agent里塞技能包之前,先做消融实验。

原文:SWE-Skills-Bench: Do Agent Skills Actually Help in Real-World Software Engineering?

04 AI for Science 零代码、10天、$200:AI辅助数学形式化的完整复盘

Vlasov-Maxwell-Landau方程组的平衡态刻画——正经的等离子体物理定理。一位数学家用AI完成了它的完整Lean 4形式化,全程没写一行代码。流程值得细看:Gemini DeepThink从猜想生成证明,Claude Code将自然语言证明翻译为Lean代码,专用证明器Aristotle关闭了111个引理,最后Lean内核验证通过。全过程10天、229个人类prompt、213个git commit、$200。最耐人寻味的细节——形式化比对应的数学论文终稿还先完成了。作者详细记录了AI的失败模式:假设蠕变(hypothesis creep)、定义对齐bug、Agent回避行为。整个开发过程公开存档,对想用AI辅助严格推理的团队是一份难得的实战报告。

原文:Semi-Autonomous Formalization of the Vlasov-Maxwell-Landau Equilibrium

也值得关注

今日观察

OpenSeeker用1.17万条合成数据打败了重度RL训练的闭源搜索Agent,SWE-Skills-Bench发现49个Agent技能包有39个完全无效。两个故事指向同一个结论:数据质量和任务匹配度远比数据量和功能堆叠重要。

OpenSeeker赢在合成数据的设计——拓扑扩展保证覆盖度,实体混淆控制复杂度,回顾去噪提升轨迹质量。失败的Agent Skills输在泛用性假设——通用技能包碰上具体项目上下文,要么无关要么冲突。做Agent的团队与其追求「全面武装」,不如投入精力在少量高匹配度数据和技能的精细设计上。