今日概览

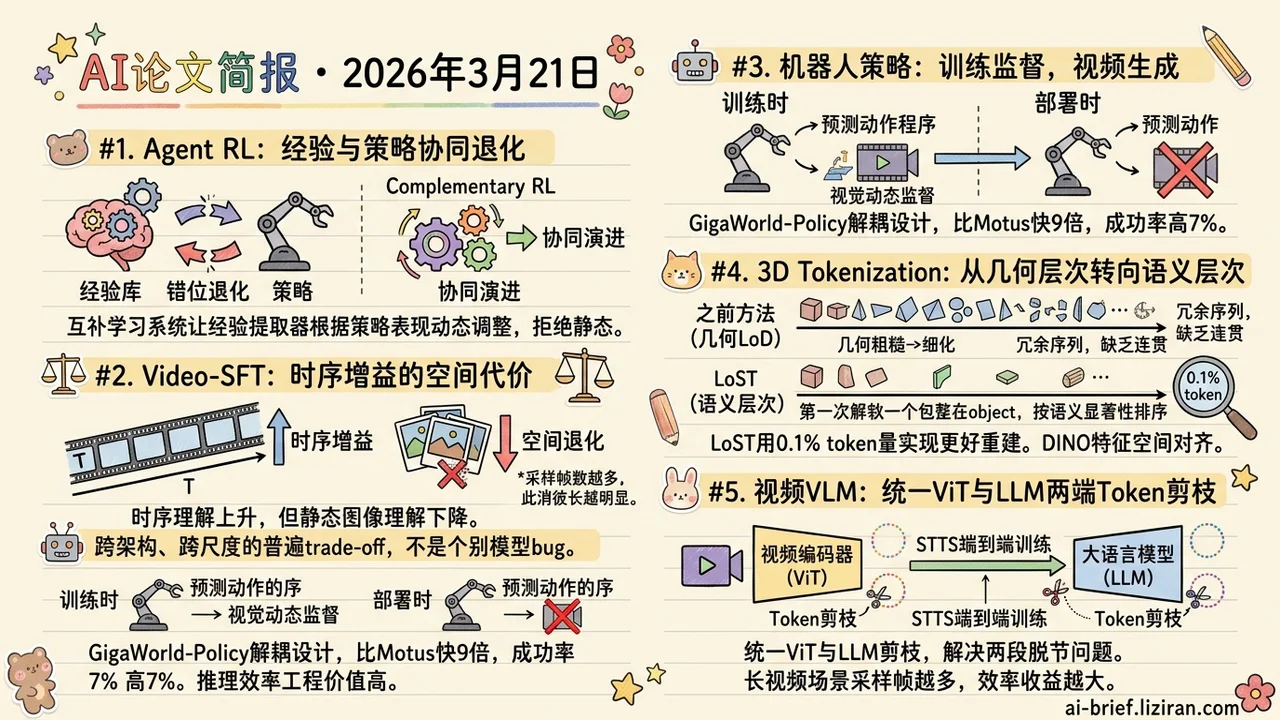

- 经验库与策略的错位退化是agent RL的隐性瓶颈。Complementary RL让经验提取器根据策略表现动态调整,实现协同演进而非静态积累。

- Video-SFT的时序增益以空间退化为代价——跨架构、跨尺度的系统性实验确认,这不是个别模型的bug,是视频微调的结构性trade-off。

- 视频生成做机器人策略辅助监督,但部署时可以关掉:GigaWorld-Policy的解耦设计比Motus快9倍且成功率高7%。

- 3D tokenization从几何层次转向语义层次,LoST用之前方法0.1%的token量达到更好的重建质量。

- ViT和LLM两端的token剪枝终于统一了 — STTS端到端可训练,长视频场景下采样帧越多效率收益越大。

重点关注

01 Agent 经验库为什么越用越过时?

RL训练agent时有个不太被讨论的退化现象:你积累了一堆历史经验来帮助策略学习,但策略在进步,经验库还停在原地——就像新手阶段攒下的笔记,到了中级阶段反而会误导判断。现有方法要么把经验静态存储,要么更新频率跟不上策略迭代,两者之间的错位会随训练推进越来越严重。Complementary RL借鉴了神经科学中「互补学习系统」的思路:让经验提取器和策略网络在同一个RL循环里协同优化——策略靠稀疏的结果奖励学习,经验提取器则根据「我提供的经验是否真的帮到了策略」来调整自身。关键设计是经验的价值由策略的实际表现来评判,而不是独立维护一套评估标准。单任务场景提升10%,多任务场景展现出稳健的扩展性,且已有代码实现。这个思路本身比具体数字更值得关注——经验与策略的协同演进是agent长期训练绑不开的问题,当前大多数agent框架还没认真处理这一层。

原文:Complementary Reinforcement Learning

02 多模态 视频微调的隐性账单:时序能力涨了,空间理解却在悄悄退化

给多模态大模型做Video-SFT(视频监督微调)几乎是标准操作,默认假设是「加上视频数据只会让模型更强」。但这篇系统性研究打破了这个假设:跨架构、跨参数规模的实验一致显示,Video-SFT在提升视频性能的同时,会导致静态图像理解出现明显退化。更反直觉的是,采样帧数越多视频表现越好,但图像能力并不跟着涨——时序和空间理解之间存在结构性的此消彼长。研究团队提出了一个instruction-aware的混合帧策略来部分缓解,但「部分缓解」本身就说明这个trade-off远未被解决。

原文:Temporal Gains, Spatial Costs: Revisiting Video Fine-Tuning in Multimodal Large Language Models

03 机器人 训练时用视频生成做监督,部署时直接关掉

把视觉动态预测和动作预测绑在一起联合推理,代价不小——推理开销大,且动作精度被视频生成质量拖累。GigaWorld-Policy做了一个务实的解耦:训练时,模型同时预测动作序列和生成未来视频,视频生成提供物理合理性的监督信号;但通过因果设计,未来视频的token不会影响动作token,部署时可以关掉视频生成,只跑动作预测。这个「训练时用、部署时扔」的设计带来了实际收益:推理速度比当前最强的WAM(世界-动作模型)基线Motus快9倍,任务成功率还高7%。对需要实时响应的机器人部署场景来说,这种推理效率与动作精度的平衡比追求更好的视频生成质量更有工程价值。

原文:GigaWorld-Policy: An Efficient Action-Centered World–Action Model

04 模型架构 3D生成一直在借用渲染领域的tokenization,思路可能从头就不对

0.1%的token量,更好的重建质量——LoST的秘诀是把3D tokenization从几何层次转向语义层次。当前autoregressive 3D生成普遍套用渲染和压缩领域的几何LoD(Level-of-Detail)做tokenization,先编码粗糙几何再逐步细化,但这种层次结构是为渲染效率设计的,不是为自回归建模设计的,token之间缺乏语义连贯性,序列也冗长。LoST换了个思路:按语义显著性排序token,让最前面的几个token就能解码出完整、合理的形状,后续token再补充细节。关键创新是用DINO特征空间做语义对齐,让token顺序真正反映「什么重要」而不是「什么在哪」。效果上,它用之前方法0.1%到10%的token量就达到了更好的重建和生成质量。

原文:LoST: Level of Semantics Tokenization for 3D Shapes

05 推理加速 视频大模型的token剪枝,为什么总是「剪了一半漏了一半」?

视频VLM(视觉语言模型)的推理瓶颈很大程度上来自视觉token的时空冗余,但现有的剪枝方案有个尴尬的断层:要么只在视觉编码器(ViT)端剪,不考虑下游语言任务的需求;要么只在LLM端剪,前面ViT输出的冗余token照单全收。STTS的思路是统一两段——用一个轻量评分模块同时在ViT和LLM中做token剪枝,时间维度靠辅助损失学习,空间维度靠LLM梯度反传指导,不需要文本条件筛选,也不做token合并,端到端训练即可。实测在13个视频问答任务上平均性能只掉了不到1个点,而且采样帧数越多效率增益越明显——这对长视频场景尤其实用。方法本身不复杂,胜在把之前两段脱节的问题用一个统一框架解决了,做视频理解部署的团队可以直接关注。

原文:Unified Spatio-Temporal Token Scoring for Efficient Video VLMs

也值得关注

今日观察

今天有三个发现放在一起看很有意思。Complementary RL揭示agent经验库不随策略更新就会过时;CoVerRL发现label-free RL的多数投票让输出多样性坍缩;Temporal Gains发现Video-SFT的时序能力提升以空间理解退化为隐性代价。

三个问题分布在agent训练、推理优化、多模态微调三个不同领域,但共享同一个底层机制:优化压力在目标指标可见的维度上制造进步的同时,在评测指标覆盖不到的维度上制造系统性损伤。Agent训练时没人盯经验库的新鲜度,推理训练时没人盯输出分布的熵,视频微调时没人盯图像理解的保持度。这些不是「训练太难」的笼统困难,而是具体的指标盲区——标准pipeline默认不监控、因而默认不会暴露的退化维度。

「跑通了、指标在涨」不等于训练在正确工作。一个低成本的应对:在训练监控中加入2-3个非目标维度的退化指标。不需要复杂方法,就是把你默认不看的东西也画条曲线——经验库与当前策略的分布偏移、输出的多样性熵、非目标任务的定期eval。当这些曲线开始下降时触发review,成本几乎为零,但能在损伤累积到影响部署之前发现问题。