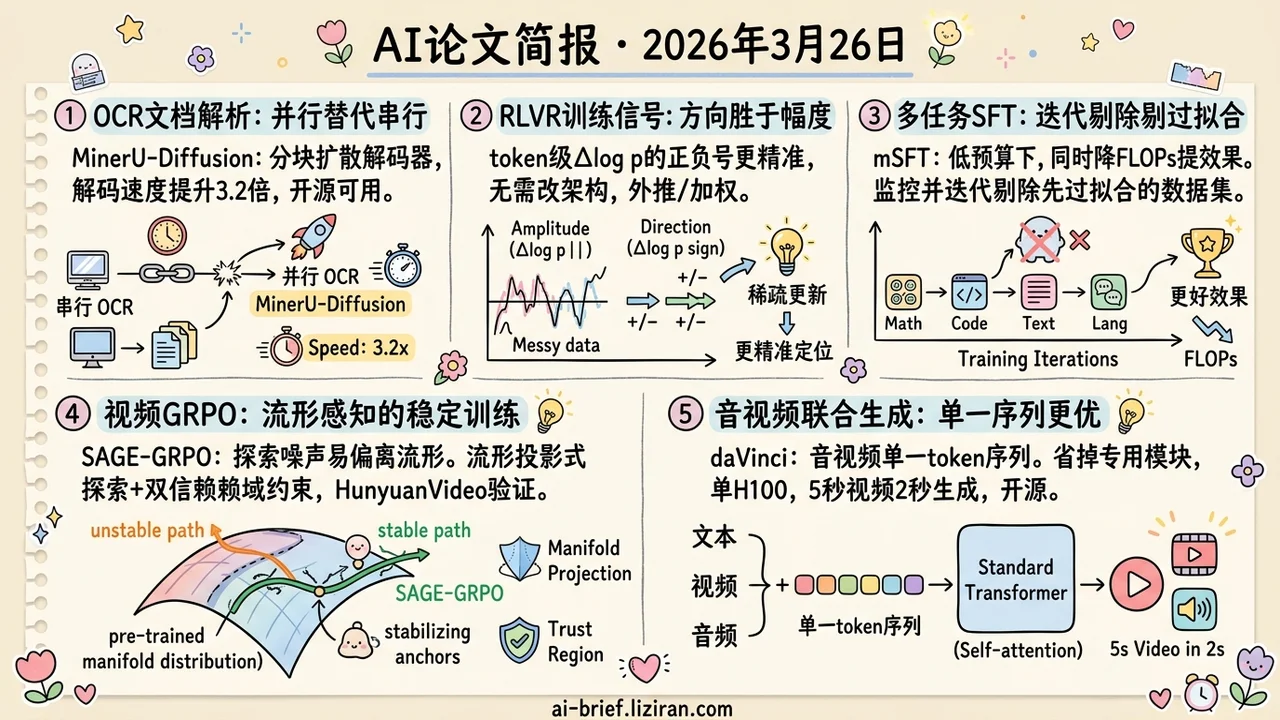

今日概览

- 扩散解码替代自回归,文档OCR从串行跳到并行。 MinerU-Diffusion把文档解析重定义为逆渲染问题,用分块扩散解码器并行生成结构化源码,解码速度提升3.2倍,开源可用

- RLVR训练信号的方向比幅度更重要: token级Δlog p的正负号能更精准定位推理关键的稀疏更新,据此提出的推理外推和训练加权方法不改架构即可应用

- 多任务SFT存在大量隐性计算浪费, 不同子数据集过拟合速度差异巨大。mSFT迭代剔除先过拟合的数据集,低预算下同时降FLOPs提效果

- 视频GRPO不稳定的根源是探索噪声偏离数据流形。 ODE→SDE转换把采样轨迹推离预训练分布,SAGE-GRPO用流形投影式探索加双信赖域约束修复,在HunyuanVideo上验证有效

- 音视频联合生成不需要多流架构 — 文本/视频/音频拼成单一token序列只用self-attention,单H100上5秒视频2秒生成,完整模型栈开源

重点关注

01 多模态 如果OCR不是「读」文档,而是「反推」渲染过程呢?

渲染引擎把Markdown源码变成排版好的PDF——MinerU-Diffusion反过来做:给定渲染结果,用扩散模型并行反推出结构化源码。这个逆渲染视角一旦成立,从左到右的自回归解码就不再是必需品,而是序列化格式带来的历史惯性。具体做法是用分块扩散解码器(block-wise diffusion decoder)替代逐token生成,配合不确定性驱动的课程学习策略来稳定长序列训练。效果上,解码速度比自回归基线快3.2倍,鲁棒性也有一致提升。团队还专门设计了Semantic Shuffle benchmark来测试模型是否真的在「看」文档而非依赖语言先验——扩散方案在这个测试上明显更强。110个HF upvotes加上开源代码,社区反馈说明这不只是理论上的优雅,做文档处理流水线的团队现在就可以跑起来试了。

原文:MinerU-Diffusion: Rethinking Document OCR as Inverse Rendering via Diffusion Decoding

02 推理 RLVR效果的关键在更新方向,不在幅度

Token级log概率变化的正负号,可能是理解RLVR(基于可验证奖励的强化学习)效果机制的更好切入点。这篇工作通过统计分析和token替换实验发现,相比散度、熵等幅度类指标,Δlog p的方向能更精准地定位那些稀疏但对推理至关重要的更新。基于这个发现,作者提出两个实用方法:推理时沿Δlog p方向外推策略来提升准确率,训练时对低概率token加权来加速学习——都不需要改架构,落地门槛低。思路直觉且验证扎实,但泛化性还需要在更多模型规模和任务类型下检验。

原文:On the Direction of RLVR Updates for LLM Reasoning: Identification and Exploitation

03 训练优化 多任务微调的隐性浪费:有些任务早已过拟合,有些还在收敛

同时微调多个任务时,各子数据集的学习速度天差地别——有些3个epoch就开始过拟合,有些10个epoch仍在收敛,但训练循环对所有数据一视同仁地分配计算。mSFT针对这个问题做了一件直接的事:迭代监控每个子数据集,一旦发现最先过拟合的就剔除它、回滚到该数据集的最优checkpoint,然后继续训练剩余部分。在10个benchmark和6个基座模型上持续优于4种baseline,且对唯一新增的超参数不敏感。更实用的发现是低计算预算下,mSFT在提升效果的同时降低了训练FLOPs——对资源有限的团队来说,这比绝对性能数字更值得关注。

原文:mSFT: Addressing Dataset Mixtures Overfitting Heterogeneously in Multi-task SFT

04 视频生成 视频GRPO训练为什么总崩?问题出在探索噪声偏离了流形

用FlowGRPO做视频生成对齐,训练不稳定几乎是常态。SAGE-GRPO找到了一个具体的结构性原因:探索阶段把ODE(确定性采样)转成SDE(随机采样)时注入的噪声,会把采样轨迹推离预训练模型定义的数据流形——rollout质量崩塌,奖励估计跟着变得不可靠,训练自然不收敛。修复思路是沿流形做受约束的探索:微观层面用对数曲率校正推导流形感知的SDE,宏观层面用双信赖域防止策略漂移太远。在HunyuanVideo1.5上的实验显示,视频质量、文本对齐、视觉指标都比之前的方法有一致提升。

原文:Manifold-Aware Exploration for Reinforcement Learning in Video Generation

05 模型架构 去掉跨注意力和多流设计,音视频联合生成反而更强了?

音视频联合生成领域近期的趋势是叠加专用模块:多流编码器、跨注意力对齐层、模态特定的训练策略。daVinci-MagiHuman把这些全砍了——文本、视频、音频token拼成一个序列,只用标准self-attention。工程上的收益很直接:不需要维护多流同步逻辑,推理优化(模型蒸馏、latent超分、Turbo VAE)可以直接叠加在标准Transformer上,单张H100生成5秒视频只要2秒。效果也没打折扣,人类评估对Ovi 1.1胜率80%,语音可懂度WER降到14.6%,在开源模型里最低。完整模型栈(基础模型、蒸馏版、超分模型、推理代码)全部开源,做音视频生成的团队可以直接用。

原文:Speed by Simplicity: A Single-Stream Architecture for Fast Audio-Video Generative Foundation Model

也值得关注

今日观察

今天的两篇RL工作看似方向迥异——一篇分析RLVR在语言推理中的token级更新机制,另一篇诊断GRPO在视频生成中的训练崩塌——但它们的发现指向同一个结论:我们对RL信号在生成模型内部的传播路径理解不够,而这个理解缺失正在阻碍RL配方向新模态和新任务迁移。

RLVR方向分析发现,token级更新的正负方向比幅度更能解释RLVR为什么提升推理——之前关注「参数变了多少」的分析框架可能看错了维度。流形感知视频RL则发现,GRPO在视频上崩溃是因为探索噪声把采样推离了预训练流形——在语言上工作正常的SDE探索策略,换到连续流匹配模型上就失效了。

两篇放在一起释放的信号很清晰:RL for generation仍处于诊断期。 在语言和图像上验证有效的RL配方,不能假设可以直接迁移到视频、音频或其他新模态。每种模态的生成模型有不同的内部结构(自回归vs流匹配vs扩散),RL信号在这些结构中的传播机制也不同,需要先诊断再设计。

如果你的团队正在把GRPO或RLVR往新场景搬,建议先投入一轮诊断性实验:跑小规模训练,监控token/timestep级别的更新方向和幅度分布,确认RL信号是否按预期传播到了关键位置,再决定训练配方——而不是直接套用语言模型上的超参数配置。