今日概览

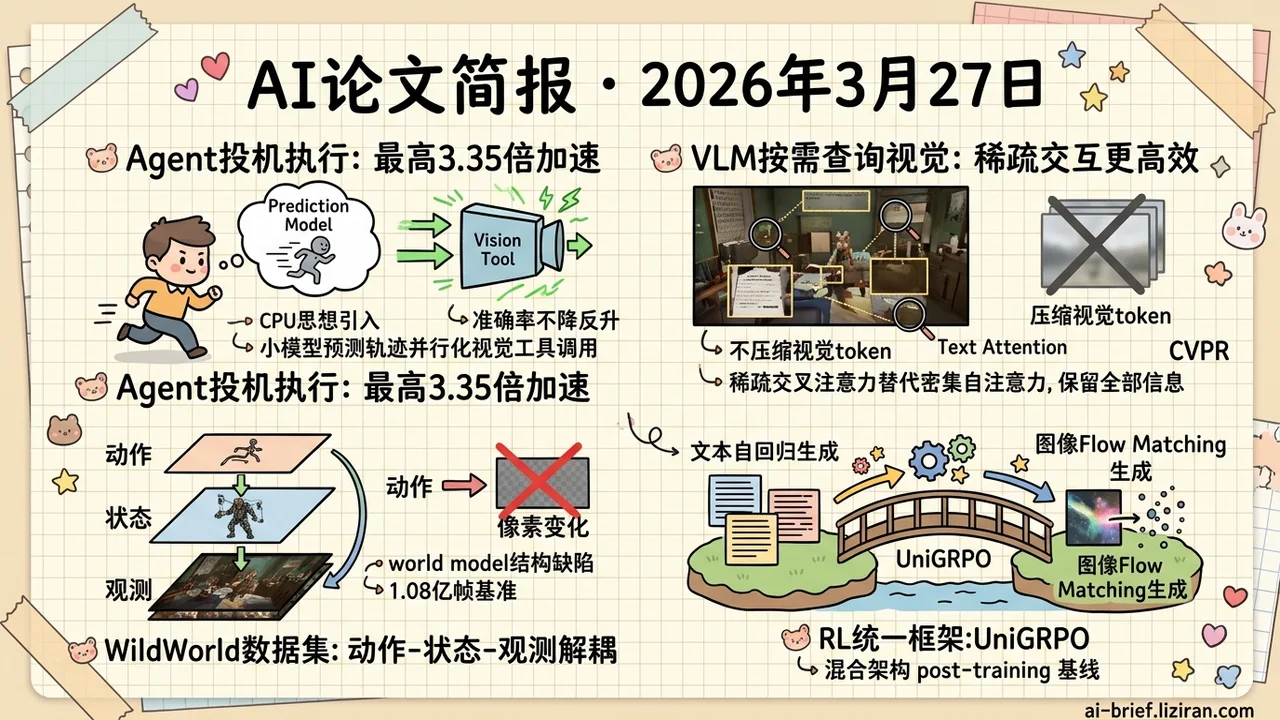

- Agent投机执行实现最高3.35倍加速,SpecEyes将CPU投机执行思想引入agent循环,用小模型预测轨迹并行化视觉工具调用,准确率不降反升

- VLM加速的答案不是压缩视觉token而是按需查询。VISOR用稀疏交叉注意力替代密集自注意力,保留全部视觉信息同时大幅降低计算量(CVPR)

- World model数据集缺的不是规模而是结构——WildWorld提供动作-状态-观测三层解耦的1.08亿帧基准,直指动作与像素直接耦合的设计缺陷

- RL训练跨越文本与图像两种生成范式有了可行框架:UniGRPO用MDP统一建模自回归文本和flow matching图像,为混合架构post-training提供基线

重点关注

01 Agent CPU的「投机执行」,能让多模态Agent快3倍吗?

CPU设计里有个经典技巧:不等上一条指令算完,先猜下一步要什么数据,提前取好——猜对了白赚一轮延迟,猜错了回滚就是。SpecEyes把这个思路搬到了多模态Agent系统:用一个轻量无工具的小模型充当「投机规划器」,预测agent接下来的执行轨迹,提前启动视觉工具调用,不用等大模型一步步串行走完感知-推理-调用的完整循环。关键设计是一个「认知门控」机制——通过衡量模型对答案的可分离度来判断置信度,决定何时可以提前终止昂贵的工具链,不需要外部标注做验证。同时用异构并行漏斗架构,让小模型的无状态并发去掩盖大模型的有状态串行执行,最大化系统吞吐。在V* Bench、HR-Bench和POPE上实现1.1-3.35倍加速,准确率不降反升最高+6.7%。这个方向的意义可能比单篇论文更大——随着agent loop越来越深(o3、Gemini Agentic Vision都在往这个方向走),串行深度而非单步速度才是真正的系统瓶颈,投机式并行化可能是比优化单个模型更有杠杆的路径。

原文:SpecEyes: Accelerating Agentic Multimodal LLMs via Speculative Perception and Planning

02 推理加速 不丢视觉token,VLM反而跑得更快了

大视觉语言模型(VLM)加速的标准做法是压缩视觉token——把图像信息砍到尽量少再喂给语言模型。VISOR(CVPR)走了一条反直觉的路:保留全部高分辨率视觉token,但让语言模型按需查看。具体做法是把图像-文本的交互从密集自注意力换成稀疏结构——大部分层用轻量的交叉注意力提供视觉上下文,只在动态选择的少数自注意力层做精细推理。一个轻量策略网络根据每个样本的复杂度动态分配视觉计算量,简单问题少看几层,复杂问题多看几层。结果是计算量大幅下降的同时,在细粒度理解任务上反而超过了压缩方案——信息瓶颈问题从根上消失了。

03 多模态 World Model学不好动作,问题可能不在模型而在数据结构

现有的video world model数据集有个结构性缺陷:动作直接绑定到像素变化上,中间没有显式的状态层。模型学到的是「按键A导致画面变化B」,而不是「按键A改变状态S,状态S产生观测O」——这种解耦才是动力系统建模的正确抽象。WildWorld从《怪物猎人:荒野》中自动采集了1.08亿帧数据,关键不在规模,而在每一帧都标注了角色骨骼、世界状态、相机位姿和深度图,把动作-状态-观测三层显式拆开。配套的WildBench评测也从动作跟随和状态对齐两个维度衡量模型能力,实验结果显示现有模型在语义丰富的动作和长程状态一致性上仍然很弱。

04 图像生成 RL训练如何跨越文本和图像两种生成范式?

统一模型的趋势已经明确:文本用自回归,图像用flow matching。但当你想用RL来提升这种混合架构的生成质量时,问题来了——GRPO对文本部分有效,flow matching的连续生成过程却不能直接套用同一套优化框架。UniGRPO的做法是把整个多模态生成建模为一个MDP(马尔可夫决策过程),文本部分走标准GRPO,图像部分走FlowGRPO,用稀疏终端奖励统一驱动。关键改动有两个:去掉classifier-free guidance以保持线性rollout(这对多轮交互场景的扩展性至关重要),以及用速度场上的MSE惩罚替代latent KL来抑制reward hacking。这是一个工程导向的集成方案,但对后续统一模型的post-training提供了可复用的基线。

原文:UniGRPO: Unified Policy Optimization for Reasoning-Driven Visual Generation

也值得关注

今日观察

今天三篇独立工作不约而同指向同一个设计原则:不要默认全量处理输入。

SpecEyes在agent循环层投机预取视觉输入——前提假设是大多数中间步骤的视觉调用本就冗余。VISOR在注意力层让LLM按需查询视觉token,保留全部信息但只在需要时访问。EVA在帧选择层用RL训练agent学会哪些帧值得看,不再遍历所有视频帧。三个团队分别在agent层、注意力层、数据采样层做出了同一个选择,而且都拿到了显著的效率提升而不损精度。

这里的共同点不是「稀疏化」。稀疏化是减少数据量,而这三个工作的核心是把「看什么」的决策权从预处理管线移交给推理过程本身——模型先形成判断,再决定获取哪些输入,而不是先把所有输入处理完再开始思考。这是计算分配逻辑的根本反转。

随着多模态系统的输入规模持续膨胀——视频越来越长、工具链越来越深、图像分辨率越来越高——「先全量处理再推理」的管线结构正在被「先推理再按需获取」替代。如果你在做多模态系统,值得审视一下pipeline里有多少计算花在了「以防万一」的全量预处理上。这些不起眼的预处理步骤,可能就是最大的优化空间。