今日概览

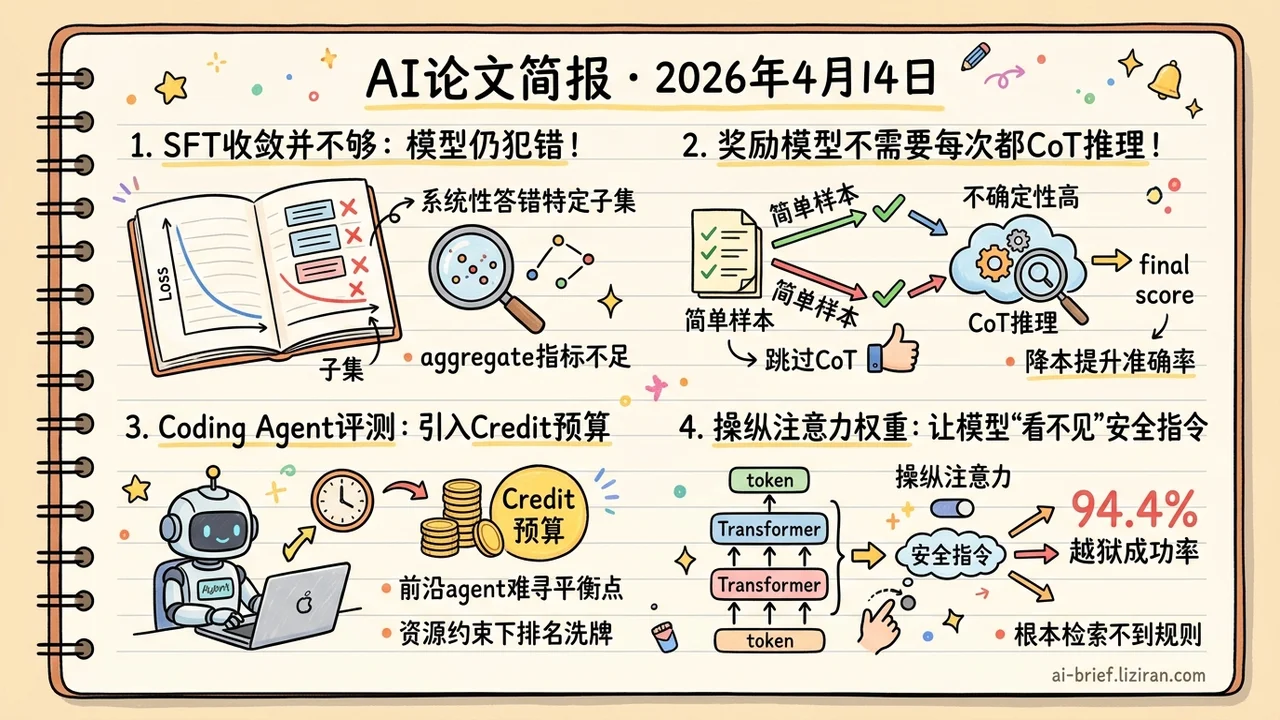

- SFT的loss收敛后,模型仍会在训练集上系统性答错特定子集。跨三个模型家族复现了五类成因,aggregate指标不足以判断微调质量

- 奖励模型不需要每次打分都做CoT推理。E-GRM用生成一致性估计不确定性,对简单样本跳过深度推理,降本的同时反而提升了准确率

- Coding agent评测引入credit预算后排名洗牌。前沿agent在资源约束下找不到最优平衡点,行为高度路径依赖

- 操纵注意力权重让模型「看不见」安全指令,越狱成功率达94.4%。攻击不是让模型违反规则,而是让它在生成时根本检索不到规则

重点关注

01 训练优化 Loss收敛了,模型真的学会了吗?

SFT的loss曲线降到底、训练收敛,按常理该放心了——但这篇ACL论文揭示了一个令人意外的现象:收敛后的模型在自己的训练数据上仍然会系统性地答错一部分样本。作者将这种行为命名为「不完全学习现象」(ILP),并在Qwen、LLaMA、OLMo2三个模型家族上都复现了。更关键的发现是,这不是随机噪声,而是有结构性的五类成因:预训练知识缺失、与预训练知识冲突、训练数据内部矛盾、长序列前段遗忘、以及对罕见模式优化不足。这意味着aggregate指标(整体loss、整体准确率)可以掩盖一批始终学不会的样本——你的模型看起来表现不错,但某些子集上可能一直在犯错。作者提出了一套诊断框架,通过训练和推理信号将未学会的样本归因到具体原因,再针对性干预。对所有在做SFT的团队来说,这项工作的实际启示很直接:仅盯loss曲线判断微调质量是不够的,需要对训练集做细粒度的学习诊断。

02 推理 并非每次打分都需要深想——让不确定性来决定

生成式奖励模型(GRM)用CoT推理来给回答打分是个好思路,但现实是:大量简单样本根本不需要模型「想一遍」就能判断好坏,无差别开启CoT既浪费算力,产生的推理链质量也参差不齐。E-GRM的做法很直接——先并行生成多个快速判断,如果结果趋于一致说明模型「心里有数」,直接出分;分歧大时才启动CoT深度推理。判断不确定性的信号完全来自模型自身的生成行为,不依赖外部标注或任务特定的阈值。在多个推理benchmark上,这种选择性策略在降低推理成本的同时还提升了准确率——说明对简单样本强行推理反而可能引入噪声。

原文:Reason Only When Needed: Efficient Generative Reward Modeling via Model-Internal Uncertainty

03 代码智能 给Agent加上预算限制后,排名还一样吗?

竞赛编程和真实工程有个共同点:每次提交、每次测试、每秒运行时间都有成本。但目前coding agent的主流评测几乎都假设资源无限——可以无限生成token、无限跑本地测试。USACOArena借鉴ACM-ICPC竞赛规则,引入严格的credit机制:生成的每个token、每次本地测试、每秒耗时都从固定预算中扣除,迫使agent在准确率和资源消耗之间做真正的取舍。初步结果显示,前沿单agent和agent swarm在这种约束下都找不到最优平衡点,且行为高度路径依赖——起始策略不同,最终表现差异很大。这意味着「无限资源下跑分最高」不一定等于「实际部署中最划算」。

原文:Credit-Budgeted ICPC-Style Coding: When Agents Must Pay for Every Decision

04 安全对齐 让模型「看不见」规则,比强迫它违反规则更有效

以往的多模态模型越狱攻击走的是硬碰硬路线——优化图像扰动,直接让模型产生有害输出。这篇ACL论文换了个思路:与其对抗安全机制,不如操纵注意力模式,让模型根本「看不到」安全指令。具体做法是一推一拉:抑制模型对system prompt中安全相关token的注意力,同时把生成锚定在对抗性图像特征上。在Qwen-VL上攻击成功率从基线的68.8%提升到94.4%,收敛还快了40%。但更有价值的是机制层面的发现:成功攻击会将模型对安全指令的注意力权重压低80%——模型不是「知道规则但选择违反」,而是在生成时根本没有检索到规则,做安全防御的团队需要认真对待这个攻击面。