今日概览

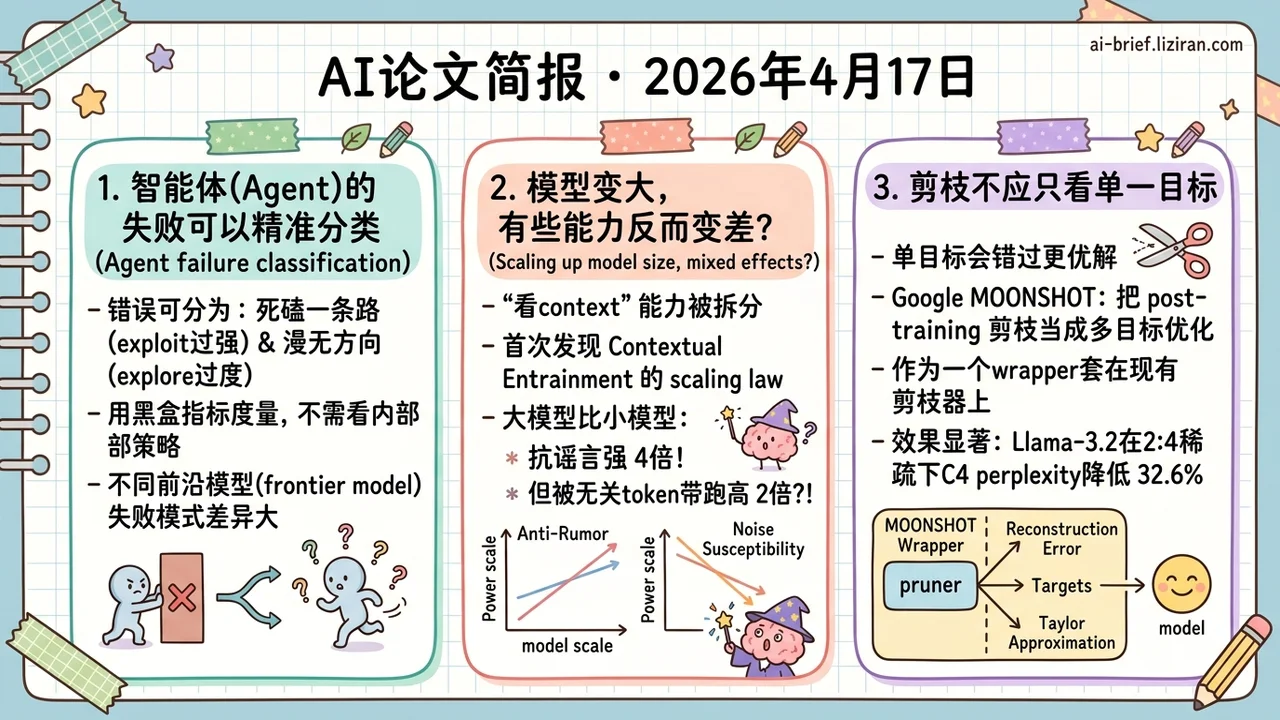

- Agent失败可以拆成两类可测的错误:死磕一条路(exploit过强)和漫无方向(explore过度)能用黑盒指标分开度量,不需要访问模型内部策略,frontier模型失败模式差异明显

- scaling把「看context」拆成两种反向变化的子能力。 Google在两个模型家族上给出首个contextual entrainment的scaling law:大模型抵抗反事实谣言的能力是小模型4倍,被无关token带跑的概率反而是2倍

- 剪枝只优化单一目标会错过更优解:Google MOONSHOT把post-training one-shot pruning当多目标优化,作为wrapper套在现有剪枝器上,Llama-3.2在2:4稀疏下C4 perplexity最多降32.6%

重点关注

01 Agent 把「我的Agent不work」拆成两类可测的错误

调Agent时经常听到「我的agent不work」,但到底是卡在一条死路上不换方向(exploit过强)还是一直东张西望没收敛(explore过度),大多数人说不清。这篇工作搭了一个可控的2D网格环境,任务用DAG表示,通过调整地图参数可以单独放大探索或利用的难度。关键是作者设计了一个policy-agnostic的指标——不用访问模型内部策略,只从行为序列就能拆出两类错误各自的占比。他们在这套环境下测了一批frontier模型,发现不同模型的失败模式差异明显,reasoning模型整体更稳,而且通过简单的harness工程就能同时改善两个维度。局限也很明显——环境是合成的,真实任务里explore和exploit往往互相纠缠——但对正在调agent、想把「不work」这句话拆得更具体的团队,这套评测框架和开源代码值得拿去跑一跑自己的baseline。

原文:Exploration and Exploitation Errors Are Measurable for Language Model Agents

02 推理 模型越大,抗谣言能力↑,抗噪声能力↓

我们一直把「模型变大」当成一个整体进步,但Google这篇给出了首个contextual entrainment的scaling law,把这个整体拆开了。在Cerebras-GPT(111M-13B)和Pythia(410M-12B)两个家族上,最大模型抵抗反事实谣言的能力是最小模型的4倍,但被无关token带跑的概率反而是2倍——两条曲线都是干净的power-law,方向却相反。作者把这解释成两种功能上独立的机制:语义过滤随scale增强,机械性复制随scale增强,恰好分叉。换句话说,「看context」不是一种能力,是两种被同一个旋钮反向调节的能力。对RAG和long-context场景,这意味着升级到更大模型可能修好了一类幻觉,同时打开了另一类。

原文:Better and Worse with Scale: How Contextual Entrainment Diverges with Model Size

03 推理加速 剪枝为什么只盯一个目标

Post-training one-shot剪枝是部署压缩里性价比最高的路径——拿到预训练模型直接剪,不用重训。但现有方法几乎都只优化单一目标:要么layer-wise重建误差(保局部输出一致),要么二阶Taylor近似(保训练loss)。MOONSHOT的观察是这两个目标在不同架构和稀疏度下互有胜负,没有哪个一直最优。Google的做法是把它变成多目标联合优化,并且作为wrapper套在现有剪枝算法上,不替换它们。在Llama-3.2和Llama-2的2:4稀疏下C4 perplexity降低最多32.6%,ViT在70%稀疏度的ImageNet-1k准确率提升5+个点。关键是保留了state-of-the-art剪枝器的效率——计算inverse Hessian的过程被重新设计以适应十亿参数规模。

原文:MOONSHOT : A Framework for Multi-Objective Pruning of Vision and Large Language Models