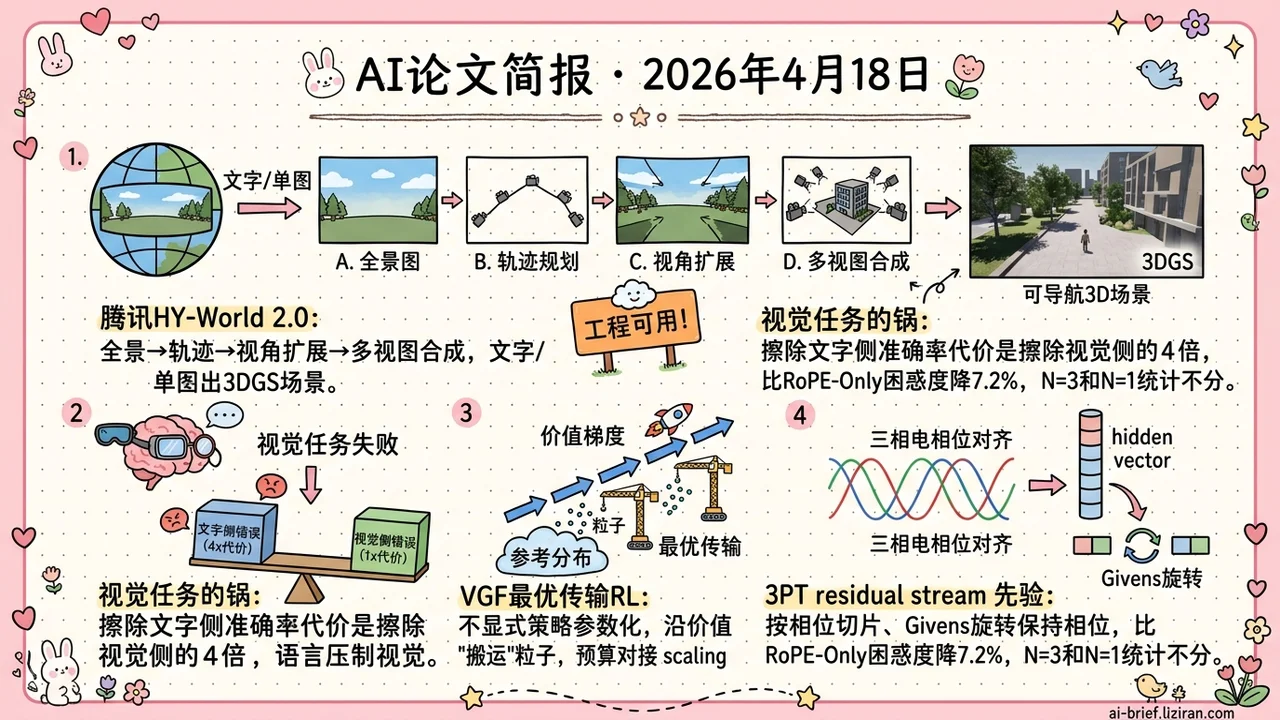

今日概览

- 腾讯HY-World 2.0把3D世界生成做进工程可用:四阶段pipeline(全景→轨迹→视角扩展→多视图合成),文字或单图直接出可导航3DGS场景,开源对标闭源Marble。

- 视觉任务的锅,其实是文字在背:Stanford的centroid替换探针在7个多模态模型上测出擦除文字侧的准确率代价是擦除视觉侧的4倍,顺着做对比解码单任务最高+16.9%,且不用重训。

- VGF把RL微调重新框成最优传输:不显式参数化策略,沿价值梯度「搬运」参考分布的粒子,传输预算天然对接test-time scaling;思路干净,但HF只2赞,先列入观察。

- 3PT给residual stream塞进「三相电」先验:hidden vector按cyclic channel切片、块间用Givens旋转保持相位对齐,123M规模比RoPE-Only困惑度降7.2%,但N=3和N=1统计上区分不开,验证规模有限。

重点关注

01 图像生成 腾讯把3D世界生成拆成四段流水线,对标闭源Marble

腾讯这次交出的HY-World 2.0是一套完整工程,不是某个单点模块。输入一段文字或一张图,输出可以在3DGS(3D高斯溅射)引擎里自由导航的场景——中间走了四步:先用HY-Pano 2.0生成全景底图,再用WorldNav规划相机轨迹,接着用WorldStereo 2.0基于关键帧扩展视角、保持跨帧一致性,最后用WorldMirror 2.0做多视图重建合成。更实用的是还附带了WorldLens渲染平台,支持IBL自动光照、碰撞检测、角色接入。benchmark上号称在开源里SOTA,和闭源Marble可比。四阶段里WorldStereo 2.0的跨帧一致性是最关键的一环——3D世界生成最大的坑一直是视角切换时的几何漂移和纹理跳变,前置这一步做稳,后面的多视图重建才有合理输入,也是HY-World相对只做单图/短视频的方案能撑起长距离自由导航的核心原因。HF 68赞不是噱头——开源3D世界模型的社区需求一直被低估,这种「全景→轨迹→扩展→合成」的pipeline思路,比任何单点新architecture对实际做产品的人都更有参考价值。

原文:HY-World 2.0: A Multi-Modal World Model for Reconstructing, Generating, and Simulating 3D Worlds

02 多模态 视觉任务的锅,其实是文字在背

按理说视觉任务做不好,问题应该出在视觉模块。但Stanford的一个极简探针给出了反直觉答案:把每个token替换成最近的K-means中心(相当于「擦除」该模态的结构信息),在7个主流多模态模型、三种架构上,擦除文字侧的准确率代价比擦除视觉侧高出4倍——即便是需要视觉推理的任务也一样,语言表征在压制视觉。顺着这个不对称做文字中心对比解码,单任务准确率最高提升16.9%,不用重训。更有意思的是标准微调模型增益明显(平均+5.6%),偏好优化过的只有+1.5%,暗示偏好优化可能无意中已经在调整模态平衡。这个探针最大的价值不是指标本身,而是它能直接套到任何VLM上做诊断。

03 训练优化 用「搬运」代替参数化,RL微调能不能走第三条路?

behavior-regularized RL要在「别跑太远」和「能真正超越参考模型」之间找平衡,目前大模型上的两条主流路径——重参数化策略梯度和拒绝采样——一条难scale,一条太保守。VGF把这件事重新定义成一个最优传输问题:不显式参数化策略,而是把参考分布里的「粒子」沿着价值梯度一点点搬到更优的位置,搬多远由传输预算控制,这也自然对应上了test-time scaling。论文在D4RL、OGBench和LLM RL任务上都报了SOTA,思路本身干净。但HF只有2个赞,社区关注度不高,方法在大规模LLM RL finetuning上的实际稳定性和工程成本还需要更多复现来判断。

原文:Reinforcement Learning via Value Gradient Flow

04 模型架构 residual stream里塞进「三相电」先验,真能泛化吗

3PT的做法是把hidden vector切成N个等大的cyclic channel,每层attention和FFN之间用Givens旋转保持各channel相位对齐。作者用三相交流电作类比——N=3时三个相位互相抵消,没有反相关对——并在垂直于channel的一维DC子空间里注入一个固定的r(p)=1/(p+1)位置profile,和RoPE正交组合。WikiText-103上123M参数,相对匹配的RoPE-Only baseline困惑度降7.2%,多出来的参数只有1,536个,收敛步数快1.93倍。问题在验证规模:123M参数、单数据集、三seed,N=3和N=1在统计上区分不开,作者自己也承认N更像是参数共享的旋钮而不是最优点。架构创新的通病是小规模好看的先验到scale上往往就被稀释掉——RoPE、Mamba、MoE都是经过两三年反复复现才真正立住的。