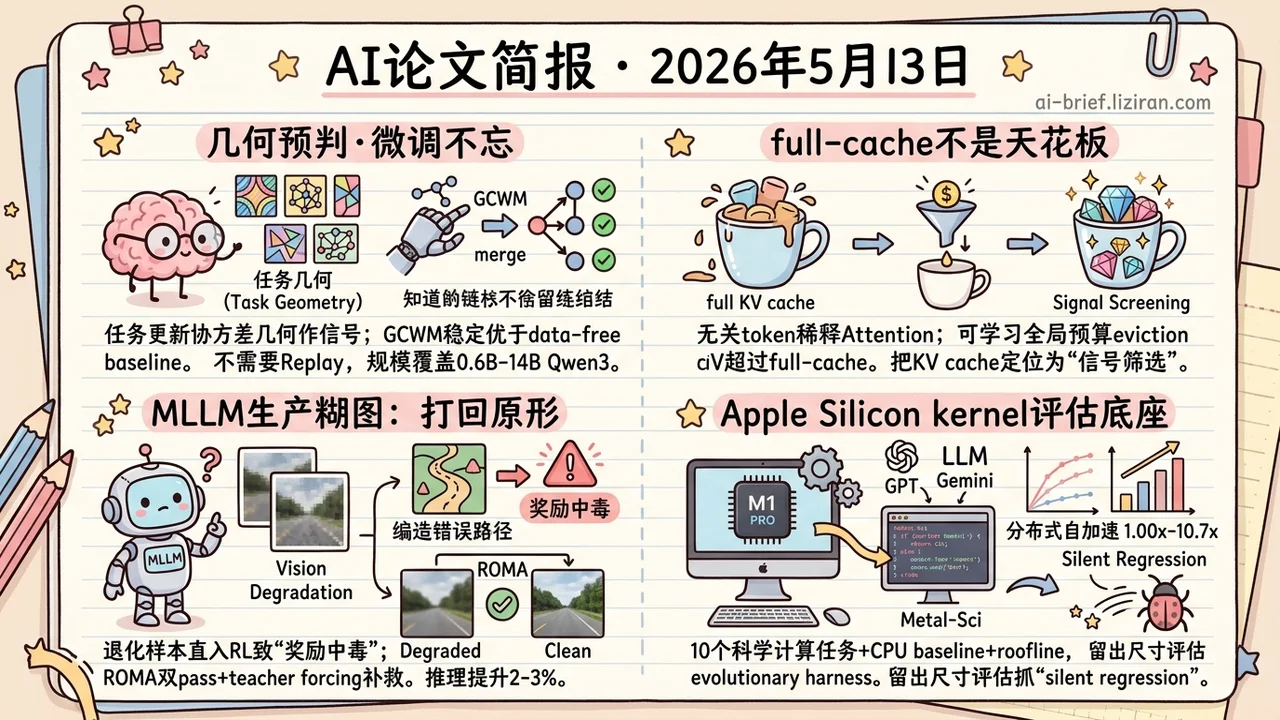

今日概览

- 几何冲突判据预判持续微调遗忘:把任务的参数更新协方差几何当作可测信号,GCWM在Qwen3 0.6B-14B、domain和capability两种continual场景下都稳定优于data-free baseline。

- full-cache不再是KV eviction的天花板——长上下文里无关token会稀释attention,可学习的全局预算eviction反而能超过full-cache,KV cache该被重新定位为「信号筛选」。

- MLLM在生产环境被糊图打回原形:直接把退化样本扔进RL rollout会「奖励中毒」,ROMA用双forward pass配合teacher forcing把视觉退化做成训练侧补救。

- Apple Silicon侧LLM kernel调优有了评估底座:Metal-Sci把10个科学计算任务、CPU baseline、roofline fitness和进化式搜索harness一起打包,并用留出尺寸抓搜索集上的silent regression。

重点关注

01 训练优化 持续微调会不会挤掉旧能力,事先用几何冲突就能看出来

持续微调(continual post-training)现在多了一个事前可测的判据:把每个post-training任务用它对参数的更新来表示,分析这个更新的协方差几何——也就是更新「指向哪里、怎么扩散」。论文的核心观察是,遗忘不来自任务之间天然冲突,而是新任务诱导的几何与模型当前状态的几何不对齐——对齐就能迁移能力,不对齐就会把旧知识挤出去。基于这个判据,他们提出GCWM(Geometry-Conflict Wasserstein Merging):用Gaussian Wasserstein重心构建共享度量,按几何冲突的程度来门控合并方式,整个流程不需要replay数据。在Qwen3 0.6B到14B规模上、domain-continual和capability-continual两种持续训练场景下,GCWM都稳定优于其他data-free baseline。对持续SFT流水线团队的实际意义在于:可能从靠replay/regularization事后兜底,转向「先预判再决定要不要训」的设计。不过摘要里没披露判据本身的计算成本和公式细节,能否在大模型上低开销地实时算出来,还得看正文确认。

原文:Geometry Conflict: Explaining and Controlling Forgetting in LLM Continual Post-Training

02 推理加速 扔掉无关token后,长上下文反而更准了

做长上下文推理的人都默认一件事:KV cache eviction(淘汰键值缓存)的目标是「尽量逼近full-cache」——留全部才是上限。这篇给出反直觉的结论:长上下文里full-cache根本不是最优,太多无关token会稀释attention,把模型的注意力从有用证据上拉走。他们训了一个轻量的「保留门控」,给每个token打一个未来效用分,跨层、跨头、跨模态在统一显存预算下直接竞争。结果是显存大幅下降的同时,长上下文语言推理、视觉-语言推理、多轮对话上匹配或超过full-cache。这把KV cache从一个「压缩问题」改写成了「信号筛选问题」——eviction不只是用来省钱,可能还是提升长上下文质量的手段。

原文:Make Each Token Count: Towards Improving Long-Context Performance with KV Cache Eviction

03 多模态 实验室里能推理的MLLM,到生产环境就被一张糊图打回原形

用GRPO这类critic-free RL把多模态推理能力推上去之后,部署侧很快撞墙——监控画面糊一点、扫描件分辨率低一点、图片走过几次JPEG压缩,准确率立刻明显下滑。传统视觉鲁棒性套路(静态数据增强、value-based正则)在这种RL训练里不好直接搬:rollout阶段直接喂退化图会引发「奖励中毒」,模型对着糊掉的图编出错误推理路径,反而把策略带歪。ROMA的做法是用第二次forward pass配合teacher forcing来评估退化视图,再加token级KL惩罚和「只在正确轨迹上做正则」两个约束,避开崩盘问题。在Qwen3-VL 4B/8B的七个推理benchmark上,已见和未见退化分别提升2.4%和2.3%,干净输入的精度基本没掉。提升幅度算不上惊艳,但把视觉退化当作RL训练目标而不是预处理或后处理问题来解,对真要把多模态模型推到生产的团队是个值得跟进的训练侧补救路径。

原文:Reinforcing Multimodal Reasoning Against Visual Degradation

04 代码智能 Apple Silicon上的LLM kernel调优,终于有了像样的评估底座

LLM自动生成GPU kernel这条路线绝大多数工作跑在CUDA上,Apple Silicon侧做推理或研究的团队长期缺一套标准化的benchmark和搜索harness。Metal-Sci把10个科学计算kernel任务(涵盖stencil、n-body、Boltzmann、分子动力学、多kernel PDE、FFT六类优化模式)连同CPU参考实现、roofline锚定的fitness function一起打包,再配一个轻量的进化式搜索loop,让LLM在M1 Pro上自己迭代kernel代码。匹配评测了Claude Opus 4.7、Gemini 3.1 Pro、GPT 5.5三个模型,分布内自加速从1.00×到10.7×不等。论文强调的真正方法论贡献是那个「留出尺寸」评估:Opus生成的HMC kernel在搜索集上赢了,但换到未见过的维度就采样错误;GPT的FFT3D最佳方案在分布内拿到2.95×加速、到256³留出集崩成0.23×——这类silent regression用单一搜索集分数根本看不见。对Mac/iOS侧做ML工程的团队来说,这是一块缺失已久的基础设施,工具链够不够完整还要看后续社区怎么接上。

原文:Metal-Sci: A Scientific Compute Benchmark for Evolutionary LLM Kernel Search on Apple Silicon

也值得关注

今日观察

把今天的 Geometry Conflict 和 KV Cache 这两篇放在一起读,能看到 LLM 内部一个反复出现的具体动力学:默认 scaling 假设——多训一轮 = 更好、cache 更多 token = 更好——在模型内部并不是单调成立的。Geometry Conflict 把「继续训会不会触发遗忘」翻译成参数更新协方差几何的对齐程度,给出一个事前可测的判据;KV Cache 那篇则证明长上下文里 full-cache attention 反而被无关 token 稀释,learnable eviction 不只是逼近 full-cache,而是能超过它。

两篇背后是同一个动作:用模型内部的几何或 attention 结构去解释什么时候「更多」开始反向起作用,再据此造出一个可在线读的取舍工具,而不是靠经验拍板。也值得关注里的 Multi-Indicator Data Selection 从数据侧也在做同样的事——instruction tuning 数据选择函数本身比数据数量更值得建模,joint task-model 的自适应权重比静态多维启发式更精细。

具体建议:手上跑持续 SFT 流水线、长上下文推理或者大规模 SFT 数据管线的团队,可以挑一个内部指标(参数更新协方差、attention 分布、单条数据的贡献度)跑一轮实测,看现有 scaling 假设在你的场景下是不是已经过了拐点。过了拐点的话,下一步该投入的不是「再多训一点 / 再 cache 一点 / 再多采一点数据」,而是把这个指标做成在线可读的依据,让流水线自己决定停在哪。