今日概览

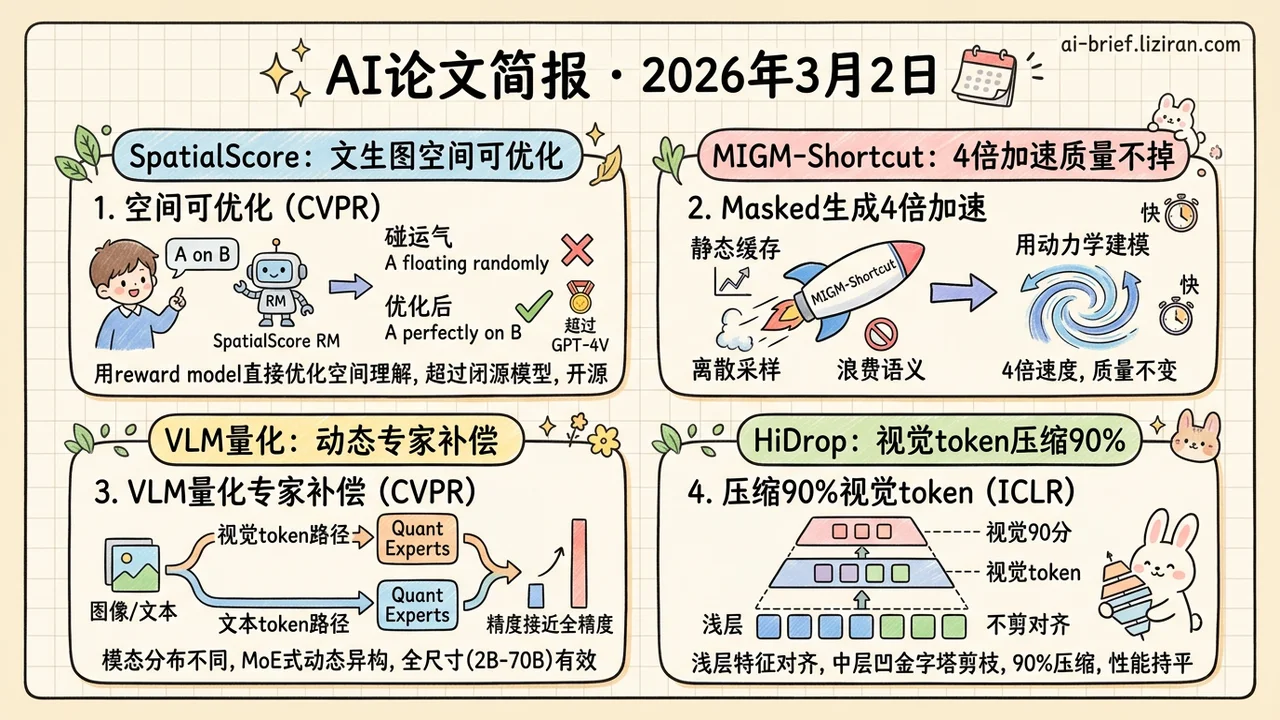

- 空间关系可以从「碰运气」变成可优化的目标,SpatialScore用reward model给生成模型装上空间理解信号,专用小模型空间评估超过GPT-4V。CVPR接收,数据集开源

- Masked图像生成4倍加速且质量不掉:用动力学建模替代静态缓存,把离散采样丢掉的语义信息学回来

- VLM量化不能一刀切,视觉和语言token分布差异大,MoE式动态误差补偿让不同token走不同修复路径。2B到70B都有效,CVPR接收

- 90%视觉token可压缩。HiDrop发现浅层做特征对齐不该剪,分层策略匹配每层真实功能是关键。ICLR接收

重点关注

01 图像生成 把「左边放猫右边放狗」变成可优化的目标,而不是反复抽卡

文生图模型理解语义没问题,但理解空间关系一直靠运气——「A在B左边」这类指令,模型经常需要多次采样才能碰对。问题的根源是生成过程中缺少对空间正确性的显式反馈信号。SpatialScore的做法是把空间关系的准确性建模为一个reward信号:先用8万多组偏好对训练一个专门评估空间关系的reward model,再用这个reward model做在线强化学习,直接优化生成模型的空间理解能力。这个reward model在空间评估上甚至超过了GPT-4V等闭源模型,说明专用小模型在垂直任务上仍然有优势。CVPR接收,数据集和代码都开源,从工程角度看落地门槛不高。更值得关注的是这套思路的可迁移性:空间关系只是文生图的众多弱项之一,文字渲染、数量控制、属性绑定等问题理论上都可以用同样的「构建偏好数据→训练reward model→RL微调」路径来攻克。

原文:Enhancing Spatial Understanding in Image Generation via Reward Modeling

02 推理加速 离散采样丢掉的语义信息,可以学回来

Masked图像生成模型(MIGM)每一步都要跑完整的双向attention,但采样离散token时,连续特征里的丰富语义其实被浪费了。之前的加速方案靠缓存旧特征来近似未来特征,加速倍率一高误差就崩。MIGM-Shortcut换了个思路:训练一个轻量模型,同时吃之前的特征和已采样token,直接回归特征演化的平均速度场——用动力学建模替代静态缓存。在当前最强的Lumina-DiMOO上实现4倍以上加速且质量不掉,显著推进了MIGM的效率-质量前沿。有意思的是,同天还有SenCache从敏感度分析切入解决类似问题,一个学动态一个学重要性,都在回答「哪些计算可以省」,但方法论完全不同。

原文:Accelerating Masked Image Generation by Learning Latent Controlled Dynamics

03 推理加速 多模态模型量化,视觉和语言token能共用一套补偿策略吗?

想在端侧跑VLM(视觉语言模型),量化压缩几乎是必经之路——但一个被低估的问题是,图像token和文本token的数值分布差异很大,传统PTQ(训练后量化)对所有通道一视同仁地做误差补偿,效果打折扣。Quant Experts的思路是借鉴MoE架构:把重要通道分成「全局通用」和「token相关」两组,前者用一个共享的低秩适配器修复,后者根据具体token动态路由到不同的专家模块做针对性补偿。这样视觉token和语言token各走各的修复路径,不再互相迁就。实验覆盖2B到70B参数规模的VLM,量化后精度接近全精度模型,CVPR接收。

04 多模态 砍掉90%视觉token,多模态大模型反而没变差?

之前的视觉token剪枝方法有个共同的误判:把浅层当成冗余层来剪,但实际上浅层在做视觉-语言特征对齐,剪掉反而破坏融合效果。HiDrop纠正了这一点——浅层不动,等到真正的多模态融合开始时才注入视觉token(Late Injection),然后在中层用凹金字塔曲线逐步剪枝,深层允许提前退出。这套分层策略砍掉约90%的视觉token,性能基本持平,训练加速1.72倍。工程上也做了实用优化:持久位置编码、兼容FlashAttention的token选择,避免动态剪枝带来的隐性开销。ICLR接收,思路扎实。

也值得关注

今日观察

「冗余」这个词在加速研究里用得太随意了。固定步骤缓存假设每N步的计算都可以跳过,均匀剪枝假设所有视觉token同等可丢弃——但今天几篇工作不约而同地推翻了这个前提。SenCache发现扩散模型不同步骤的敏感度差异巨大,盲目缓存某些关键步骤会导致质量断崖;MIGM-Shortcut发现特征演化轨迹是可预测的,与其缓存静态快照不如建模动态过程;HiDrop发现浅层做特征对齐根本不该剪,而中深层的冗余程度随深度非线性变化。三个独立的结论指向同一个方向:模型计算中的冗余是动态的,它随输入内容、时间步、层深度而变化。静态策略本质上是在用平均情况近似每一个具体情况,当模型足够复杂时,这个近似的代价就变得不可忽视。

如果你的推理管线还在用固定间隔的缓存或均匀比例的token丢弃,建议做一次profiling:在实际业务数据上测量不同步骤/不同层的敏感度分布,大概率会发现20%的计算贡献了80%的质量——把省下来的算力重新分配到这些关键位置,比全局加速更划算。