今日概览

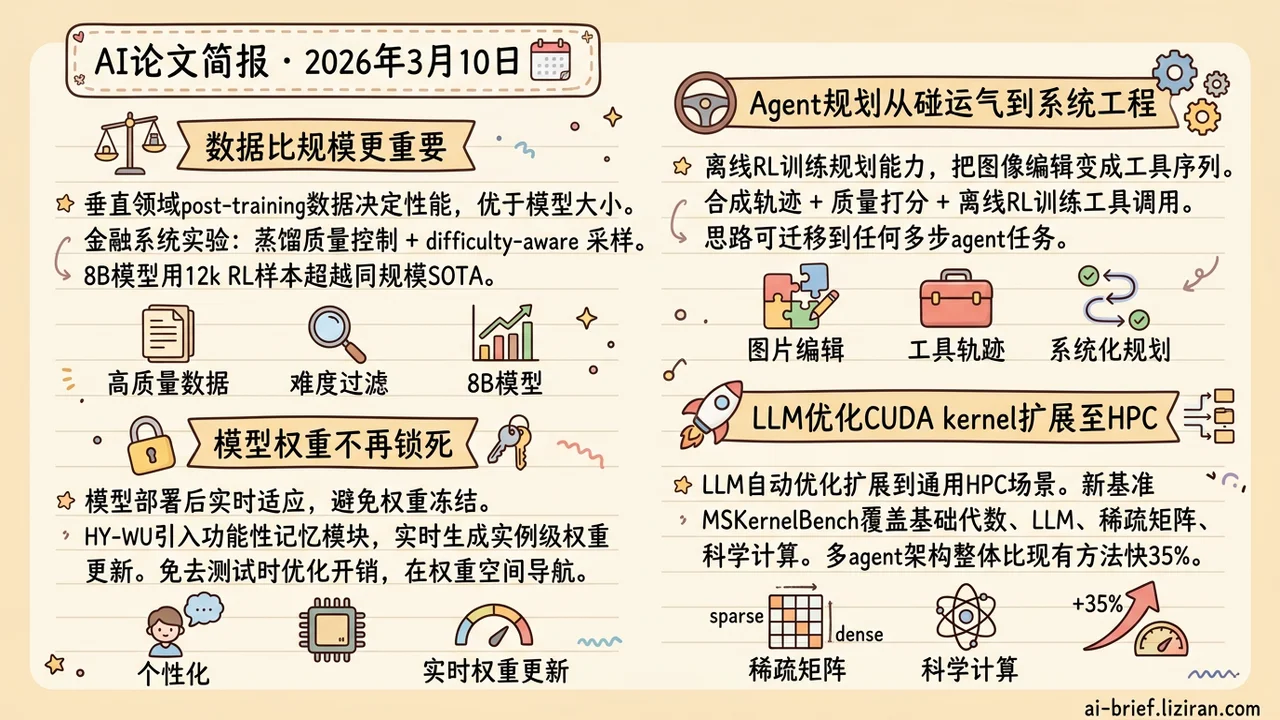

- 垂直领域post-training数据比模型大小更重要:金融场景系统消融实验表明,蒸馏质量控制+difficulty-aware采样让8B模型仅用12k RL样本就超越同规模SOTA

- 离线RL让agent规划从碰运气变成系统工程,微软用合成轨迹+质量打分训练工具调用规划,思路可迁移到任何多步agent任务

- 模型部署后不该被锁死在固定权重上。腾讯HY-WU引入功能性记忆模块,实时生成实例级权重更新,免去测试时优化开销

- LLM优化CUDA kernel扩展到通用HPC场景,新基准MSKernelBench覆盖四类任务,多agent架构整体比现有方法快35%

重点关注

01 训练优化 决定垂直领域模型成败的不是参数量,是post-training数据怎么选

一组金融领域的系统消融实验给出了清晰结论:在垂直领域,post-training数据的质量和难度分布比模型规模更具决定性。研究团队构建了两个数据集——318k条经多阶段蒸馏和验证的CoT(思维链)监督数据用于SFT,以及12k条「难但可验证」的任务用于RL。SFT阶段的核心在于蒸馏源的选择和CoT质量控制,为模型建立扎实的推理基础。RL阶段引入difficulty-aware采样策略,只保留reward信号足够精确且难度适中的样本——过简单的学不到东西,不可验证的会引入噪声。最终8B模型在9个金融benchmark上持续超越同规模开源SOTA,涵盖通用金融任务、情感分析和数值推理三类场景。值得注意的是,整套数据工程pipeline(蒸馏→验证→难度过滤)不依赖金融领域的特殊设计,理论上可迁移到其他垂直领域,但需要在实际场景中验证迁移效果。

原文:Unlocking Data Value in Finance: A Study on Distillation and Difficulty-Aware Training

02 Agent 离线RL训练工具调用规划,图像编辑从碰运气变成系统工程

把图像风格编辑拆解成工具调用序列,然后用离线RL(offline reinforcement learning)在质量打分的轨迹上训练规划能力——微软这套框架的思路值得关注。核心做法是建一个正交的基础变换工具库,让vision-language模型(Qwen3-VL)通过chain-of-thought推理来规划每一步该用哪个工具、参数怎么设。训练数据也很巧妙:合成约3万条带推理链、规划序列和质量分数的轨迹,解决了这类任务没有监督数据的问题。4B和8B参数模型在多数组合任务上超过baseline,人工评估也验证了效果。这条路径的意义不止于图像编辑——任何需要多步工具调用的agent任务,都可以用类似的「合成轨迹 + 质量打分 + 离线RL」来系统性地训练规划能力。

原文:Agentic Planning with Reasoning for Image Styling via Offline RL

03 模型架构 模型出厂之后,权重就不该被锁死

基础模型正在从离线预测工具变成长期运行的部署系统,但权重适配的方式还停留在上一个时代——每次遇到新任务或用户偏好变化,要么微调覆盖旧知识,要么用一组固定参数硬撑所有场景。腾讯提出的HY-WU换了个思路:不再反复改写共享权重,而是引入一个「功能性记忆」模块——一个神经网络生成器,根据当前输入条件实时合成权重更新,为每个实例生成专属的算子参数。核心优势在于部署后不需要重新训练或测试时优化,模型就能持续适应新需求。论文用图像编辑做了验证,但更值得关注的是它提出的架构范式:把适配压力从「覆盖一个固定权重点」转移到「在权重空间中按需导航」。

04 代码智能 LLM优化CUDA kernel,终于不止是ML算子了

用LLM自动优化CUDA kernel的研究之前基本只在PyTorch算子上验证,但GPU性能工程的大头其实在通用HPC和科学计算。CUDAMaster把优化范围扩展到了稀疏矩阵运算、科学计算例程等多个场景,同时发布了MSKernelBench作为跨场景评估基准,覆盖基础代数、LLM算子、稀疏矩阵和科学计算四类任务。系统采用多agent架构结合硬件profiling,自动构建编译执行工具链,整体比现有方法Astra快约35%,部分算子接近甚至超过cuBLAS。这是「LLM做性能工程」从demo走向实用的一步,不过从摘要看主要还是benchmark层面的验证,离真实工程中替代手工调优还有不少路要走。

原文:Making LLMs Optimize Multi-Scenario CUDA Kernels Like Experts