今日概览

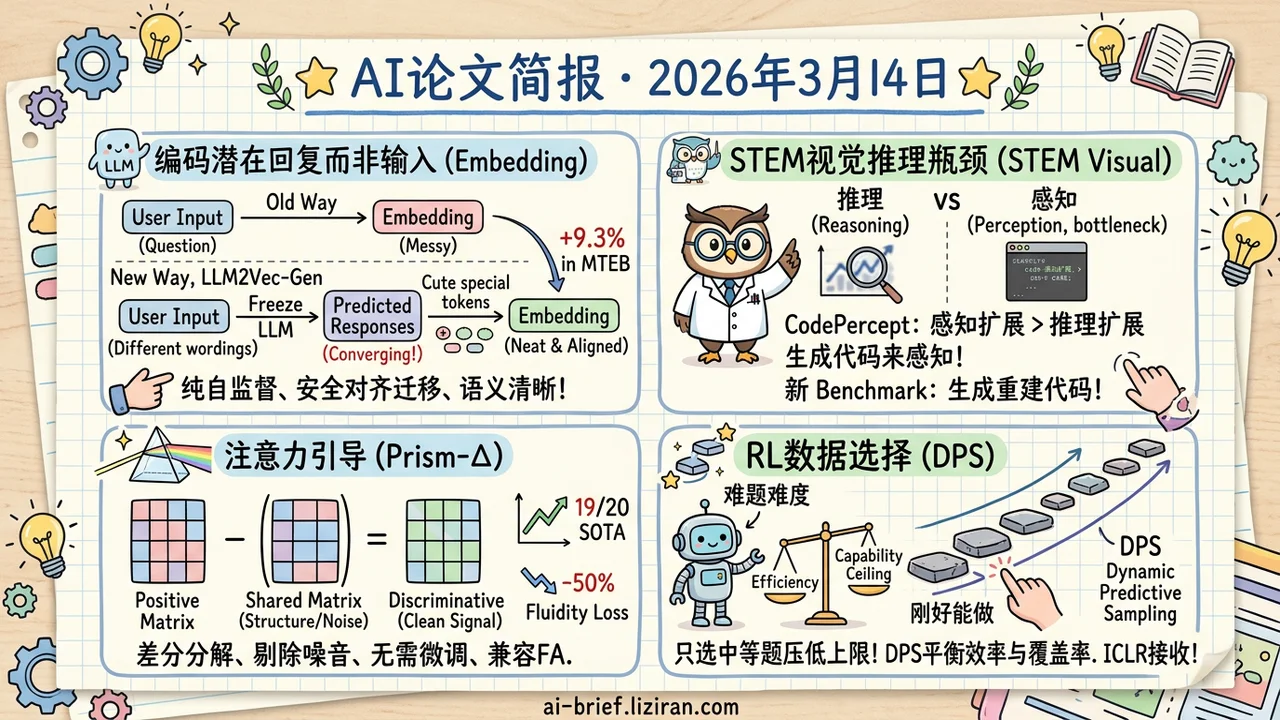

- 编码LLM的潜在回复而非用户输入做embedding,纯自监督训练在MTEB上比最好的无监督方法提升9.3%,LLM的安全对齐也被迁移到embedding空间。

- STEM视觉推理的真正瓶颈在感知而非推理。 CodePercept消融实验显示扩展感知组件收益持续更高,用可执行代码做感知脚手架效果显著。

- 差分分解交叉协方差矩阵做注意力引导:Prism-Δ在20组评测中19组追平或超过SOTA,流畅度损失减半,兼容FlashAttention无需微调。

- RL数据选择只挑「刚好够难」的题会压低模型上限,DPS用训练动态预测平衡效率与覆盖率,数学、规划、视觉几何等多类任务验证有效。ICLR接收。

重点关注

01 检索 不编码问题,编码答案——Embedding的思路可以反过来

Text embedding的核心挑战是把千变万化的输入映射到语义相近的向量空间。LLM2Vec-Gen的洞察很直觉:与其编码用户问了什么,不如编码模型会怎么回答——因为不同措辞的问题,好的LLM给出的回答是趋同的。具体做法是在输入末尾加几个可训练的特殊token,优化它们来表示LLM的潜在回应,同时用一个无监督embedding教师提供蒸馏目标。整个过程LLM骨干完全冻结,不需要任何配对数据,纯自监督训练。在MTEB(大规模文本嵌入基准)上比最好的无监督方法提升了9.3%,同时有害内容检索降低43.2%——这意味着LLM的安全对齐能力也被迁移到了embedding里。更有意思的是,生成的embedding可以被解码回文本,你能直接看到模型在表示什么,这在传统对比学习的embedding上是做不到的。

原文:LLM2Vec-Gen: Generative Embeddings from Large Language Models

02 多模态 STEM视觉推理的瓶颈,居然不在推理上

直觉告诉我们,模型做不好STEM视觉题,一定是推理能力不够。CodePercept做了一组系统性消融实验,结果出乎意料:独立扩展感知组件的收益持续超过扩展推理组件——模型不是「想不明白」,而是「看不清楚」。他们的解法也很有意思:让模型生成可执行代码来解析视觉信息,用代码的精确语义替代自然语言的模糊描述,等于给感知搭了一个结构化的脚手架。团队构建了100万组图像-描述-代码三元组数据集来训练这种能力,还设计了新benchmark——要求模型生成能重建原图的代码,比答对选择题更能反映真实感知水平。

原文:CodePercept: Code-Grounded Visual STEM Perception for MLLMs

03 可解释性 不微调就能引导模型聚焦关键上下文?

注意力引导方法一直用正样本提取重要方向,但正样本和负样本共享的结构模式也会被一起提取出来——这就是信号不纯的根源。Prism-Δ的做法是对正负样本的交叉协方差矩阵(cross-covariance matrix)做差分分解,只保留判别性最强的子空间方向,把共享成分剔除。每个注意力头获得连续的重要性权重,弱但有用的头以降低强度参与引导,同时扩展到Value表示以捕获Key方法遗漏的内容通道信号。20组评测配置中19组追平或超过现有最优,引导带来的流畅度损失减半,长上下文检索场景额外提升4.8%。不需要微调、兼容FlashAttention、几乎无额外显存——对长文档场景是个实用的推理时控制工具。

原文:Prism-Δ: Differential Subspace Steering for Prompt Highlighting in Large Language Models

04 训练优化 只练「刚好够难」的题目,推理模型的天花板在哪?

RL微调推理模型时,主流的在线数据选择策略有个微妙的盲区:它们把算力集中在模型「刚好能做对」的题目上,因为这类样本梯度信号最强、学得最快。但代价是模型完全做不到的难题被系统性地跳过——短期效率高了,长期能力天花板却被压低。DPS(Dynamics-Predictive Sampling)的思路是把每道题的求解进展建模为动态系统,用隐马尔可夫模型追踪模型对每道题的「解题状态」变化,再通过贝叶斯推断预测哪些题目值得投入算力,不需要先跑一遍完整rollout来筛选。这样既保留了对中等难度题目的高效利用,也不放弃当前做不到但可能即将突破的难题。ICLR接收,在数学、规划、视觉几何等多类任务上验证有效。

原文:Dynamics-Predictive Sampling for Active RL Finetuning of Large Reasoning Models

也值得关注

今日观察

今天三篇论文独立撞上了同一个工程教训。CodePercept发现STEM视觉推理的瓶颈在感知而非推理——扩展感知组件的收益持续更高。LLM2Vec-Gen发现embedding该编码的不是输入本身,而是模型的潜在回复。DPS发现RL数据选择追求采样效率会牺牲覆盖率,压低能力上限。

三个不同领域,同一个模式:直觉认定的瓶颈不是实际的瓶颈。

这三组团队的共同点是先做系统性消融来验证瓶颈假设,而非在直觉方向上硬堆资源。如果你正在做性能优化,不妨先花一天做控制变量实验:把你认定的瓶颈组件用oracle替换或冻结,测量系统性能变化——如果替换后提升不大,真正的瓶颈在别处。