今日概览

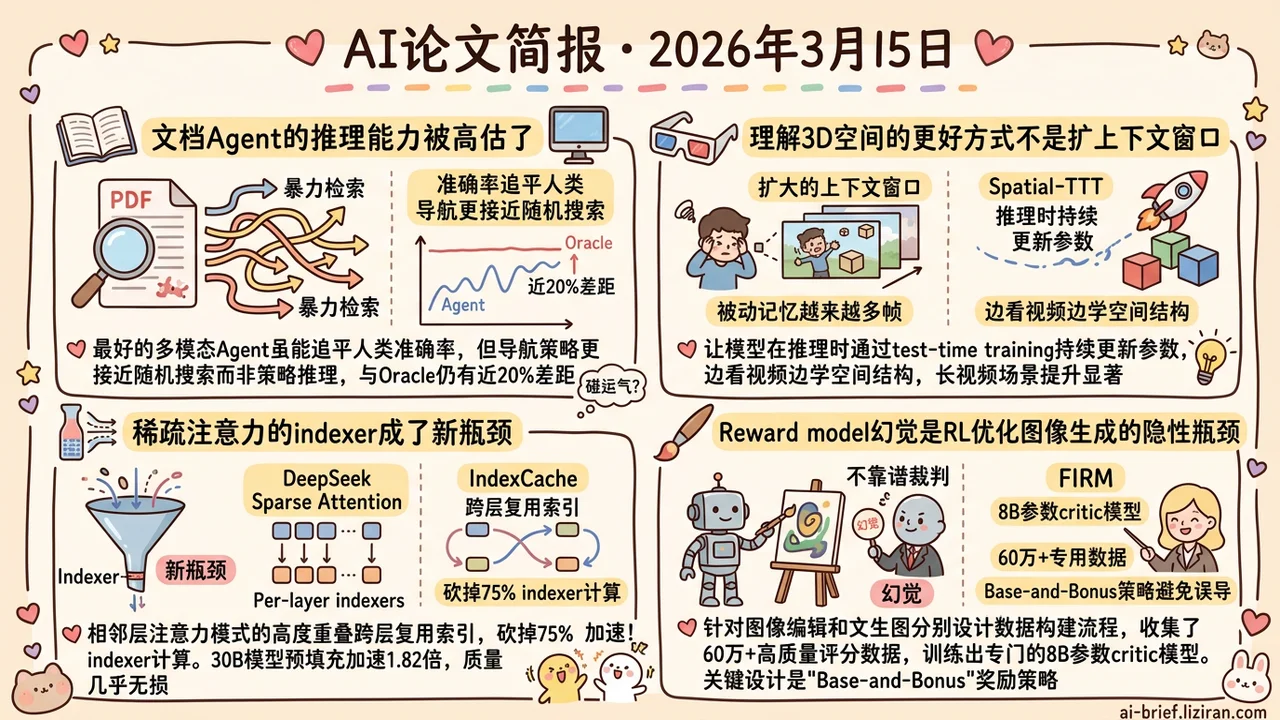

- 文档Agent的推理能力被高估了,MADQA用经典测试理论设计的benchmark表明,最好的多模态Agent虽能追平人类准确率,但导航策略更接近随机搜索而非策略推理,与Oracle仍有近20%的差距

- 理解3D空间的更好方式不是扩上下文窗口:Spatial-TTT让模型在推理时通过test-time training持续更新参数,边看视频边学空间结构,长视频场景提升显著

- 稀疏注意力的indexer成了新瓶颈,IndexCache利用相邻层注意力模式的高度重叠跨层复用索引,砍掉75% indexer计算。30B模型预填充加速1.82倍,质量几乎无损

- Reward model幻觉是RL优化图像生成的隐性瓶颈。FIRM从60万+专用数据出发训练8B参数critic模型,用Base-and-Bonus策略避免单一指标误导优化方向,全套开源

重点关注

01 Agent 多模态Agent在文档任务上的推理能力被高估了

多模态Agent在处理文档密集型任务时看起来越来越能干,但一个新benchmark给出了更冷静的诊断。MADQA包含2250道基于800份异构PDF的问题,研究团队用CTT(经典测试理论)设计题目来最大化对不同Agent能力的区分度。结果:最好的Agent在准确率上能追平人类搜索者,但两者答对的题目大不相同——Agent靠的是大量暴力检索来弥补策略规划的不足。更关键的数据是,Agent与Oracle性能之间仍有近20%的差距,而且Agent会反复陷入无效循环,消耗大量计算却不产出新信息。对正在构建Agent产品的团队来说,这是个产品风险信号:你的Agent在Demo里看起来很聪明,但在实际文档工作流中,它的「推理」可能只是搜索空间上的随机游走。benchmark和评估工具已开源,值得拿来测试自家系统到底是在「导航」还是在「碰运气」。

原文:Strategic Navigation or Stochastic Search? How Agents and Humans Reason Over Document Collections

02 多模态 理解3D空间不靠更长上下文,靠模型在推理时改自己的权重

处理长视频里的空间信息,直觉做法是扩大上下文窗口塞更多帧。但Spatial-TTT换了个思路:让模型在推理时通过test-time training持续更新一部分参数(「快权重」),边看视频边学当前场景的空间结构。关键设计是用3D时空卷积做空间预测,引导模型主动捕捉帧间的几何对应关系,而不是被动记忆越来越多的帧。在视频空间理解benchmark上达到SOTA,长视频场景提升尤为明显。68个HF upvote说明社区嗅到了新范式——空间信息的核心挑战不是记住更多帧,而是怎么选择性保留和更新。

原文:Spatial-TTT: Streaming Visual-based Spatial Intelligence with Test-Time Training

03 推理加速 稀疏注意力省了计算,但谁来省稀疏注意力的开销?

DeepSeek Sparse Attention(DSA)用轻量indexer筛选top-k token,把核心注意力从O(L²)降到了O(Lk)——但indexer本身还是O(L²),而且每层都要独立跑一遍。IndexCache的观察很直接:相邻层选出的top-k token高度重叠,没必要每层都重新算。做法是把层分成少数「完整层」(运行自己的indexer)和多数「共享层」(直接复用邻近完整层的索引),提供training-free和training-aware两种配置方式。在30B参数的DSA模型上,砍掉75%的indexer计算,预填充加速1.82倍、解码加速1.48倍,质量几乎没有损失,GLM-5生产模型上的初步实验也确认了这个结论。

原文:IndexCache: Accelerating Sparse Attention via Cross-Layer Index Reuse

04 图像生成 奖励模型「看走眼」时,RL优化越努力效果越差

用RL优化图像生成有个容易被忽视的问题:充当裁判的reward model本身会产生幻觉,给出不靠谱的分数——模型不是生成能力不够,而是被错误的评分信号带偏了优化方向。FIRM从数据源头开始解决这个问题:针对图像编辑和文生图分别设计数据构建流程,收集了60万+高质量评分数据,训练出专门的8B参数critic模型。关键设计是「Base-and-Bonus」奖励策略——编辑任务用一致性调节执行分数,生成任务用质量调节对齐分数,避免单一指标误导优化。在benchmark上FIRM训练出的模型都有明显提升,且所有数据、模型和代码已开源,做相关方向的团队可以直接拿来用。

也值得关注

今日观察

MADQA和FIRM,一个评估文档Agent,一个训练图像生成模型——两个看似无关的方向,暴露的却是同一个盲区:系统内部那个负责「判断」的组件,本身不可靠。

MADQA用经典测试理论设计了高区分度benchmark,结果发现Agent在文档集合上的导航策略更接近随机游走。Agent的内部规划器给出了看似合理的检索决策,但效果和随机搜索差不多——问题不在执行层,在规划层。FIRM发现了镜像问题:RL优化图像生成时,reward model产生幻觉评分,优化器忠实地朝着噪声方向走,越努力效果越差——问题不在生成器,在裁判。两个案例指向同一件事:系统中充当critic的组件,从未被单独验证过是否称职。

如果你在构建compound AI系统,可以立刻做一件事:列出pipeline中所有扮演「判断者」角色的组件——规划器、打分器、路由器、验证器——对每一个单独跑对抗性测试。如果它的判断准确率撑不起你赋予它的决策权重,要么换掉它,要么在架构层面降低系统对它的依赖。