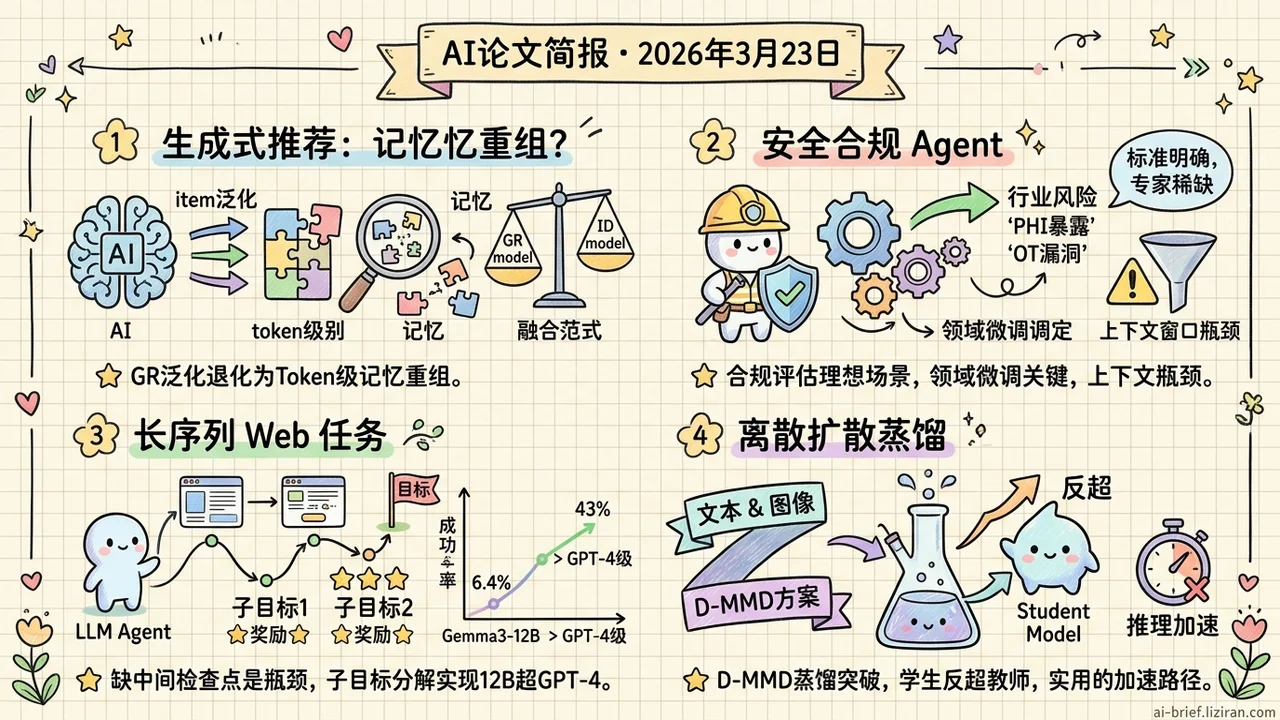

今日概览

- 生成式推荐的「泛化优势」在token级别退化为记忆重组,按实例融合两种范式比选边站更务实。

- 安全合规评估因标准明确、专家稀缺成为Agent理想场景:领域微调能识别通用模型遗漏的行业风险,但上下文窗口是实际瓶颈。

- 长序列web任务的瓶颈是缺少中间检查点,子目标分解让12B开源模型成功率从6.4%跳到43%,超过GPT-4级系统。

- 离散扩散首次有了有效蒸馏方案——D-MMD在文本和图像两域验证,学生模型反超教师。

重点关注

01 检索 生成式推荐的泛化优势,拆开看可能只是token级的记忆

生成式推荐(GR)取代传统ID推荐的核心论据之一是「泛化能力更强」——能预测训练时没见过的item组合。这篇工作设计了一套拆解框架,把每个预测实例按所需能力分为记忆类和泛化类,然后分别评估两种范式的表现。表面结论符合预期:GR在需要泛化的实例上更强,传统ID模型在记忆类实例上更强。但关键发现藏在下一层——把分析从item级别下沉到token级别后,GR所展现的「泛化」很大程度上是token级别的记忆重组,模型并没有学会真正的组合性推理,只是把item拆成token后记忆粒度变细了。这对正在用GR替换传统推荐的团队是个需要认真对待的结论:你观察到的泛化提升,未必意味着模型理解了用户偏好的组合结构。论文同时证明两种范式互补,提出了一个基于记忆强度的指标来逐实例自适应融合,整体效果优于单一范式——务实的工程结论比「谁更强」更有价值。

原文:How Well Does Generative Recommendation Generalize?

02 安全对齐 安全审计为什么可能是AI Agent的最佳切入点?

安全合规评估是个有意思的AI应用场景:评估标准极其明确(NIST CSF框架),合格的人类专家(CISSP持证者)又极其稀缺。微软用6个Agent分别负责组织画像、资产映射、威胁分析、控制评估、风险评分和建议生成,在一家15人的医疗合规公司上测试,与3位CISSP专家的独立评估对比,严重等级分类一致率85%,风险覆盖率92%。值得注意的是,领域微调模型能识别出通用模型完全遗漏的风险——比如医疗场景的PHI暴露、制造业的OT/IIoT漏洞,这说明在安全领域通用能力不够,行业知识才是关键。但多Agent流水线在T4的4096-token上下文窗口下全部失败,说明上下文容量而非模型能力才是当前的实际瓶颈。

原文:An Agentic Multi-Agent Architecture for Cybersecurity Risk Management

03 Agent 网页Agent反复迷路,中间检查点才是缺失环节

LLM Agent在长序列网页任务中频繁「跑偏」,一个被低估的原因是:它们只盯着最终目标,缺少中间检查点来校正方向。MiRA框架的做法是把长任务拆成子目标,每完成一个子目标就给一次奖励信号,而不是等到任务结束才知道成败。这个思路并不新,但验证结果值得注意——Gemma3-12B经过MiRA训练后,WebArena-Lite成功率从6.4%跳到43.0%,超过了GPT-4-Turbo的17.6%和GPT-4o的13.9%。更实际的发现是,即使在推理阶段单独加上子目标规划(不做RL训练),Gemini也能提升约10个百分点,说明问题确实出在规划层而非模型能力本身。

原文:A Subgoal-driven Framework for Improving Long-Horizon LLM Agents

04 推理加速 离散扩散模型终于也能蒸馏了?

离散扩散模型有个尴尬处境:生成质量在追上来,但采样速度一直被拖后腿——蒸馏这条最直接的加速路走不通,之前的方案全都会让生成质量崩掉。D-MMD的关键突破是把矩匹配(moment matching)的思路重新适配到离散token空间,绕过逐token的匹配,直接在分布层面对齐教师和学生模型。效果出乎意料:文本和图像两个域都保住了质量和多样性,蒸馏后的学生模型甚至反超了教师。这意味着离散扩散方案——包括文本生成中越来越多采用的这类架构——终于有了实用的推理加速路径。

原文:Beyond Single Tokens: Distilling Discrete Diffusion Models via Discrete MMD

也值得关注

今日观察

推荐系统那篇把生成式推荐的每个预测拆成「记忆」和「泛化」两类,发现token级别的记忆重组在冒充泛化。同一天,自动驾驶在线建图的诊断框架做了几乎一样的事——把模型表现按输入特征的训练集覆盖度分类后,发现看似泛化好的模型其实在记忆高频出现的道路结构。两个领域,两套独立的诊断工具,切开后看到的东西一样:测试集指标好看≠模型在泛化。

标准的train/test split无法区分这两者,因为测试集里总有大量「换了个皮但本质可记忆」的样本。两篇论文给出的共同思路是:按预测实例所需的能力分类,分别评估记忆类和泛化类的表现,这时候才能看清模型的真实能力构成。

可以立刻做的事: 对你在意的模型,按测试样本与训练集的最近邻距离分成「近」和「远」两组,分别算指标。不需要复杂框架,一个embedding距离阈值就能开始——如果「近」组指标远好于「远」组,你的模型大概率在靠记忆吃饭。