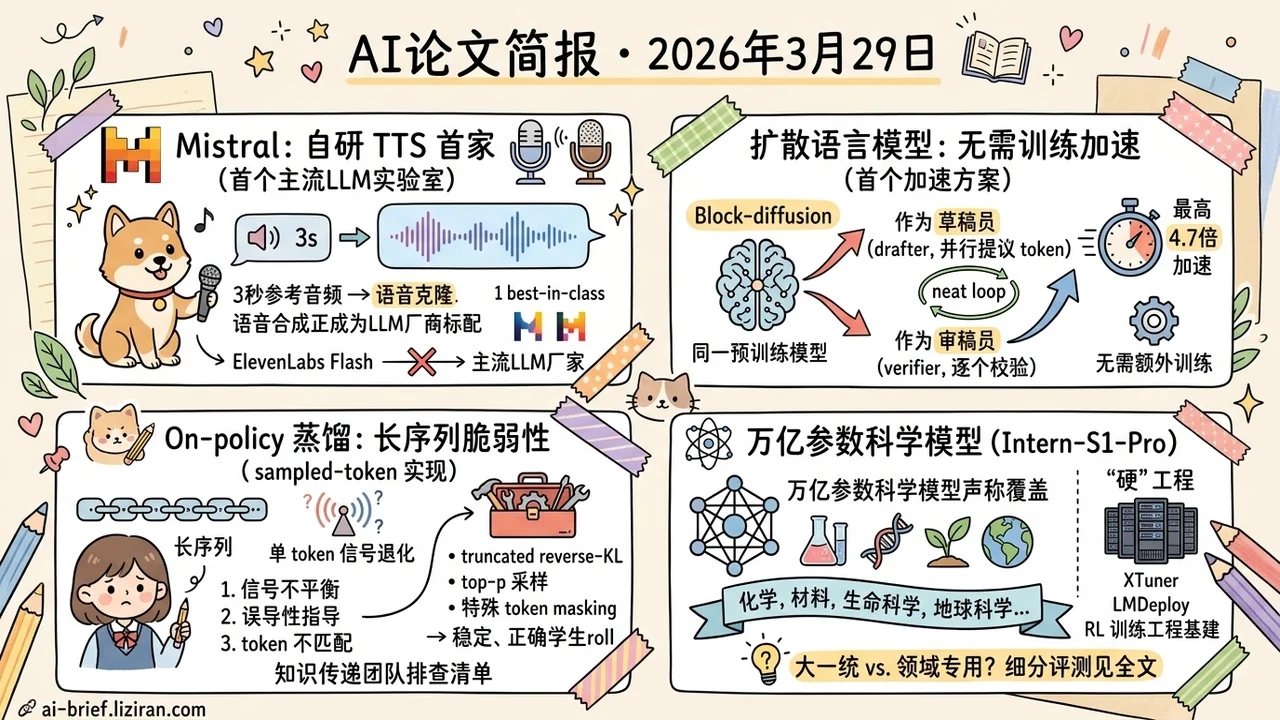

今日概览

- Mistral成为首家自研TTS的主流LLM实验室,3秒参考音频即可语音克隆。语音合成正从专用供应商领域变成LLM厂商标配能力

- 扩散语言模型有了首个无训练加速方案:S2D2利用block size=1的退化特性让同一模型充当drafter和verifier,最高实现4.7倍加速

- On-policy蒸馏的sampled-token实现在长序列下本质脆弱。三个failure mode和对应修复方案,是做知识传递团队的现成排查清单

- 万亿参数科学模型Intern-S1-Pro声称覆盖100+任务,工程基建扎实,但领域覆盖深度需要细分评测才能判断

重点关注

01 多模态 LLM厂商开始自研语音合成,Mistral打了第一枪

Mistral发布了Voxtral TTS,成为第一家自研TTS的主流LLM实验室。技术上没有单一突破点:自回归生成语义token,flow-matching合成声学细节,再加上从头训练的VQ-FSQ混合编解码器(向量量化与有限标量量化的组合)——都是已有范式的成熟组件,但打包成了一个只需3秒参考音频就能做语音克隆的完整系统。在原生说话者的人工评测中,自然度和表达力以68.4%的胜率击败了ElevenLabs Flash v2.5。这个数字需要加上下文:Flash是ElevenLabs速度优先的轻量版本,不是旗舰模型,所以这更接近「达到商用水平」而非「超越行业最佳」。模型权重以CC BY-NC许可开放,研究和非商用可直接使用,商业部署仍需走Mistral的API。对从业者来说,更值得关注的不是这个模型本身,而是它释放的信号:语音合成正在从ElevenLabs这类专用供应商的领地,变成LLM厂商的标配能力——就像图像生成两年前走过的路。

原文:Voxtral TTS

02 推理加速 扩散语言模型终于有了自己的加速工具箱

Block-diffusion语言模型(把自回归和并行去噪结合的新范式)有个尴尬处境:理论上能并行生成,实际加速工具链几乎空白。S2D2发现了一个精妙的性质:block-diffusion模型在block size缩到1时天然退化成自回归模型——这意味着同一个预训练模型既能当「草稿员」并行提议token,又能当「审稿员」逐个校验质量,不需要额外训练任何辅助模型。关键设计是一套轻量路由策略,自动判断哪些位置值得验证、哪些可以信任扩散的并行输出,避免了固定阈值「要么太激进要么太保守」的老问题。在三个主流block-diffusion模型上都稳定提升了速度-精度权衡,SDAR上实现4.7倍加速,LLaDA2.1-Mini上比静态基线快4.4倍且精度还略有提升。

原文:S2D2: Fast Decoding for Diffusion LLMs via Training-Free Self-Speculation

03 训练优化 学生模型跑偏后,教师的单token反馈还能信吗?

OPD(on-policy distillation)让学生模型自己生成rollout再由教师打分,比固定教师轨迹更灵活,但常见的sampled-token实现有个根本脆弱性:它把分布匹配压缩成单个token的信号,学生rollout越长、偏离教师分布越远,这个信号就越不可靠。这篇工作系统梳理了三个失败模式——单token信号不平衡、教师在学生前缀上给出误导性指导、以及tokenizer与特殊token不匹配导致的梯度扭曲。修复方案直接且实用:用truncated reverse-KL配合top-p rollout采样和特殊token masking,在数学推理和agent多任务训练上都比标准sampled-token OPD更稳定。对正在做大模型知识传递的团队来说,这三个failure mode本身就是一份现成的pipeline排查清单。

原文:Revisiting On-Policy Distillation: Empirical Failure Modes and Simple Fixes

04 AI for Science 科学大一统模型号称覆盖「100+任务」,但具体哪100个?

「覆盖化学、材料、生命科学、地球科学等100多个专业任务」——Intern-S1-Pro的摘要把这句话当卖点,却几乎没有展开。每个方向覆盖了哪些任务?和现有领域专用模型比表现如何?这些关键问题一概模糊。摘要真正花篇幅讲的是工程基建:XTuner和LMDeploy支持万亿参数级RL训练并保证训练-推理精度一致,这确实是扎实的工程贡献。但对做科研落地的团队来说,核心问题不是模型能不能训这么大,而是一个「Specializable Generalist」在你的具体场景里是否比调好的领域专用模型更实用——这个答案需要看全文的细分评测才能判断。

原文:Intern-S1-Pro: Scientific Multimodal Foundation Model at Trillion Scale

也值得关注

今日观察

Voxtral TTS在语音领域、S2D2在文本领域,两者解决的问题完全不同,但架构选择高度一致:自回归负责序列级的语义结构(Voxtral用它生成semantic token序列,S2D2依赖它处理block间依赖),扩散或流匹配负责局部高维细节(Voxtral的声学token重建,S2D2的block内并行去噪)。

这不是巧合,而是问题结构决定的。当生成目标同时具备两个特征——强顺序依赖(语义必须连贯)和高维局部结构(声学细节、token级并行性)——纯自回归太慢,纯扩散缺乏长程控制。「序列层自回归+细节层扩散」正在成为这类问题的默认分层策略,而且已经跨越了语音和文本两个模态。

如果你正在设计新的生成系统,先问一个问题:你的输出是否同时有顺序依赖和局部高维结构?如果是,这个两层架构值得作为baseline直接搭起来再迭代,而不是从纯自回归或纯扩散出发慢慢加补丁。