今日概览

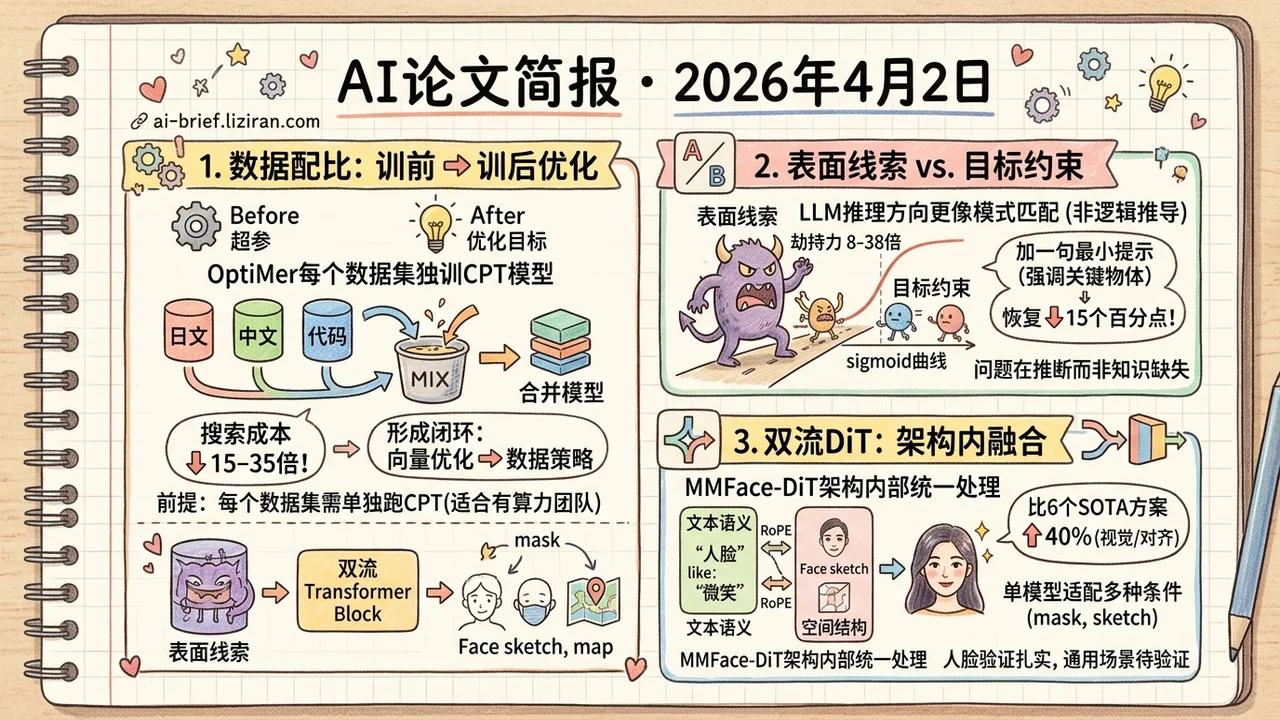

- 数据配比从训前超参变为训后优化,OptiMer为每个数据集单独训模型后在参数空间搜索最优合并权重,搜索成本降低15-35倍。

- 表面线索对LLM推理方向的劫持力是目标约束的8-38倍:跨六个模型呈现稳定sigmoid曲线,但一句最小提示就能恢复15个百分点。

- 双流DiT从架构内部统一文本语义和空间结构——MMFace-DiT在人脸生成上比六个SOTA提升40%,单模型适配多种空间条件。

重点关注

01 训练优化 数据配比,训完再定也不迟

OptiMer的核心操作是一个变量替换:把持续预训练(CPT)中的数据混合比例从训练超参数变成后处理优化目标。具体做法是每个数据集单独训一个CPT模型,提取各自的分布向量——即该数据集在参数空间中造成的偏移——然后用贝叶斯优化在这些向量之间搜索最优合并权重。这样做的好处是把搜索空间从「重新训练」降到了「重新加权」,在Gemma 3 27B上跨语言(日文、中文)和跨领域(数学、代码)的实验中,搜索成本比传统数据混合低15到35倍,效果也更好。两个附带发现值得注意:优化出的合并权重可以反向解读为数据混合比例,用它重新训练能提升传统CPT;同一组向量还能针对不同目标重新优化,不需要再训练就能生成定制模型。思路清晰,实验覆盖面也够,但前提是你得有资源为每个数据集单独跑一轮CPT——对算力充足的团队这是降低试错成本的好方案,对小团队来说初始投入未必划算。

原文:OptiMer: Optimal Distribution Vector Merging Is Better than Data Mixing for Continual Pre-Training

02 可解释性 Prompt里一个显眼词的影响力,是任务目标的38倍

直觉上,LLM应该能综合权衡prompt中的所有信息做出判断。但这项跨六个模型的系统研究揭示了一个令人意外的模式:当表面线索(比如「距离近」)和隐含约束(比如「目标不可达」)冲突时,表面线索的影响力是目标约束的8到38倍——不是偶尔出错,是呈现出稳定的sigmoid曲线。token级别的归因分析进一步显示,模型的行为更接近关键词关联而非组合推理——它在做模式匹配,不是在做逻辑推导。研究者构建了500个测试用例的HOB基准,在14个模型上验证了这一现象的普遍性:严格评估下没有模型超过75%准确率。但一个出人意料的发现是,只需加一句最小提示(比如强调关键物体)就能恢复平均15个百分点,说明模型其实「知道」约束存在,只是被显眼线索压过了。

原文:The Model Says Walk: How Surface Heuristics Override Implicit Constraints in LLM Reasoning

03 图像生成 双流Transformer能让文本和空间控制真正「对齐」吗?

把文本语义和空间结构(mask、sketch)放进同一个Transformer块里并行处理,再通过共享的RoPE注意力做深度融合——MMFace-DiT的核心设计选择是在架构内部统一两路信息,而不是在预训练管线外面拼接控制模块。这个思路的好处很直接:避免了模态主导问题,让文本描述和结构先验能在同一个潜空间里协商,而不是事后调和。论文报告视觉保真度和prompt对齐比六个SOTA方案提升40%,同时一个模型就能动态适配不同的空间条件输入,不需要为每种条件单独训练。不过值得注意的是,人脸是高度结构化、约束明确的领域,这种双流融合在更自由的生成场景下能否保持优势,还需要看后续验证。

原文:MMFace-DiT: A Dual-Stream Diffusion Transformer for High-Fidelity Multimodal Face Generation