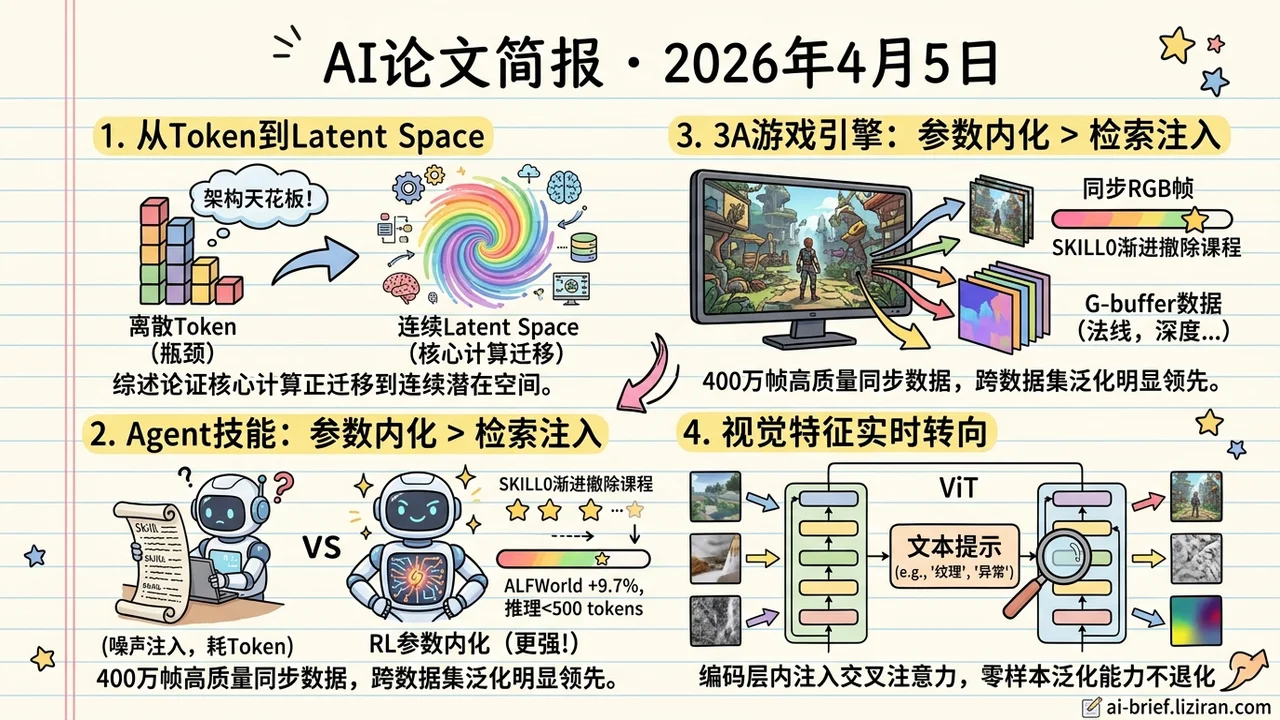

今日概览

- 离散token是LLM的架构天花板而非优化目标,综述从四条技术线索论证核心计算正从token序列迁移到连续latent空间。

- Agent技能用RL内化进参数比检索注入更强:SKILL0的渐进撤除课程在ALFWorld上提升9.7%,推理时每步上下文不到500 token。

- 3A游戏引擎是生成式渲染被忽视的数据金矿——400万帧同步RGB+G-buffer数据,微调后的模型在跨数据集泛化上明显领先。

- 视觉特征可以用文本提示实时转向。在ViT编码层内注入交叉注意力,异常检测等任务零样本泛化,通用能力不退化。

重点关注

01 模型架构 LLM的核心计算正在离开token空间

离散token是当前LLM的基本操作单元,但越来越多的证据表明,它同时也是能力天花板。这篇综述系统梳理了一个正在发生的迁移:模型内部的关键计算——推理、规划、记忆、多模态感知——正在从人类可读的token序列转向连续的latent space(潜在空间)。驱动这个迁移的不是某个单点突破,而是离散化本身的结构性限制:语言冗余导致信息密度低,token化造成压缩损失,自回归的逐token生成带来序列效率瓶颈。这些不是可以通过更好的tokenizer或更大的模型解决的问题,而是架构层面的天花板。综述从架构、表示、计算、优化四条技术线索追踪了这个趋势的演进,并展示了latent space在推理、规划、建模等七个能力维度上的进展。值得注意的是,这不只是学术界的探索——当Coconut(连续思维链)、latent reasoning等方向开始在大规模模型上验证,token空间作为默认计算基底的假设正在被动摇。对从业者而言,关键判断点在于:你当前的推理和训练框架是否仍然默认在token级别操作,这可能决定了系统能力的上限。

原文:The Latent Space: Foundation, Evolution, Mechanism, Ability, and Outlook

02 Agent 技能靠检索注入,不如直接练进脑子里?

当前Agent扩展技能的主流做法本质上是RAG——检索技能描述,注入prompt,模型照着做。但检索有噪声,注入吃token,而且模型从未真正学会这些技能,只是在照本宣科。SKILL0问了一个更根本的问题:能不能用RL把技能直接内化进参数?它设计了一个渐进撤除课程——训练初期给完整技能上下文,随后动态评估每个技能文件对当前策略的帮助,逐步撤掉已经学会的部分,直到模型完全零样本运行。ALFWorld提升9.7%,Search-QA提升6.6%,推理时每步上下文不到500个token——这是fine-tuning vs RAG在agent领域的一次正面交锋,结果站在了内化这边。

原文:SKILL0: In-Context Agentic Reinforcement Learning for Skill Internalization

03 视频生成 训练生成式渲染,最好的数据集藏在游戏里

做逆渲染和正向渲染的人都知道,合成数据集和真实场景之间永远隔着一条domain gap。但这个团队的解法让人没想到:直接从3A游戏里抽数据。想想也合理——游戏引擎已经花了几十年解决复杂光照、动态天气、运动模糊这些问题,渲染质量早就超过了学术界的合成数据集。他们用一种双屏拼接采集方法,从游戏中提取了400万帧连续的720p画面,每帧同步包含RGB和5个G-buffer通道(法线、深度、材质等)。用这批数据微调的逆渲染模型在跨数据集泛化上明显优于现有方案,还能通过G-buffer引导做可控视频生成。更有意思的是他们还提出了一个基于VLM的评估协议,解决了真实场景下没有ground truth的评测难题。

04 多模态 视觉特征能不能按需「转向」?

做图像检索或异常检测时,你经常需要模型关注特定属性——比如关注纹理而不是形状,但现有的视觉编码器只给你「最显著」的特征,没有调控余地。用文本引导是个自然的想法,CLIP的做法是编码后再融合,代价是空间精度打折。这篇工作把融合提前了:在ViT编码器的中间层注入轻量级交叉注意力,让文本提示直接影响视觉特征的提取过程。结果是视觉表征变得「可转向」,在异常检测和个性化物体区分上做到了和专用方法持平或更好,同时通用视觉任务的基础能力没有退化。

也值得关注

今日观察

今天的latent space综述、LatentUM和SKILL0表面上分属不同子领域,但它们共同暴露了同一个结构性问题:显式中间表示在系统规模增大时,从信息载体退化为信息瓶颈。

综述论证的核心不是「latent space很有潜力」,而是离散token作为计算基底存在结构性上限——语言冗余、压缩损失、序列效率瓶颈,这些问题的根源在离散化本身,不可能通过更好的tokenizer消除。LatentUM在跨模态推理中绕过了「先把图像描述成文本再推理」的默认路径,直接在latent空间完成视觉与语言的交叉推理。SKILL0则把agent技能从「检索文档→注入prompt→模型照做」的RAG模式,转向「训练时内化进参数→推理时零样本调用」。

这三个方向同时出现不是巧合,因为它们面对的是同一类瓶颈:当模型需要处理的信息复杂度超过显式表示的承载能力时,中间转译层就成了损耗源。token承载不了推理所需的全部信息密度,文本描述承载不了视觉内容的空间细节,技能文档承载不了agent在复杂环境中的行为模式。而当模型能力足以直接在连续空间操作时,这些显式中间层就从「必要桥梁」退化为「不必要的信息漏斗」。

这并不意味着显式表示会消失——人类仍然需要可读的输出。但「先转成人类可读形式再计算」的默认假设正在被修正为「内部用连续空间计算,只在输入输出端口做离散化」。这个修正的方向是一致的:把显式表示从计算路径中移除,保留在接口层。

行动建议:审视你当前系统中的显式中间表示——token-level推理链、文本化的检索结果、prompt注入的工具说明。区分哪些是面向人类的可解释性接口(必须保留),哪些只是「因为我们一直这么做」的架构惯性。后者是最直接的优化空间,从推理成本到信息保真度都有改善余地。