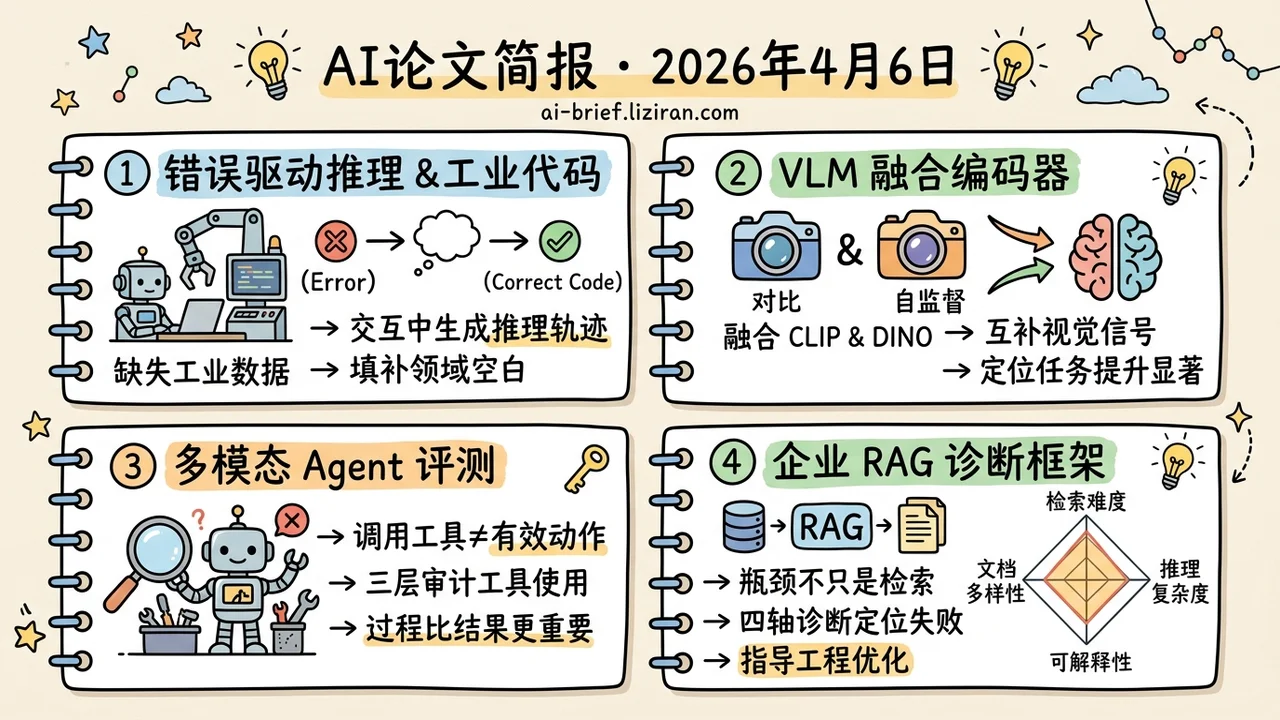

今日概览

- 硬件代码调试有了开源32B选项,InCoder从工程师实际犯错过程中蒸馏推理链,在LiveCodeBench和CAD-Coder上进入开源第一梯队,不过KernelBench 38%说明GPU优化类任务离实用仍远

- CLIP的空间语义短板是训练目标决定的。CoME-VL把CLIP和DINO做表征级融合,grounding任务提升5.4%,给双编码器方案提供了系统性ablation参考

- Agent「答对了」可能只是蒙的——Agentic-MME从工具调用的过程级评测切入,最强模型在复杂任务上仅23%,overthinking指标揭示步骤效率的真实差距

- RAG翻车原因是多维交织的,单一准确率定位不了瓶颈:这篇AAAI工作把诊断拆成推理复杂度、检索难度、文档结构、可解释性四轴,帮团队从「整体调参」转向定向修复

重点关注

01 代码智能 硬件工程师的排错直觉,能从错误日志里蒸馏出来吗?

芯片设计和GPU优化的代码调试有个特殊之处:错误反馈不是编译报错那么简单,而是时序不满足、性能没达标这类需要领域经验才能定位的问题。InCoder-32B-Thinking的核心思路是Error-driven Chain-of-Thought——从多轮对话中的环境错误反馈里合成推理链,显式建模工程师「犯错→定位→修正」的过程。配合一个工业代码世界模型(ICWM),在Verilog仿真、GPU profiling等领域专属执行轨迹上训练,让模型能在实际编译前预测执行结果做自验证。32B参数量选择了开源路线,在LiveCodeBench v5上81.3%、CAD-Coder上84.0%、KernelBench上38.0%,通用和工业benchmark都拿到了开源模型的第一梯队成绩。不过KernelBench 38.0%也说明GPU kernel优化这类任务离实用还有距离——这些benchmark本身难度高,但数字提醒我们硬件代码智能还在早期阶段,做相关方向的团队可以开始跟进,但别指望开箱即用。

原文:InCoder-32B-Thinking: Industrial Code World Model for Thinking

02 多模态 CLIP不够用,但问题不在CLIP本身

CLIP作为VLM的视觉编码器几乎是行业默认配置,但对比学习的训练目标决定了它天然偏向全局语义对齐,密集空间信息(物体位置、局部细节)在训练过程中被结构性地丢弃。CoME-VL的思路不是替换CLIP,而是补上这块缺失——把CLIP和自监督的DINO编码器做表征级融合。具体方法是用熵引导的多层聚合加正交约束来减少冗余,再用RoPE增强的交叉注意力对齐两种编码器的异构token网格。效果上,视觉理解任务平均提升4.9%,grounding任务提升5.4%,RefCOCO检测达到SOTA。这项工作的价值更多在工程参考层面:双编码器融合到底有多大收益、怎么融合更高效,现在有了系统性的ablation数据。

原文:CoME-VL: Scaling Complementary Multi-Encoder Vision-Language Learning

03 评测 答对了不等于用对了:多模态Agent需要过程级评测

多模态Agent评测有个盲区——模型在最终答案上得分不错,但可能根本没调用工具,而是靠参数记忆蒙对的。Agentic-MME针对这个问题设计了过程级验证:418个真实任务,每个任务平均标注超过10人时的逐步检查点,从「是否调用了工具」「是否正确使用了工具」「是否高效使用了工具」三个层次评估。效率维度尤其值得注意——它引入了相对于人类轨迹的overthinking指标,衡量模型是不是在用远超必要的步骤完成任务。结果显示最强模型Gemini3-pro整体准确率56.3%,但Level-3难度任务骤降至23.0%,过程级评测揭示的差距比最终准确率大得多。

原文:Agentic-MME: What Agentic Capability Really Brings to Multimodal Intelligence?

04 检索 RAG评测只看准确率,难怪上线就翻车

把RAG评测从「最终准确率」拆成四个独立维度——推理复杂度、检索难度、文档结构、可解释性——就能看到完全不同的信息。这篇AAAI工作的出发点很实际:企业环境里RAG失败的原因是多维交织的,同样70%的准确率,可能卡在跨文档推理上,也可能卡在非结构化文档解析上,优化方向完全不同。四轴诊断框架的价值不在于发现新问题,而是把「感觉不行」变成「哪里不行」的结构化方法,填补了学术benchmark和实际部署之间的诊断空白。对做RAG产品的团队来说,这套分类法比追更高的benchmark分数更实用。