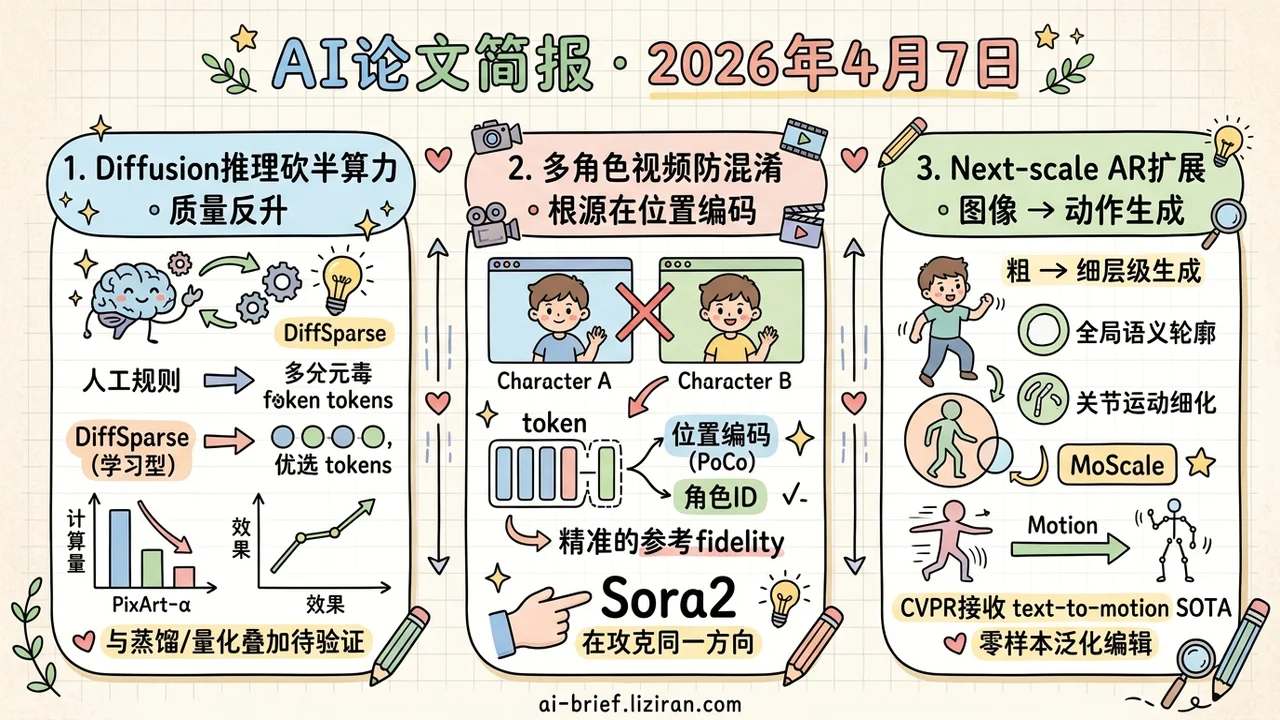

今日概览

- Diffusion推理砍半算力质量反升,DiffSparse用可学习predictor逐层逐步决定token稀疏率,PixArt-α上省54%计算量,与蒸馏/量化的叠加效果待验证

- 多角色视频的身份混淆根源在位置编码:PoCo从position embedding层面重新设计控制机制,跨镜头一致性和参考保真度均有改善。Sora2也在攻同一方向

- Next-scale AR从图像扩展到动作生成——粗到细的层级生成优于展平一维序列,CVPR接收text-to-motion达到SOTA,且能零样本泛化到编辑任务

重点关注

01 推理加速 从手工规则到可学习稀疏——Diffusion推理加速换了条路

Token缓存是当前Diffusion Transformer推理加速的主流手段,但现有方法的稀疏分配基本靠人工设计——哪些层跳过多少token,是预设规则,无法感知不同去噪步骤和层对token的实际依赖差异。DiffSparse换了个思路:训练一个轻量级predictor,在每个去噪步骤逐层决定哪些token可以安全跳过,把稀疏性从启发式规则变成端到端的learned decision。具体做法是用可微分框架联合优化各层的稀疏率,再通过动态规划求解器分配全局预算;同时提出两阶段训练策略,避免了现有方法在部分步骤必须保留完整前向计算的开销。在PixArt-α上20步采样减少54%计算量,生成质量指标反而优于原始模型;在FLUX和Wan2.1等架构上也有一致的效率提升。值得注意的是,这类learned sparsity方法能否与步骤蒸馏(step distillation)、量化等已有加速手段叠加使用,论文没有明确讨论,需要看后续工作验证。

原文:DiffSparse: Accelerating Diffusion Transformers with Learned Token Sparsity

02 视频生成 多角色视频总搞混人物身份?问题可能不在注意力机制

多镜头视频生成有个棘手问题:当画面中出现多个外貌相似的角色时,模型经常张冠李戴——把A的动作接到B身上。常见思路是优化注意力机制来改善角色区分,但PoCo团队发现根源在更底层:多个参考图的token共享同一套位置编码,语义相似的token在检索时互相干扰,模型从源头上就分不清谁是谁。他们的方案是让位置编码承担额外的上下文控制职能,通过token的辅助信息实现精确匹配,同时保留隐式的语义一致性建模。实验显示跨镜头一致性和参考保真度均有改善,Sora2也在攻克同一方向,说明这个瓶颈确实是视频生成走向实用的关键障碍。

03 模型架构 动作生成不该被展平成一维序列

Next-token预测用在动作生成上一直效果平庸,根本原因是人体动作有天然的时间层级——先有整体意图,再有具体关节运动——强行展平成一维token序列会丢失这个结构。MoScale的做法是借鉴图像领域已经验证过的next-scale范式:先在最粗粒度生成动作的全局语义轮廓,再逐层细化到具体帧。为了弥补文本-动作配对数据不足的问题,引入了跨尺度层级修正和尺度内双向重预测两个辅助机制。CVPR接收,text-to-motion达到SOTA,且能零样本泛化到动作编辑等下游任务——这说明学到的层级表示有一定通用性。比起动作生成本身,更值得留意的是next-scale AR正在从图像扩展到更多序列数据类型,做时序相关生成任务的团队可以关注这个范式迁移的趋势。

原文:Next-Scale Autoregressive Models for Text-to-Motion Generation