今日概览

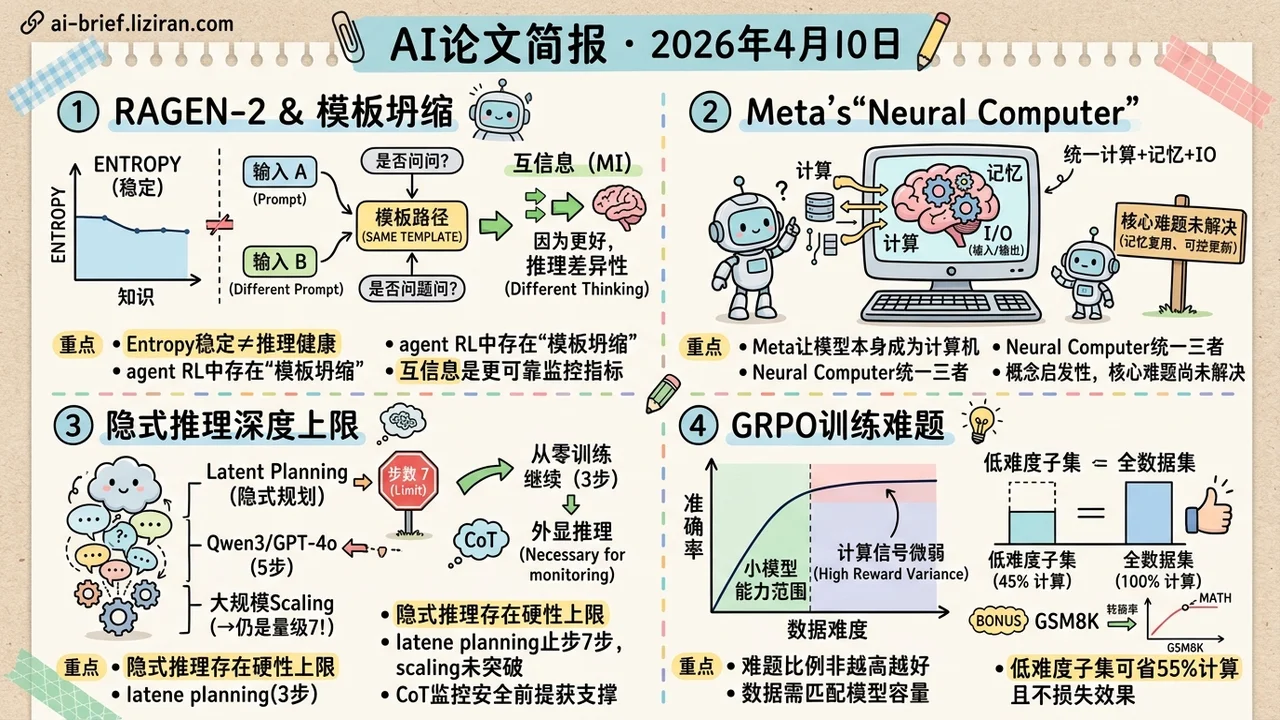

- Entropy稳定不代表推理健康。 RAGEN-2发现agentic RL中的「模板坍缩」——模型用固定模板应对所有输入,entropy完全看不出来,互信息才是更可靠的训练监控指标

- Meta试图让模型本身成为计算机——Neural Computer统一计算、记忆和I/O,概念有启发性,但核心难题尚未解决,当方向信号看

- 隐式推理存在硬性深度上限: 最大规模模型的latent planning也止步于7步,scaling未能突破,CoT监控的安全前提因此获得实验支撑

- GRPO训练难题比例并非越高越好, 超出小模型能力边界的样本几乎贡献不了学习信号,低难度子集即可匹配全数据集效果且省55%计算

重点关注

01 Agent Entropy正常不代表推理正常——Agentic RL中的模板坍缩

用RL训练多轮Agent有一个被广泛信任的健康指标:entropy。训练过程中entropy保持稳定,通常被认为模型在正常探索。RAGEN-2揭示了一个更隐蔽的问题:模型可以在entropy完全正常的情况下,学会用一套固定模板应对所有输入——输出看起来多样,但推理路径跟具体输入无关。作者把这种现象叫做template collapse(模板坍缩),现有的训练监控指标完全检测不到它。诊断方案是引入互信息(MI)来衡量推理是否真正区分了不同输入,实验显示MI与最终任务性能的相关性远高于entropy。背后的机制也讲得清楚:reward方差低时,任务梯度信号太弱,正则化项主导优化,抹平了输入间的推理差异。对应的修复方法根据reward方差筛选高信号prompt,在规划、数学推理、网页导航、代码执行四类任务上都有一致提升。做agentic RL的团队值得重新审视自己的训练监控——entropy可能一直在给你假的安全感。

原文:RAGEN-2: Reasoning Collapse in Agentic RL

02 模型架构 让模型本身变成一台计算机?Meta画了张很大的饼

Agent调工具、world model学环境动态——这两条路已经够热闹了,Meta又开了第三条:干脆让模型自己变成计算机,把计算、记忆和I/O统一到模型的运行状态里。听起来很大胆,但目前的实现是什么?用视频模型逐帧生成屏幕画面——输入指令和像素,输出下一帧。实验表明它能学会基本的I/O对齐和短时序控制,但routine复用、可控更新、符号稳定性都还是open problem。说白了这是一篇vision paper,描述的是长期愿景,离它定义的「完全神经计算机」还有大量未解决的核心挑战。

03 推理 模型的「暗中推理」能力,天花板在哪?

GPT-5.4在graph path-finding任务上的latent planning(隐式规划)深度最多到7步——这是目前测到的上限。实验用图路径搜索精确控制所需推理步数:从零训练的小Transformer发现3步策略,fine-tuned GPT-4o和Qwen3-32B到5步,大规模scaling没有带来量级突破。值得注意的是,训练阶段最多发现5步策略,但推理时能泛化到8步,说明「发现策略」和「执行策略」是可分离的能力。这个天花板直接关系到CoT监控的安全前提——如果复杂推理无法在单次forward pass中隐式完成,模型就必须外显推理过程,监控才有效。但这个ceiling能否从graph任务推广到更广泛的真实场景,需要看后续工作。

原文:The Depth Ceiling: On the Limits of Large Language Models in Discovering Latent Planning

04 训练优化 难题练多了反而没用:GRPO调小模型的数据配比陷阱

3B以下模型用GRPO(Group Relative Policy Optimization)做数学推理对齐时,存在一个清晰的难度边界:随着题目难度提升,准确率很快进入平台期,超出模型当前推理能力的样本几乎贡献不了学习信号。这篇ICLR工作的解释是,GRPO本质上是在重新分配输出偏好,不能凭空创造模型没有的推理能力。更实用的发现是,只用低难度题训练就能匹配全数据集的效果,而且只需要约45%的训练步数。还有一个值得注意的迁移现象:在GSM8K上训的GRPO,在MATH数值子集上反而比直接在MATH上训的高出3-5个百分点,简单数据集学到的推理模式可能泛化得更好。

原文:Limits of Difficulty Scaling: Hard Samples Yield Diminishing Returns in GRPO-Tuned SLMs

也值得关注

今日观察

推理优化正在积累一类特殊的知识:哪些改进策略在什么条件下停止生效。今天三个failure mode覆盖了三个层面的失效点——RAGEN-2发现entropy在reward方差低时与推理多样性脱钩,Depth Ceiling发现模型规模在latent planning深度上碰到scaling无法突破的硬顶,GRPO发现训练难度超出模型容量后学习信号反转为负。共同结构不是「推理很难」,而是每个优化维度都存在一个proxy gap:标准指标开始欺骗你的临界点。识别这些临界点比继续沿着指标爬坡更有工程价值。具体建议:在RL训练pipeline中,为每个关键代理指标(entropy、loss、难度分布)配一个直接行为度量(如互信息、分层成功率)做交叉验证,当两者趋势分离时,你已经到了边界。