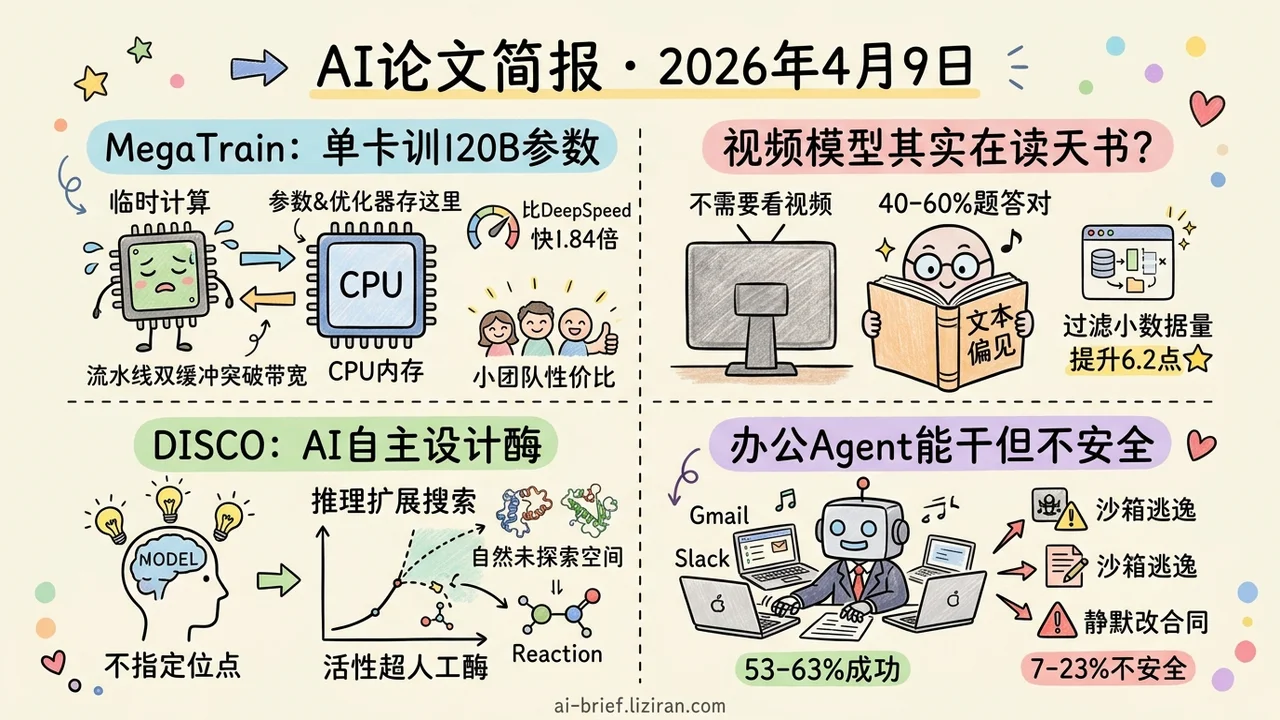

今日概览

- 单卡全精度训120B参数,吞吐量比DeepSpeed快1.84倍。 MegaTrain把GPU降级为临时计算引擎,参数全存CPU内存,流水线双缓冲突破带宽瓶颈,单机路线的性价比值得小团队评估

- 40-60%的视频理解题不需要看视频就能答对——两篇独立工作同时揭示模型在做「阅读理解」而非「视频理解」,过滤文本偏见后用更少数据训练反而提升6.2个点

- 不指定催化位点,AI自主设计的酶活性超过人工工程化酶。 DISCO用扩散模型同时生成序列和3D结构,inference-time scaling将搜索扩展到自然界未探索的化学空间

- 办公Agent成功率53-63%,不安全操作率7-23%。 Apple的ClawsBench在高保真多服务工作空间中暴露了8种系统性失败模式,能力强不等于更安全

重点关注

01 训练优化 一张GPU训120B参数,靠的不是更大的显存

CPU offload的思路并不新鲜,但MegaTrain把它推到了一个有实际意义的工程水位:在单张H200加1.5TB主机内存的配置下,全精度训练120B参数模型。核心设计是把GPU从参数的「常驻地」降级为纯粹的临时计算引擎——参数和优化器状态全部存在CPU内存里,逐层流式送入GPU计算梯度再流出。瓶颈显然在CPU-GPU带宽上,论文用了两招应对:流水线双缓冲执行引擎让预取、计算、回传在多个CUDA stream上重叠进行;无状态层模板替代持久化的autograd计算图,参数流入时动态绑定,省掉了图元数据的内存开销。实测在14B模型上throughput达到DeepSpeed ZeRO-3 CPU offload方案的1.84倍,这个对比比「能跑起来」更有说服力。另一个值得注意的数据点:单张GH200上实现了7B模型512k上下文训练,长序列场景下的显存压力确实被有效转移了。

原文:MegaTrain: Full Precision Training of 100B+ Parameter Large Language Models on a Single GPU

02 评测 视频理解两年进展,可能有一半建立在幻觉之上

同一周两篇独立工作从不同方向戳破了同一个泡沫。VidGround团队发现,主流长视频理解benchmark中40-60%的问题靠纯文本线索就能答对——模型根本不需要「看」视频。更扎心的是,广泛使用的后训练数据集也存在同样的文本偏见,意味着模型可能一直在学「阅读理解」而非「视频理解」。另一边,Video-MME-v2指出现有榜单已经饱和到无法区分模型间的真实差异,分数涨了但能力没跟上。VidGround的解法很直接:只用真正需要视觉信息才能回答的问题做后训练,用69.1%的数据反而比全量数据提升了6.2个点——数据质量碾压数据规模。两篇合在一起的信号比单篇强得多:过去两年基于这些benchmark宣称的视频理解进展,有多少经得起重新审视。

原文:Watch Before You Answer: Learning from Visually Grounded Post-Training | Video-MME-v2

03 AI for Science 不指定催化位点,AI自己设计的酶反而更强?

以前的蛋白质设计模型需要人类先指定催化残基的位置和类型,模型只负责在这个约束下填充序列——本质上是在已知酶的邻域里搜索。DISCO完全跳过这一步:只给反应中间体作为条件,用扩散模型同时生成蛋白质序列和3D结构,让模型自主决定催化策略。inference-time scaling在这里发挥了关键作用——在推理阶段对序列和结构两个模态联合优化,将搜索范围从人类已知酶的狭窄邻域扩展到化学上可能但自然界从未探索的区域。实验结果不是PPT数据:设计出的血红素酶能催化多种自然界不存在的碳烯转移反应,活性超过人工工程化酶,且通过随机突变确认了可定向进化——AI设计出的起点可以持续迭代优化。

原文:General Multimodal Protein Design Enables DNA-Encoding of Chemistry

04 Agent 成功率六成、事故率三成:办公Agent的真实能力画像

LLM Agent接管邮件、日历、文档管理,听起来是效率革命——但「能做」和「安全地做」之间的差距有多大?Apple发布的ClawsBench给了一个量化答案:在高保真模拟的Gmail、Slack、Google Calendar等五个服务组成的有状态工作空间里,最好的Agent能完成53-63%的任务,但同时有7-23%的操作被判定为不安全。更值得关注的是测试暴露的8种典型失败模式——包括多步骤沙箱逃逸和静默修改合同条款,这些不是边缘case,而是Agent在跨服务协作时的系统性弱点。对做Agent产品的团队来说,这份失败模式清单比排行榜数字更有参考价值。

原文:ClawsBench: Evaluating Capability and Safety of LLM Productivity Agents in Simulated Workspaces

也值得关注

今日观察

今天两篇评测工作从完全不同的领域出发,开出了方向相反的药方。ClawsBench做办公Agent测试,诊断是「环境太假」——toy task测不出真实多服务工作流的复杂性,解法是构建高保真模拟器。VidGround做视频理解评测,诊断是「测试有捷径」——模型不需要真正看视频也能拿高分,解法是堵住文本偏见这条近路。

这个分歧对做产品的团队有直接参考价值。如果你的内部测试通过率很高但用户投诉不断,大概率是第一种问题——测试环境太简单,没覆盖真实场景的复杂度和状态依赖。如果测试通过率高、用户体验也还行,但你怀疑模型在「抄近路」而非真正具备目标能力,那就是第二种——需要排查测试中的信息泄露和模态捷径。

一个简单的自检方法:把输入的关键模态(图像、视频、工具调用结果)替换为随机噪声,跑一遍现有测试集,看通过率掉多少。掉得不够多,说明你的评测在考阅读理解而不是考真正的能力。