今日概览

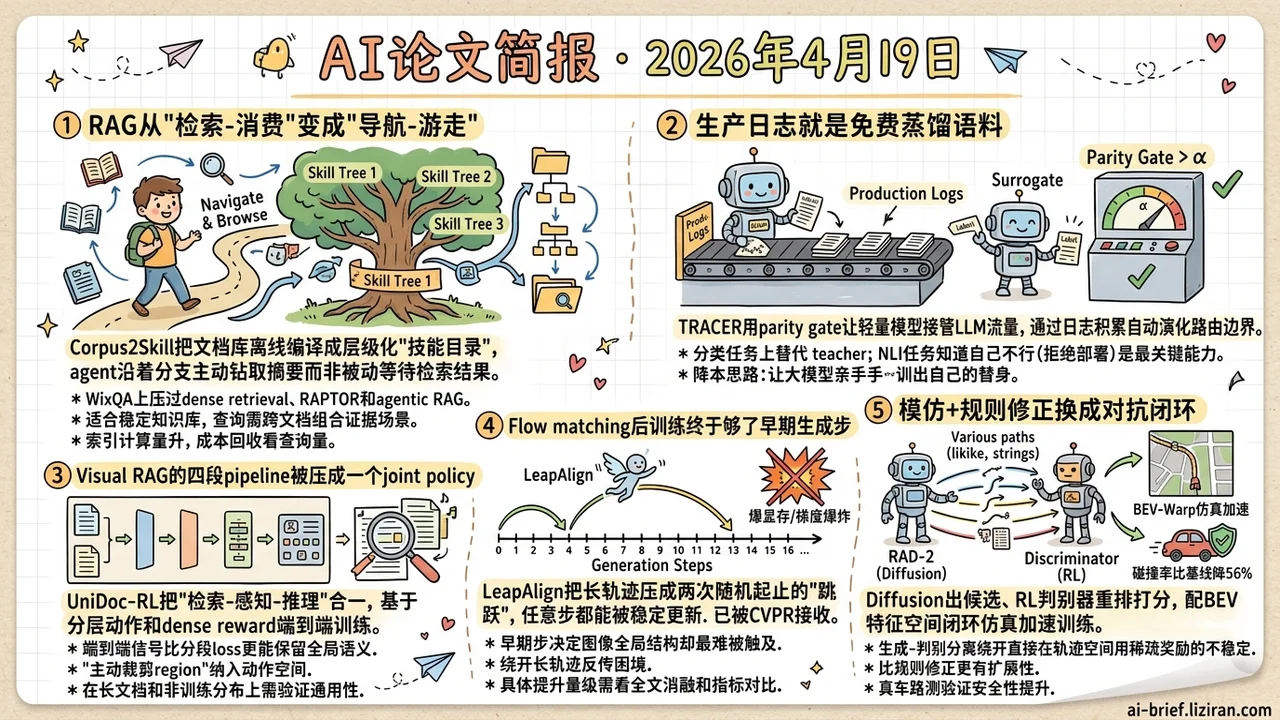

- RAG从「检索-消费」变成「导航-游走」:Corpus2Skill把整个语料离线编译成层级化skill目录,agent按摘要往下钻而不是被动等结果,WixQA上全面压过dense retrieval、RAPTOR和agentic RAG。

- 生产日志本身就是免费蒸馏语料,TRACER用parity gate让轻量surrogate接管77类意图的83-100%流量;NLI任务上会主动拒绝部署,「知道自己不行」反而是最关键的能力。

- Visual RAG的四段pipeline被压成一个joint policy——UniDoc-RL用分层动作和dense reward端到端训练,把「主动裁剪region」也纳入动作空间,三个benchmark最高提升17.7%。

- Flow matching后训练终于够到了早期生成步。LeapAlign把长轨迹压成两次随机起止的「跳跃」,绕开反传爆显存与直接梯度法动不了早期步的两难,已被CVPR接收。

- 模仿+规则修正换成对抗闭环:RAD-2让diffusion出候选、RL判别器重排打分,再配BEV特征空间的闭环仿真加速训练,碰撞率比强diffusion基线降56%。

重点关注

01 检索 把语料编译成目录,让agent自己找路

标准RAG把LLM当成搜索框后面的消费者:给它检索结果,它基于结果回答,但它看不到语料整体的组织方式,也不知道哪些没被检索到、该不该换个方向找。Corpus2Skill把这件事反过来:离线阶段把整个文档库编译成一棵层级化的「技能目录」——先聚类,逐层让LLM写摘要,最终落地成可导航的skill文件树。服务时agent拿到一张全局视图,沿着主题分支往下钻,看到更细的摘要再决定要不要回溯或跨分支组合证据,最后按ID取原文。代价是索引阶段的计算量显著上升(每层都要LLM写摘要),换来的是agent对语料结构的真正感知能力。在企业客服benchmark WixQA上,它在所有质量指标上都赢过dense retrieval、RAPTOR和agentic RAG三类基线。

原文:Don't Retrieve, Navigate: Distilling Enterprise Knowledge into Navigable Agent Skills for QA and RAG

02 推理加速 你的生产日志就是最好的训练集

每一次调用LLM做分类,其实都产出了一对现成的标注数据——输入是用户请求,标签是LLM的返回结果,两者都已经躺在日志里。TRACER把这个事实推到极致:拿生产trace训一个轻量surrogate,用一个parity gate(surrogate与LLM的一致率超过阈值α才启用)来决定哪些流量让小模型接管、哪些回退给大模型。77类意图分类上surrogate覆盖83-100%流量,150类benchmark上甚至完全替代了Sonnet 4.6 teacher;而在NLI任务上gate主动拒绝部署——因为embedding本身无法支撑可靠分离,这种「知道自己不行」反而是系统最有价值的部分。降本思路从「换个便宜模型」变成「让大模型亲手训出自己的替身」,而且替身的边界会随着日志积累自己演化。

原文:TRACER: Trace-Based Adaptive Cost-Efficient Routing for LLM Classification

03 Agent 把检索、重排、看图、推理拧成一个策略,会不会更靠谱?

处理复杂文档的visual RAG通常是一条流水线:先检索文档、再重排图片、再做视觉感知、最后推理。每一段都有自己的loss,互相不通气——流水线前段丢掉的信号,后段再怎么推理也捞不回来。UniDoc-RL干脆把这四件事合成一个agent的联合策略,用分层动作(文档级→图片级→区域裁剪)一步步refine视觉证据,再用dense多重奖励给每个动作打分,基于GRPO端到端训练。三个benchmark上比之前的RL方法最高提升17.7%。思路本身不新——agent化+RL化的浪潮已经蔓延到RAG——但把「主动裁剪region」也纳入动作空间算是有价值的一步。

原文:UniDoc-RL: Coarse-to-Fine Visual RAG with Hierarchical Actions and Dense Rewards

04 图像生成 Flow matching后训练够不到早期生成步,CVPR这篇换了个轨迹结构

Flow matching模型做post-training一直卡在一个结构性矛盾上:沿整条生成轨迹反传奖励梯度,要么爆显存要么梯度爆炸;绕开这个问题的直接梯度法又动不了早期生成步——而早期步恰恰决定图像的全局结构。LeapAlign把长轨迹压缩成两次「跳跃」,每次跨过多个ODE采样步、一步直接预测未来的latent。通过随机化两次跳跃的起止时刻,任意生成步都能被稳定地更新到;摘要里还提到对大幅值梯度做衰减而不是完全裁掉,这是过去直接梯度法的常见损失点。在Flux上微调,相比GRPO和其他直接梯度方法,图像质量和图文对齐都有提升,但摘要没给具体数字对比。能进CVPR说明这个工程路径的价值拿到了审稿人认可。

05 机器人 给diffusion planner配一个「裁判」,碰撞率砍掉一半

diffusion规划器能生成多样的候选轨迹,但纯模仿学习训出来缺负反馈——模型知道专家怎么开,不知道自己哪条路会翻车。RAD-2的做法是把生成和判别拆开:diffusion负责出候选,一个RL训练的discriminator对候选重排,按长期驾驶质量打分。好处是稀疏的标量奖励不用直接作用在高维轨迹空间,优化更稳。团队还配了个BEV-Warp仿真环境,直接在鸟瞰图特征空间做闭环评估,加速训练。结果是碰撞率比强diffusion基线降56%,真车路测也验证了平顺性和安全感提升。

原文:RAD-2: Scaling Reinforcement Learning in a Generator-Discriminator Framework

也值得关注

今日观察

Corpus2Skill和UniDoc-RL今天挨着出现,单读都只是某一段的优化:一个在重构索引,一个在重构训练目标。但它们反的是同一个默认假设——LLM作为RAG检索结果的被动消费者。Corpus2Skill让agent在服务时主动游走一棵离线编译好的skill目录;UniDoc-RL把检索、重排、视觉感知和推理压进一个端到端训练的joint policy。一个从索引侧动,一个从训练侧动,指向的信号是一致的:在复杂任务上,把retrieve和reason分段的传统pipeline已经从基础设施变成瓶颈。

值得关注的不是哪一种方案更优,也不是「新架构正在崛起」这类套话,而是「RAG pipeline=默认架构」这个共识本身正被多方同时动摇。对在做RAG系统的团队来说,一个可以马上做的动作是:在下一轮评估里给baseline留一条端到端joint策略的对照路径(哪怕先用带函数调用的单agent循环模拟),量化分段架构到底丢了多少全局信号。先有度量,再决定要不要换。