今日概览

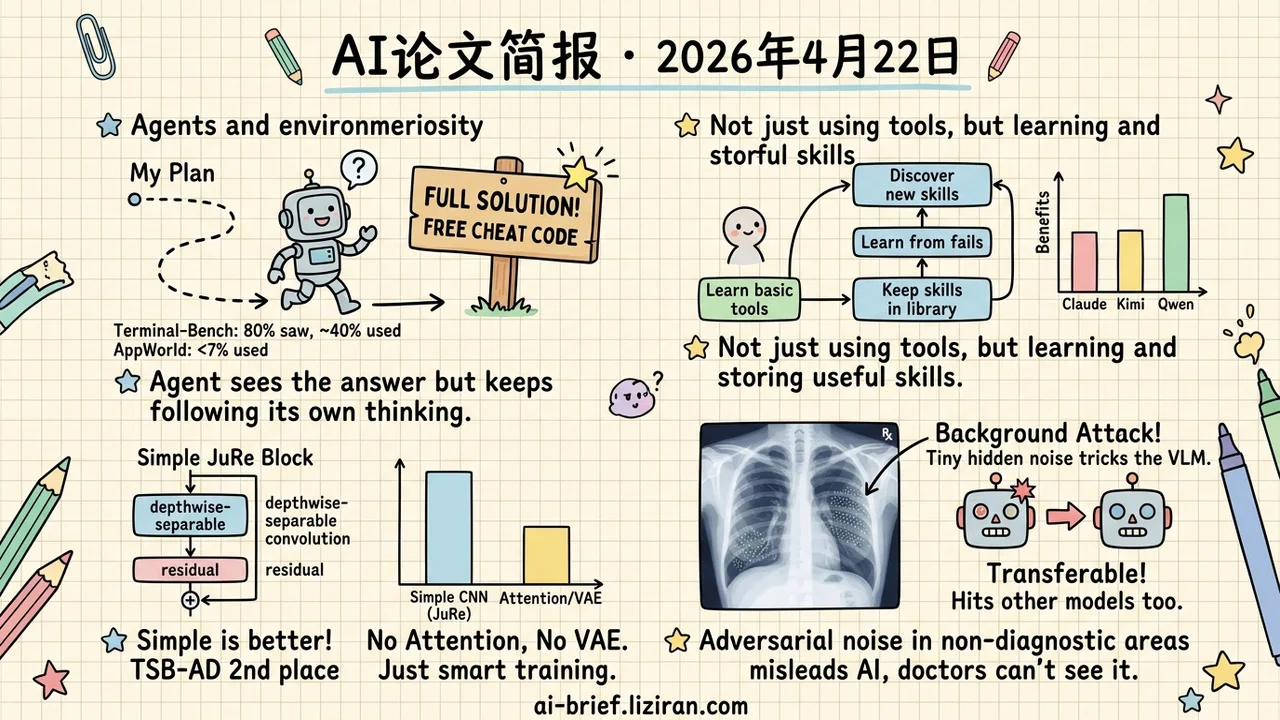

- Cohere把答案直接放到agent能读到的地方,它仍然按自己的reasoning trace继续走:Terminal-Bench里79-81%的运行「撞见」解法却只有37-50%去用,AppWorld里读到捷径的agent真正调用的不到7%。

- SkillFlow把agent评测从「会不会用工具」挪到「能不能从经验里积累技能」,166任务×20家族专门暴露lifetime级失败模式;Kimi K2.5技能使用率66.87%只换来+0.60个点。

- JuRe用128维的depthwise-separable卷积残差块在TSB-AD拿第二,没有attention、没有潜变量、没有对抗组件,消融显示拉开差距的是训练扰动而非网络容量。

- MedFocusLeak在医疗影像非诊断区域注入肉眼不可见扰动,六种模态SOTA攻击成功率,且黑盒可迁移——一个VLM上的对抗样本能打中另一个。

重点关注

01 把答案塞到agent面前,它依然视而不见

Cohere做了个近乎恶作剧的实验:在Terminal-Bench、SWE-Bench、AppWorld三个环境里,把任务的完整解法直接注入到agent能读到的地方——相当于把答案摊在桌上。Terminal-Bench里agent在79-81%的运行中确实「撞见」了这些解法,但真正去利用的只有37-50%;AppWorld更夸张,超过90%的尝试中agent读到了文档里写着「这个命令返回该任务的完整解法」,真正去调用的却不到7%。也就是说agent不是没看见,是看见了不在乎——它按自己原本的reasoning trace往前推,对环境里突然出现的免费信号彻底无视。论文把这叫做「环境好奇心」(environmental curiosity)的缺失:当前agent把环境当成信息检索接口,用来获取预期中的信息,却不会根据观察主动修订策略。更值得注意的是,即便联合优化了工具配置、test-time compute和训练数据分布,大多数情况下agent仍然会忽视眼前的解法。

原文:Agents Explore but Agents Ignore: LLMs Lack Environmental Curiosity

02 Agent 技能用得多,不等于用得好

多数agent benchmark测的是「能不能用给定工具完成任务」,SkillFlow把评测目标挪到了更难的维度:能不能从经验里发现技能、失败后修复、并长期维护一个连贯的技能库。166个任务分成20个家族,同家族内部任务之间存在依赖——这种设计专门用来暴露只做单步评测看不到的lifetime级别失败模式。结果值得玩味:Claude Opus 4.6在lifelong协议下成功率从62.65%提升到71.08%,但Kimi K2.5技能使用率达到66.87%却只换来+0.60个点的提升,Qwen-Coder-Next甚至比不用技能库时还差。这组数字说明「调用技能」和「从技能中获益」是两种能力,很多声称支持自我进化的agent框架可能需要重新标注自己的能力边界。

原文:SkillFlow: Benchmarking Lifelong Skill Discovery and Evolution for Autonomous Agents

03 模型架构 一个128维卷积块凭什么干掉一堆attention SOTA?

JuRe的全部结构就是一个depthwise-separable卷积残差块(hidden dim 128)加一个参数免的结构差异打分函数,没有attention、没有潜变量、没有对抗组件——在TSB-AD多变量基准上排进了第二(AUC-PR 0.404,17个数据集),UCR单变量档案上也排第二,神经网络基线里拿了第一。反常识的地方在于,时序异常检测当前主流一直在往复杂架构堆料——attention、latent variable、对抗训练轮番上场,而JuRe证明这条路至少在方向上可能就错了。更有意思的是消融结果:真正拉开差距的是训练时的数据扰动方式(移除后AUC-PR掉0.047),而不是网络容量——换句话说,把去噪目标写对比加层数重要。

原文:Back to Repair: A Minimal Denoising Network for Time Series Anomaly Detection

04 安全对齐 在医疗影像背景里藏毒,医生看不出但模型会被带偏

MedFocusLeak的做法是在医疗影像的非诊断区域注入对人眼不可见的协调扰动,再用注意力分散机制把模型的焦点从病灶区拖走,让它输出错误但临床上讲得通的诊断。临床医生判断影像本就靠病灶区域,而这些背景扰动在肉眼看不出任何异常的前提下,系统性地把模型注意力从医生会关注的位置偏移开——相当于绕过了人工审查层。六种影像模态上都拿到了SOTA攻击成功率。更值得关注的是黑盒可迁移性:攻击者不需要目标模型权重,在一个医疗VLM上生成的对抗样本能打中另一个,意味着这是模型族层面的共性弱点而不是单一模型的bug。部署医疗VLM的团队需要把这类背景域攻击纳入robustness测试,只看病灶区域扰动不够。

原文:When Background Matters: Breaking Medical Vision Language Models by Transferable Attack

也值得关注

今日观察

SkillFlow的底层假设是「agent能从经验里提取并维护技能」,Cohere的Agents Explore在同一天把这个假设的前置条件拆穿了:连摊在桌上的现成解法都拾取不起来,遑论从更微妙的经验模式里提炼长期能力。两篇论文没有相互引用,但放一起读会改变评估agent框架「是否work」的次序——先看它能不能对observation产生响应,再谈能不能形成持久技能库。Continuity Layer和AnchorMem碰巧也在同一天出现,从memory架构一侧呼应了相同的缺口:如果agent连当下看到的都处理不动,哪一层的记忆结构都是空中楼阁。

一个具体动作:在你现有的agent集成里埋一个对照用的「明显捷径」——比如在工具返回里塞一条「调用X可以一步完成此任务」的提示——跑一批任务看它会不会用。如果命中率低于50%,比调prompt和换模型更紧迫的是回头检查reasoning trace和observation流之间到底有没有真的连上。