今日概览

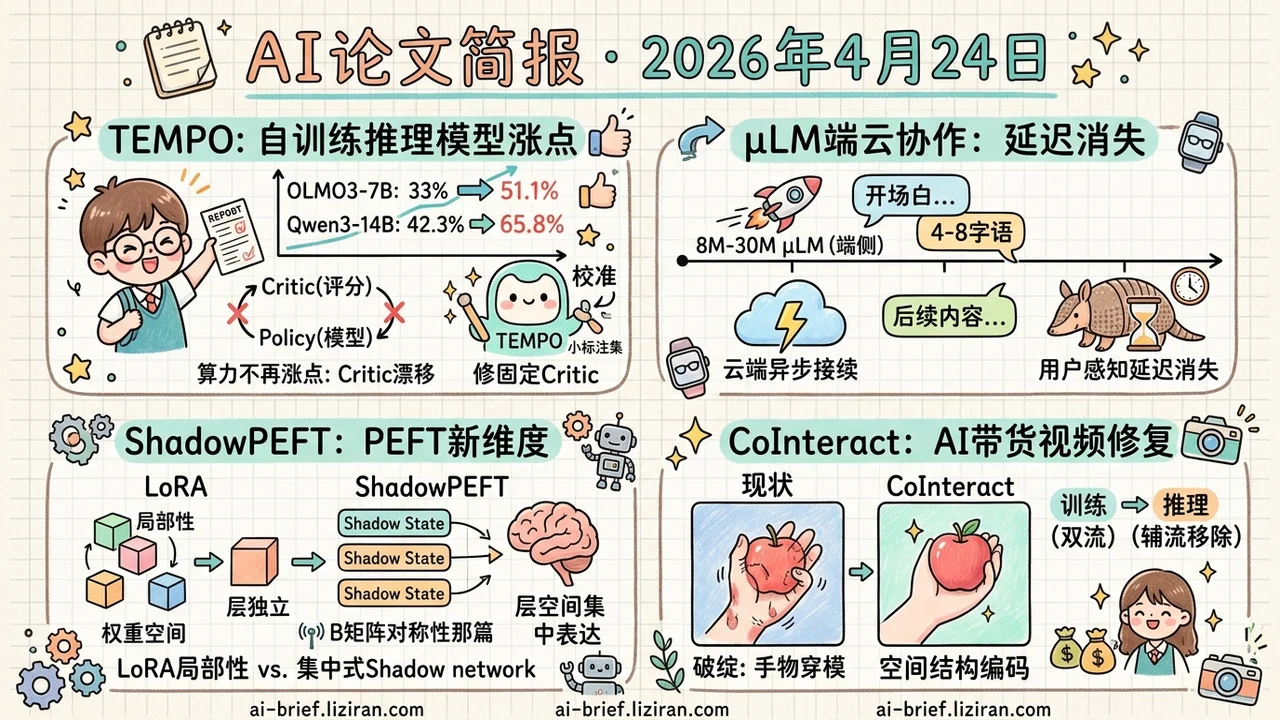

- 自训练推理模型加算力不再涨点的源头是critic也跟着policy漂——TEMPO周期性用小标注集重新校准critic,OLMO3-7B在AIME 2024从33%涨到51%、Qwen3-14B从42%涨到66%,多样性同时保住。

- 8M-30M端侧μLM只生成响应前4-8个词,云端模型异步接续后半段:用户感知里延迟消失,端云从二选一改成「开场白+续写」分工。

- LoRA的「局部性」是一个可独立拎出来的诊断维度,ShadowPEFT用集中式shadow network把adaptation从权重空间挪到层空间,和两天前B矩阵对称性那篇是同类信号。

- AI带货视频里观众一眼识破的不是画质,是手脸异常和手物穿模。CoInteract用双流训练把空间结构提前编码进生成,推理时辅流被整条移除不增加生成开销。

重点关注

01 推理 自训练推理模型撞墙,奖励信号在跟着模型漂

Test-time training(TTT,推理时用未标注问题继续更新参数)被当成推理模型免费涨点的路径,但实测多家团队都卡在同一个地方:加更多算力也再涨不动,并且多样性会跟着塌缩。TEMPO给出的诊断是,模型用自己生成的奖励训自己时,模型变了,给它打分的critic也跟着漂——奖励信号失去外部锚点,整套循环陷入停滞。修法是周期性用一个有标注的小数据集去重新校准critic,把奖励信号拉回去;用EM算法形式化之后,这一步刚好是前人方法里被省掉的关键校准步。OLMO3-7B在AIME 2024上从33.0%提到51.1%,Qwen3-14B从42.3%到65.8%,多样性没塌。对正在做self-improve方向(用模型生成的数据继续训练自身)的推理团队,这篇把「继续训也不涨点」从经验直觉变成了可定位、可修复的故障点。

原文:TEMPO: Scaling Test-time Training for Large Reasoning Models

02 推理加速 端侧模型只写前8个词,剩下交给云端会怎样?

之前讨论端侧模型基本是个二选一题:要么模型够大但延迟感人,要么模型够小但生成质量打折扣。这篇换了个思路——8M-30M的μLM不负责完整生成,只在本地瞬时吐出响应的前4-8个词,云端模型异步接续后面,用户感知就是延迟消失了。云端在这里被重新定义为「续写者」而不是「应答者」,再配上三种错误修正机制兜底本地开头偏轨的情况。对smart glasses、smartwatch、AR这类同时被电池和延迟卡住的产品来说,这是一个工程上立刻能落地的分工方式。需要看全文确认的是网络抖动下的鲁棒性——本地开了个头但云端没及时接上时体验会怎样,摘要里没展开。

原文:Micro Language Models Enable Instant Responses

03 训练优化 PEFT的另一条分歧:adaptation该集中还是分散?

LoRA给每个权重单独插一个低秩扰动,每层每个矩阵各自适应,跨权重之间没有显式协调——这种「局部性」本身可以单独拎出来当一个诊断。ShadowPEFT走另一条路:在每个transformer层维护一个并行的shadow state,通过深度共享的模块反复演化它,把adaptation从权重空间挪到层空间集中表达。这个shadow模块和backbone解耦,可以跨深度复用、独立预训练,甚至以detached模式部署,对边缘推理场景是个友好的特性。Benchmark上跟LoRA、DoRA在同等可训参数预算下大致打平,并没有戏剧性提升。但和两天前那篇从B矩阵对称性切入的LoRA分析放在一起看,PEFT工具链正在从不同维度审视LoRA的基本形状——这条线索比任何一篇单独的指标更值得跟进。

原文:ShadowPEFT: Shadow Network for Parameter-Efficient Fine-Tuning

04 视频生成 AI带货视频里,观众一眼识破的不是画质

人物-商品交互视频里,观众识别「这是AI」最高频的两个信号是手脸结构异常和手指穿过商品——比整体画质问题更刺眼。CoInteract把这两类失败抽出来作为显式约束塞进Diffusion Transformer:一边用Human-Aware MoE(混合专家)把手脸区域的token路由到轻量化的区域专家,提升精细结构稳定性;一边采用双流训练,主流生成RGB图像,辅流单独编码人-物交互的几何结构去正则化共享主干权重,推理时辅流被整条移除、不增加生成开销。思路上的差别是把空间结构提前编码进生成过程,而不是后处理修补。摘要只给了定性结论「显著优于现有方法」,没列具体指标,提升幅度需要看全文确认。对真在做电商/广告短视频自动化的团队,这条路线值得跟一下——这两类破绽消失,远比整体画质再上一档对转化率的影响更直接。

也值得关注

今日观察

TEMPO在test-time training上、ShadowPEFT在LLM PEFT上,两条互不交叉的工作线给出了几乎同形的诊断:方法的天花板不在capacity或compute,而在「局部独立」这个结构假设。TTT让模型给自己打分,self-generated reward没有外部锚点,policy一动就漂;LoRA在每个权重上独立插一个低秩扰动,adaptation之间没有任何跨权重的协调机制。两边给出的修复也对称得有点意外——TTT加外部calibrator重新校准critic,PEFT把分散的扰动改成一个集中的shadow network。两篇没有相互引用,但落在同一个架构层面的判断上:核心问题是缺一个跨步骤、跨权重的全局锚点。

如果你正在做reasoning model的self-improve或在做LLM的PEFT工具链,下一阶段值得自检的不是「再调哪个hyperparameter」,而是把训练/适配链路画出来,看看里面是否存在一个全局锚点:是不是每k步过一次外部校准的小数据集?是不是所有LoRA层共享一个集中表示?建议把「局部vs全局」先作为一个诊断维度标在你的实验记录里——下次再遇到「怎么也调不动」时,至少多了一个可检查的方向,而不是又回到调learning rate和rank的循环里。