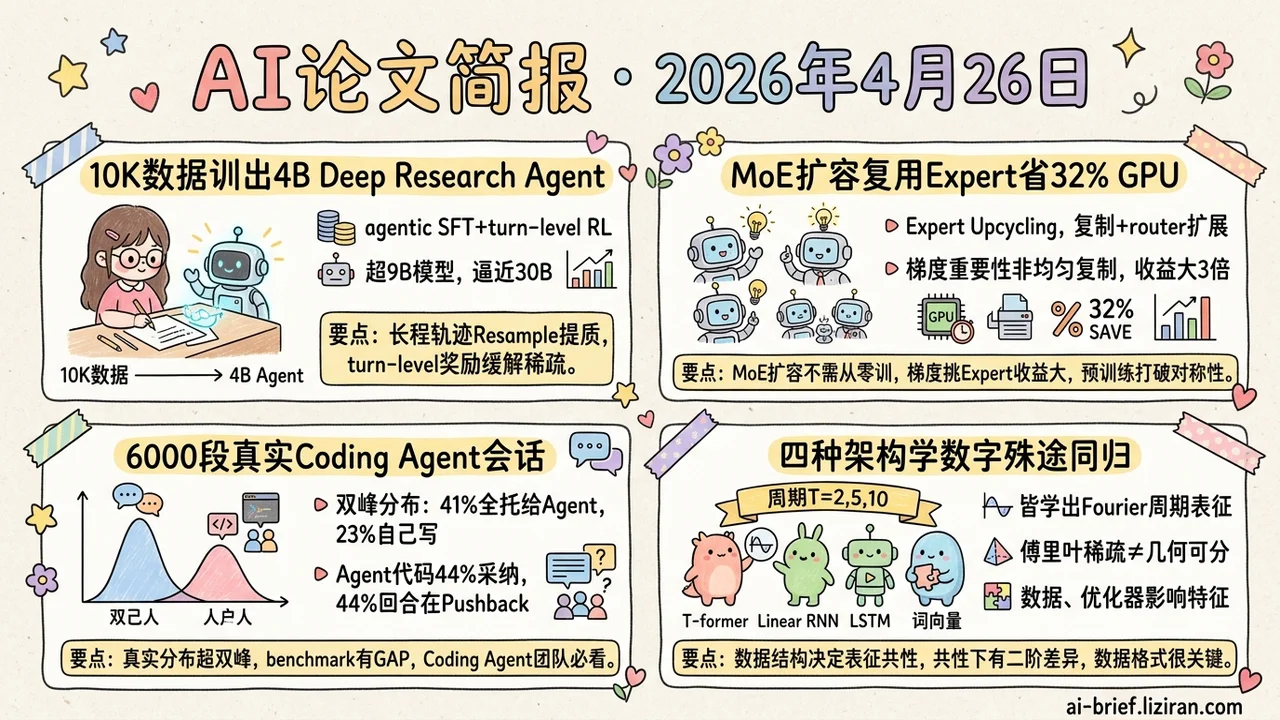

今日概览

- 10K开放数据训出4B deep research agent:DR-Venus用agentic SFT+turn-level RL的两阶段recipe训出edge可部署的agent,能力超9B以下agentic模型并向30B级缩小差距

- MoE扩容复用现有expert省32% GPU时间:Expert Upcycling从已训checkpoint做expert复制+router扩展,再让expert重新分化;按梯度重要性挑expert复制能再放大3倍收益

- 6000段真实coding agent会话首次公开:SWE-chat显示用户使用呈双峰分布——41%几乎全托给agent、23%自己写所有代码,agent代码只44%被采纳、44%回合在pushback

- 四种架构学数字殊途同归,但仍藏二阶差异:Transformer/Linear RNN/LSTM/词向量都学出T=2,5,10的Fourier域周期表征,能否mod-T线性分类还取决于数据格式和优化器

重点关注

01 Agent 10K开放数据训agent,怎么把每条轨迹的价值榨干

训deep research agent最现实的瓶颈不是算力或参数量,而是高质量long-horizon轨迹的稀缺——开源能拿到的有效数据并不多。DR-Venus给出了一份在10K开放数据下的训练recipe:第一阶段做agentic SFT(监督微调),关键动作是严格的数据清洗加上对长程轨迹做resample,避免长轨迹在batch中被普通样本淹没。第二阶段在IGPO基础上做强化学习,设计turn-level奖励,把信息增益和格式正则作为监督信号,提高每一步的credit assignment密度,缓解稀疏反馈对小agent训练的影响。结果是这套recipe能在多个deep research benchmark上超过9B以下的agentic模型,并向30B级缩小差距。abstract对第二阶段的reward实现细节交代得偏略,具体改造和权重需要看全文确认;但仅stage-1的数据处理思路就已经是可以直接拿来对照自己pipeline的样本。

原文:DR-Venus: Towards Frontier Edge-Scale Deep Research Agents with Only 10K Open Data

02 训练优化 扩容MoE不必从零训:复制现有expert再让它们分化

7B到13B规模上,从已有MoE checkpoint扩容expert数比从零训省32% GPU时间,验证loss追平。Expert Upcycling的核心操作是把E-expert模型通过expert复制+router扩展变成mE-expert,每token激活的expert数不变(推理成本也不变);复制提供温启动——loss起点比随机初始化低不少——后续继续预训练再打破对称性让expert重新特化。作者还提出基于梯度重要性的非均匀复制——哪些expert更值得复制由训练梯度的重要性打分决定——在继续预训练预算受限时能把质量缺口的弥合提升3倍以上。对手里已有MoE base、想往更大expert数走的团队,这是一条比从零训实在的扩容路径——但收益依赖有足够的继续预训练预算让复制出来的expert真正分化开,预算太短拿不到这个节省。

原文:Expert Upcycling: Shifting the Compute-Efficient Frontier of Mixture-of-Experts

03 代码智能 真实用户怎么用 coding agent,第一次有了数据

做 coding agent 产品的团队过去判断「用户到底怎么用」基本靠直觉和零散反馈。SWE-chat 把开源仓库里能抓到的真实会话拼成了一个数据集——6000段会话、6.3万条用户prompt、35.5万次tool call,并且会持续更新。初步分析有几个值得记住的数字:41%的会话里几乎所有代码都是agent写的(「vibe coding」),23%的会话里人类自己写所有代码,使用模式是双峰分布;agent产出的代码只有44%进入了最终commit,且引入的安全漏洞比人类写的多;44%的对话回合里用户在通过修正、报错、打断来对抗agent。这些数字本身比任何curated benchmark都更接近「线上真实分布」。但要注意它的定位是基础设施而不是结论——abstract只承诺是living dataset,后续价值取决于研究社区在上面做出多深的分析。

原文:SWE-chat: Coding Agent Interactions From Real Users in the Wild

04 可解释性 Transformer、LSTM、词向量学数字,居然殊途同归

四种完全不同的架构——Transformer、Linear RNN、LSTM、经典词向量——在自然文本上训练后,独立学出了周期为2、5、10的Fourier域数字特征。表征学习研究通常在找「不同架构学到的东西有什么差异」,这篇反过来报告共性:不是哪个架构擅长,而是数据本身的结构会逼出同一种解。更有意思的是还藏着第二层——Fourier域有周期spike只是必要条件,能不能用几何方式线性分类mod-T是另一道门槛,只有部分模型过得去。论文证明了Fourier稀疏不蕴含几何可分,并发现数据、架构、优化器、tokenizer都会影响这一步;一个意外细节是多token的加法题能催生几何分离,同样的题写成单token就不行。这不是某个新的解释机制发现,而是给「不同模型学到的东西到底有多像」这个老问题切出了两层分辨率。

原文:Convergent Evolution: How Different Language Models Learn Similar Number Representations

也值得关注

今日观察

DR-Venus和Expert Upcycling同一天都用了frontier这个词,但移动方向相反:DR-Venus把deep research agent的能力前沿往4B/edge推;Expert Upcycling把MoE训练的compute-efficient frontier往更大的total-param推,同时压低实际训练成本。两条独立路径共同在拆解「frontier=最大模型+最多算力」的默认设定——一边证明小尺寸能拿到此前以为只属于云端的能力,一边证明大尺寸不一定要付从零训练的代价。对从业者的意义:选型时「用什么frontier」已经不再是单一谱系,而是分到了至少两条独立的路上。

具体行动:下次说「我们用frontier model」之前停一秒——想要的是能力天花板那一档,还是「同等能力但便宜一半」那一档?这两件事今天已经分开了。手上有dense或小MoE checkpoint在权衡是否扩容的,把Expert Upcycling列进对比方案而不是只看从零训的报价;在评估端侧deep research可行性的,先用DR-Venus的stage-1数据recipe在自己几百条轨迹上跑个最小验证再做判断。