今日概览

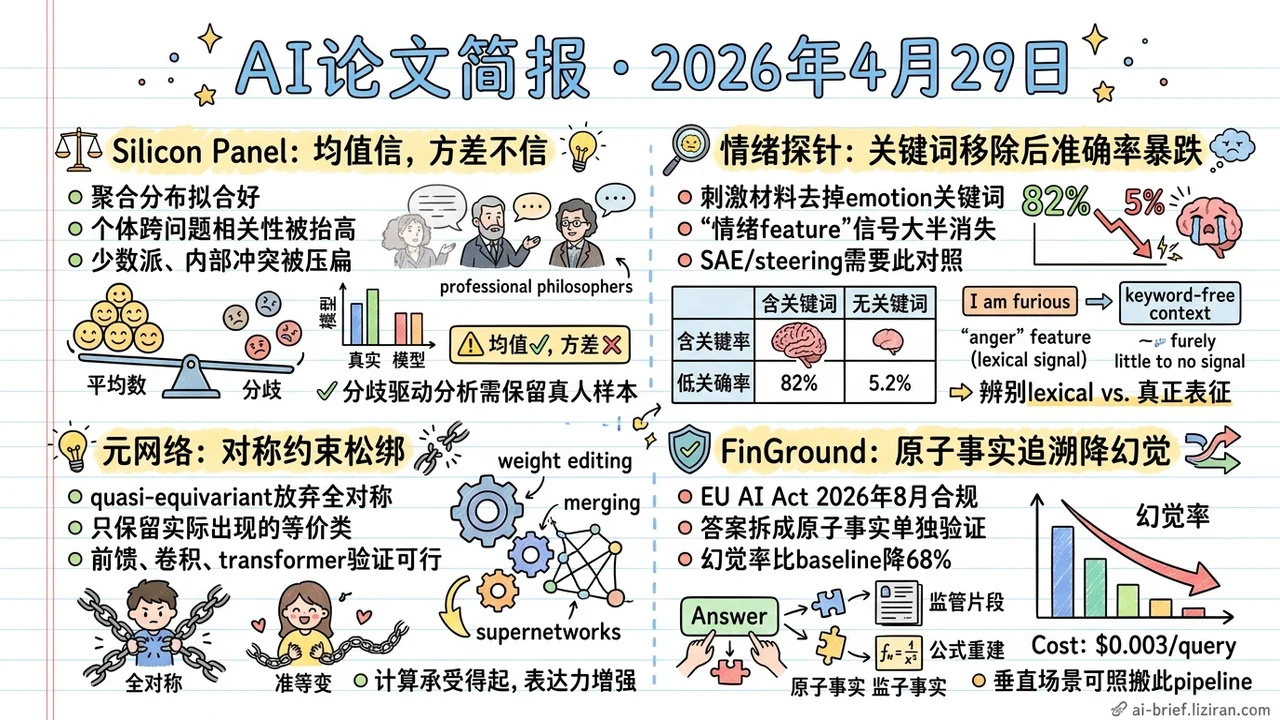

- silicon panel在均值上可信、在方差上不可信——Stanford用277位职业哲学家做ground truth,七个开源闭源模型都能复刻聚合分布,但跨问题相关性被系统抬高、少数派和内部冲突被压扁;做对齐panel、合成调研,只要分析依赖「分歧形状」就拿不到真信号。

- 情绪探针在去关键词刺激上准确率从82%塌到5%。 MIT的AIPsy-Affect给了480条配对刺激、把emotion关键词全部移除,已发表的「情绪feature」在新基线下大半信号消失,后续做emotion probing/SAE/steering不上keyword-free对照等于直接打折。

- 元网络的对称约束被松了一档: quasi-equivariant放弃理论全对称,只在实际会出现的等价类上等变,前馈、卷积、transformer都验证可行,做weight editing、模型merging、超网络方向的团队该看看自己的对称设计是不是过度严格。

- FinGround按原子事实回溯监管片段,幻觉率比最强baseline降68%,8B检测器保留91.4% F1、单query 0.003美元;EU AI Act 2026年8月节点把「减少幻觉」从产品风险升级成合规风险,法律、医疗任何「事实可追溯」的垂直都能照搬这个「verify-then-ground」分解。

重点关注

01 安全对齐 合成panel能复刻均值,但分歧信号被系统性压扁了

用LLM代替真人做问卷panel这件事,已知的结论是「聚合分布拟合得不错」——Stanford这篇也确认了这一点。新做的工作是把「复刻个体立场」和「保留跨问题相关性结构」分开测:在哲学领域用277位职业哲学家的PhilPeople公开立场作为ground truth,对比七个开源和闭源模型,发现个体重现可以接受,但模型给出的判断之间的相关性被显著拉高——也就是模型隐含地假设了「专业人士在跨领域问题上立场是高度协同的」,少数派、边缘立场、内部冲突在silicon panel里被压扁。这个现象在更大规模的PhilPapers 2020 Survey(N=1785)上依然成立,DPO微调没有改变这个倾向。对从业者的实际意义是分场景的:拿LLM做合成用户调研、对齐用的道德panel、行为模拟,如果分析靠的是均值或多数票,结果还能用;但只要决策依赖「分歧的形状」——评估争议性、识别长尾偏好、做对抗性红队——拿到的就是被同质化过的版本,需要补真人样本或显式建模异质性。

原文:The Collapse of Heterogeneity in Silicon Philosophers

02 可解释性 探针测到的是情绪,还是「愤怒」这个词

机制可解释性研究情绪表征时,刺激材料常常直接含有情绪词——「I am furious」。探针在这上面firing,到底是模型识别出了愤怒,还是识别出了「furious」这个词?MIT这套AIPsy-Affect给了480条临床刺激材料,其中192条用纯叙事场景诱发Plutchik八种基本情绪,关键是把所有情绪关键词surgically移除,再配对192条只去掉情绪、其余结构完全相同的中性对照。三种NLP防御测试印证了这个性质:bag-of-words只看到情境词汇,连上下文分类器虽然能检出有情绪存在(p<10^-15),分类准确率也只有5.2%,而在含关键词的对照集上能到82.5%。换句话说,过去那些在含关键词刺激上稳定激活的「情绪feature」,现在多了一道证伪它的工具。

03 模型架构 权重空间学习的对称性约束被松了一档

把神经网络权重当输入的元网络(metanetwork)有个绕不过去的问题:同一个函数对应无穷多组参数,直接吃原始权重容易把等价的网络看成不同样本。之前的解法是严格等变——让网络对所有理论对称性都保持不变,代价是结构稀疏、表达力下降。这篇提出quasi-equivariant:不追求理论上的全对称,只在实际数据里真正会出现的等价类上保持一致,工程上够用、计算上可承受。论文在前馈、卷积、transformer三类架构上都验证了在符号保留和表达力之间能拿到更好的折中。

原文:Quasi-Equivariant Metanetworks

04 检索 当每个事实都要可追溯,RAG该怎么改

EU AI Act的高风险落地节点定在2026年8月,金融、法律、医疗这些场景里「模型编了个数字」不再只是产品瑕疵,而是合规事故。FinGround的做法不是再叠一层RAG,而是把答案拆成atomic claim(原子事实),每条单独对应回监管文件的具体片段去验证——计算类的claim还要走公式重建路径,因为43%的错误是算术错误,单纯做语义比对抓不到。在retrieval拉平的对照下,幻觉率比最强baseline降68%;蒸馏到8B的检测器保留91.4%F1,单query成本压到0.003美元。方法本身的金融色彩并不重,真正可迁移的是「verify-then-ground」这个分解粒度——任何要求事实可追溯的垂直都可以照搬。

原文:FinGround: Detecting and Grounding Financial Hallucinations via Atomic Claim Verification

也值得关注

今日观察

Silicon Philosophers和AIPsy-Affect是今天两篇互不相干的论文——一篇做哲学领域的silicon panel评测,一篇做emotion mechanistic interpretability——但落点是同形的:之前看起来「work」的测量,在更细的指标下塌了。silicon panel在聚合opinion这个粗指标上吻合,异质性塌缩;emotion probe在含关键词的stimulus上稳定firing,去掉关键词后大半信号消失。两份工作不指向同一个趋势,共享的是同一个方法论教训。

对从业者意味着:任何「这个方法能work」的claim,如果只看了一个聚合指标、或者只在常见stimulus上验证,就可能有隐藏的measurement bias——不是不能用,而是你不知道自己用的是真信号还是泄漏信号。可操作的检查清单:(1) 报聚合指标时,补一个分布形状或方差的指标看看;(2) 用常见stimulus做出的结论,换一组刻意去掉容易泄漏特征的对照重跑;(3) 把控制实验放在和主结果同样显眼的位置,而不是塞到附录。下次接手或评审一个probing/eval/sim方向的工作,先问「如果泄漏信号被去掉,主结果还在吗」——这一句话能省掉后面很多返工。