今日概览

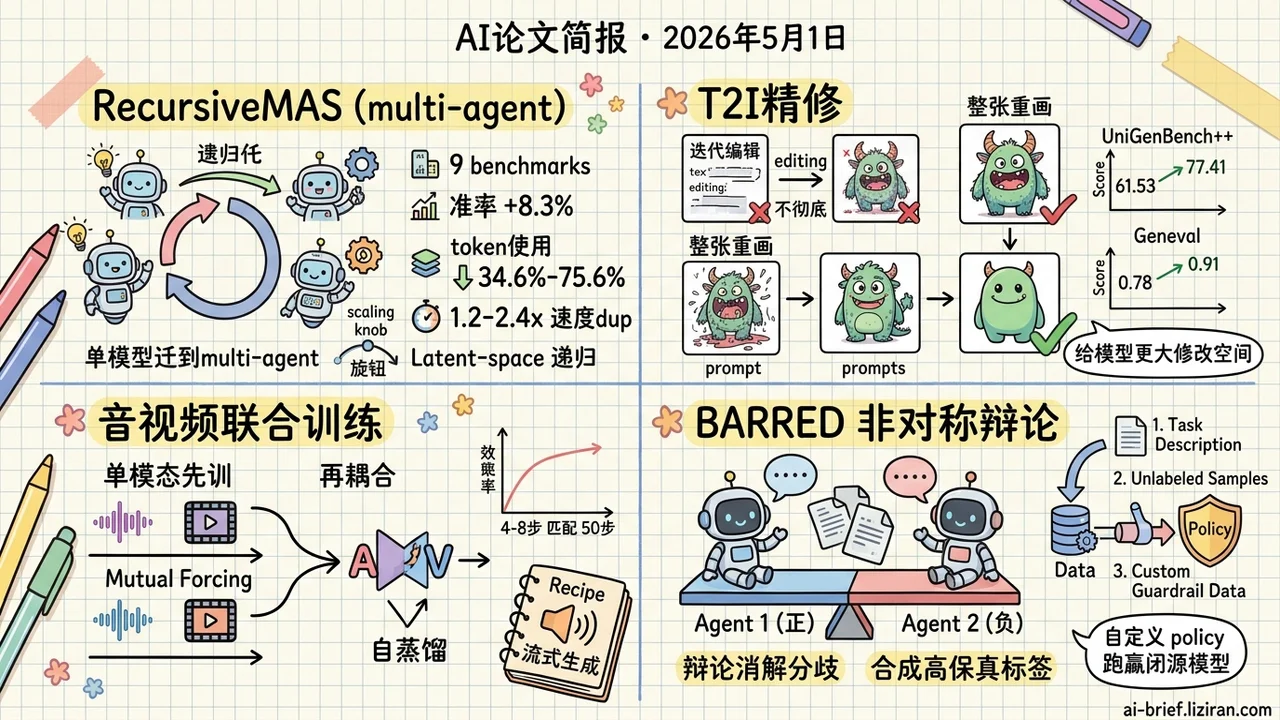

- 递归扩展从单模型迁到multi-agent:RecursiveMAS把整个多agent系统cast成一次latent-space递归计算,9个benchmark平均+8.3%accuracy、token用量降34.6%-75.6%、推理1.2-2.4x加速,给multi-agent补上一个明确的scaling旋钮。

- T2I精修,整张重画反而更彻底:editing-based路线把可改空间压窄导致改不干净,UniGenBench++从61.53推到77.41,给「局部精修」这条默认路径打个问号。

- 音视频联合训练,先单训再耦合:Mutual Forcing用两阶段训练加自蒸馏,4-8步匹配50步基线、省掉外置teacher模型,自回归流式生成的recipe更直接。

- 非对称辩论给定制guardrail造数据:BARRED只要task description加少量未标注样本就能合成训练语料,跑赢闭源大模型和专用guardrail,思路对任何边界模糊的分类任务都能挪用。

重点关注

01 Agent 把「递归扩展推理」从单模型搬到multi-agent

最近looped/recursive语言模型给出了一个新的scaling轴:让同一个模型在latent状态上反复迭代以深化推理。RecursiveMAS把这个思路从单模型迁到多agent系统——整个multi-agent系统被cast成一次统一的latent-space递归计算,agents之间通过轻量的RecursiveLink模块传递latent state。这个framing有意思的地方在于:multi-agent一直缺一个明确的scaling旋钮(参数、context、agent数量都不算干净的轴),recursion在单模型上已经被验证过,那agent协作本身能不能走同一条路。9个benchmark(数学、科学、医学、搜索、代码)+ 4种协作模式平均+8.3%accuracy,token用量降34.6%-75.6%,推理1.2-2.4x加速——latent-space递归比text-based多轮交互省掉了大量token往返,这对实际部署比那点精度提升更有价值。但摘要没给分场景拆解,也没说RecursiveLink在异构agent上怎么传递latent state,要看正文才能判断这个迁移是不是真的稳定。

原文:Recursive Multi-Agent Systems

02 图像生成 T2I精修:局部修不如整张重画

统一多模态模型(UMM)做T2I精修,主流路线(refinement-via-editing)是让模型产编辑指令、只改不对齐的局部、保留对齐部分。这篇直接翻过来:editing instruction描述偏粗,像素级保留又把可改空间压得太窄,导致改不彻底——索性不要编辑指令,用初始图的语义token加目标prompt整张重画。三个benchmark都有提升,其中UniGenBench++从61.53推到77.41幅度最大,Geneval从0.78到0.91也是明显的跳跃。结论很朴素:精修不一定要「小改」,给模型更大的修改空间,对齐反而更彻底。对做图像产品pipeline、习惯用「局部修图」做后处理的团队,这是一次值得重新审视默认路径的实证表态。

03 视频生成 音视频联合训练的秩序:先单训再耦合,比一步到位更靠谱

做联合音视频生成模型,最朴素的做法是直接拿配对数据从头一起训。Mutual Forcing选择了反向路径——先把音频和视频生成器分别训成熟,再耦合到统一模型上做联合训练,把「多模态联合优化」这一步放到最后。流式生成的设计更值得关注:之前做法(如Self-Forcing)需要先训一个双向teacher,再多阶段蒸馏成因果生成器;Mutual Forcing直接在自回归模型上做,少步与多步共享权重,多步通过自蒸馏提升少步,少步在训练时生成历史上下文提升训练-推理一致性,两个模式互相强化。这套设计省掉了外置teacher,可以直接从真实配对数据学习,训练序列长度也更灵活。最终4-8步匹配50步基线的对比是好看的,但长视频的音画同步保真度还得看demo判断。

原文:Mutual Forcing: Dual-Mode Self-Evolution for Fast Autoregressive Audio-Video Character Generation

04 安全对齐 让两个 agent 互相辩论,是不是比花钱标注更划算?

边界模糊的分类任务里最贵的从来不是模型,是标注。BARRED 的核心机制是非对称辩论:把 policy 的领域空间先拆成多个维度保证覆盖,再让两个 agent 站在边界两侧辩论一条样本该判正还是判负,分歧消解后留下的就是高保真标签。只要给一段 task description 和少量未标注样本,就能合成一份足够训小模型的语料,结果在多种自定义 policy 上跑赢了闭源大模型和专用 guardrail 模型。消融实验里维度拆解和辩论验证缺一不可——前者管多样性,后者管标签正确率。论文以 guardrail 为验证场景,但这套「用 LLM 给自己造 labeled data」的流程,对任何边界模糊、标注成本高的分类问题都可以挪用。

原文:BARRED: Synthetic Training of Custom Policy Guardrails via Asymmetric Debate