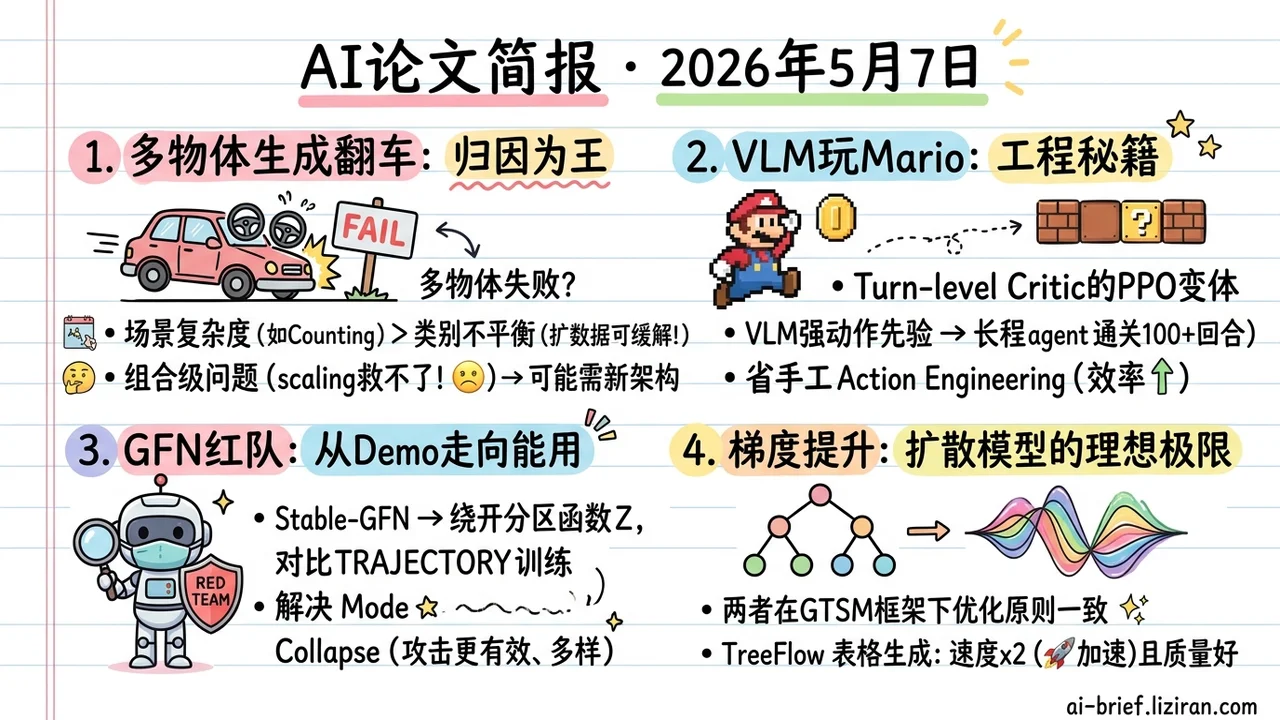

今日概览

- 多物体生成翻车要先归因再选方案:T2I多物体失败的主因是scene复杂度而非类别不平衡,concept级问题扩数据能缓解、组合级问题scaling救不了。

- VLM玩Mario到100+回合的工程配方:Odysseus用带turn-level critic的PPO变体把RL horizon从20-30推到100+,预训练VLM的动作先验替代了手工action engineering。

- GFN在红队场景从demo推向可用:Stable-GFN用对比式trajectory balance绕开partition function估计,正面修了mode collapse这块硬伤。

- 梯度提升是扩散训练的渐近最优解:决策树和扩散过程在GTSM框架下共享同一优化原则,TreeFlow表格生成提速2倍是初步可用的落地证据。

重点关注

01 图像生成 多物体生成翻车,主因不是类别不平衡

T2I模型在多物体场景上经常出问题,业界惯常的解决思路要么是改架构、要么是加CoT式规划。这篇工作往回退一步,问的是数据本身能解释多少失败。作者搭了一个叫mosaic的受控合成数据框架,把问题切成两个机制——concept generalization(每个概念都见过但分布不均)和compositional generalization(特定组合在训练时被故意剔除),然后看模型在不同数据规模下的表现。结论有两个要点:scene复杂度的影响远大于类别不平衡,counting任务在低数据规模下尤其顽固;而当训练时holdout的概念组合越多,compositional generalization会明显崩塌,scaling并不能稳定救场。换句话说,多物体失败需要先做归因——concept级的问题可以靠扩数据缓解,组合级的可能得靠新的inductive bias。注意一点:所有结论都是在受控合成数据上得到的,迁移到LAION量级的真实训练分布之前,应该在自己的失败case上做一次归因校准。

原文:When Do Diffusion Models learn to Generate Multiple Objects?

02 Agent VLM打Mario打到100+回合,关键不在游戏本身

Odysseus选超级马里奥作为试验场,把VLM交互决策的RL horizon一口气推到100+回合,比前沿模型平均通关进度高3倍以上。这之前路子一直卡得很死:RL训练horizon长期停在20-30回合上不去,靠人类轨迹SFT又费力且泛化有限。但真正值得抠的不是Mario本身——是论文给出的几个工程结论:带轻量turn-level critic的PPO变体在长horizon上比GRPO、Reinforce++这类无critic方法稳得多;预训练VLM自带强动作先验,能省掉传统深度RL那套手工动作工程,样本效率明显提升。这些结论对想做长程agent的团队是直接可用的配方。

需要泼点冷水:Mario的视觉空间和状态转移相对受控,跨游戏泛化也是在游戏域内做的——离真实productivity agent的开放环境还差不少层抽象。

原文:Odysseus: Scaling VLMs to 100+ Turn Decision-Making in Games via Reinforcement Learning

03 安全对齐 红队工具里的GFN,硬伤被正面修了一下

LLM红队既要攻击有效又要攻击多样,GFlowNet(一种把生成当成流匹配的训练范式)理论上很合适,但工程上一直跑不稳——奖励一抖动就mode collapse,输出全往一两个模板上挤。Stable-GFN的做法是绕开GFN里最难估的partition function Z,用trajectory之间的成对对比来训练,再加一个mask机制吃掉噪声奖励,外加一个fluency稳定器防止模型陷进胡言乱语的局部最优。论文给的指标是攻击成功率和多样性都比基线明显高,但要注意两点:成对对比意味着每步要多算一次轨迹,训练成本不可忽视;红队的「多样性」指标本身就可疑,编辑距离或聚类数高不代表攻击模式真的不同。对做安全评测和对抗样本生成的团队来说,这是把GFN从demo推向能用一档的工程改进,但接进自己流水线前最好先在自己的目标模型上做一轮独立验证。

原文:Stable-GFlowNet: Toward Diverse and Robust LLM Red-Teaming via Contrastive Trajectory Balance

04 模型架构 梯度提升原来是扩散训练的理想化最优解

梯度提升的理想化版本,居然是扩散模型在某种极限下的渐近最优解——这是这篇理论工作里反直觉的核心发现。作者证明决策树和扩散过程在适当极限下共享同一个优化原则:Global Trajectory Score Matching(GTSM,全局轨迹分数匹配)。落地有两个方向:TreeFlow在表格数据生成上比扩散基线快2倍且质量更好;DSMTree把树的层级决策逻辑蒸馏进神经网络,多数benchmark上在2%误差内逼近teacher。真正有意思的不是「两类模型其实是一回事」,而是双向借鉴的可能性——梯度提升能借扩散的训练直觉来改造,扩散反过来也能借树的结构思路。工程上能落多远还要看后续工作,但理论桥已经搭起来了。

原文:Trees to Flows and Back: Unifying Decision Trees and Diffusion Models