今日概览

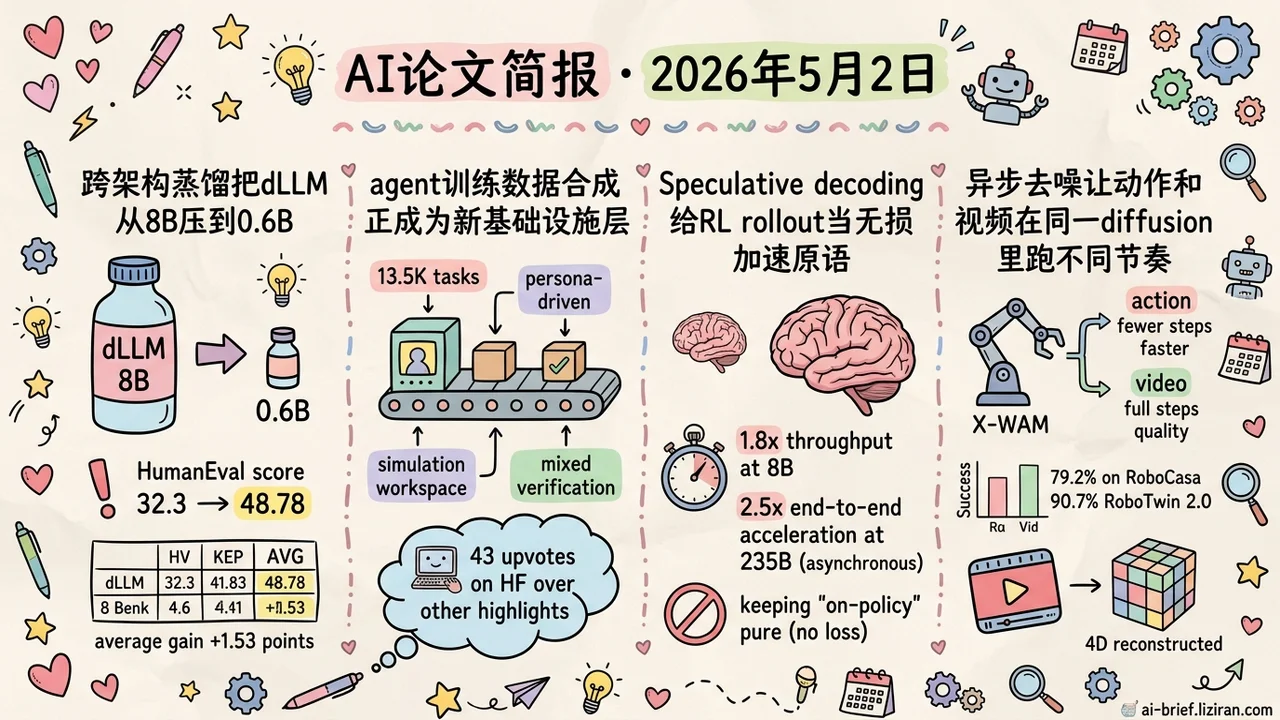

- 跨架构蒸馏把dLLM从8B压到0.6B:TIDE是首个teacher和student在架构、attention机制、tokenizer同时不同的dLLM蒸馏框架,HumanEval从32.3跳到48.78,8个benchmark平均增益1.53分。

- agent训练数据合成正成为新基础设施层——ClawGym把13.5K人设驱动任务、模拟工作区、混合验证打包发布,HF 43 upvotes超过今日所有highlights。

- Speculative decoding给RL rollout当无损加速原语,8B规模实测1.8倍吞吐,235B规模异步pipeline模拟2.5倍端到端加速,不动on-policy纯度。

- 异步去噪让动作和视频在同一diffusion里跑不同节奏。X-WAM在5800小时机器人数据上预训练,RoboCasa和RoboTwin 2.0成功率分别到79.2%、90.7%。

重点关注

01 模型架构 把扩散语言模型从8B压到0.6B,跨架构蒸馏补上一块拼图

扩散语言模型(dLLM)的并行解码和双向context是真优势,但要拿SOTA得用上80亿到160亿参数,部署成本比同尺寸AR模型高一档。TIDE做的事情是跨架构蒸馏——teacher和student在架构、attention机制、tokenizer三个层面同时不同,这是把dLLM从论文往生产推绕不开的一步,之前的dLLM蒸馏工作只在单一架构内压缩推理步数。框架由三个模块组成:TIDAL根据训练进度和扩散timestep动态调节蒸馏强度(teacher在不同噪声等级下可靠性不一样),CompDemo通过互补掩码切分让teacher在重度遮蔽下也能给出有用预测,Reverse CALM处理跨tokenizer的chunk级似然对齐。把8B dense和16B MoE的teacher蒸馏到0.6B student,8个benchmark平均提升1.53分;HumanEval从AR基线的32.3跳到48.78——代码生成是受益最明显的方向,其他任务的平均增益相对克制。需要保留的判断是:摘要展示的两条pipeline都是dLLM→dLLM,AR模型作为teacher可不可行、跨tokenizer对齐的精度损失到底多大,得看正文具体数字。

原文:Turning the TIDE: Cross-Architecture Distillation for Diffusion Large Language Models

02 Agent 比新agent loop更卡人的,是没有可验证的合成数据

agent训练过去几年的常态是各家自建小作坊:环境、轨迹、奖励信号都内部消化,跨团队几乎没有可复用的基础设施。ClawGym的重心不在又一个agent loop,而落在生命周期里最难外化的那段——可验证训练数据的系统化合成:13.5K任务由人设驱动的意图加技能级操作合成,配套模拟工作区和混合验证机制,再接上监督微调和轻量级RL训练管线。HF 43 upvotes超过今日所有highlights,社区信号挺直白:缺数据基础设施比缺prompt技巧更卡人。但摘要里看不到合成任务的实际质量分布,和真实工作流的gap多大也没说——release后的实测才能下判断。对自建agent团队,值得问的不是「我要不要换一套loop」,而是「我的训练数据合成管线有没有到工业级」。

原文:ClawGym: A Scalable Framework for Building Effective Claw Agents

03 训练优化 RL训练的提速账,能不能不动on-policy这条红线?

RL post-training的瓶颈是rollout生成——autoregressive一个token一个token地推,吃掉大半训练时间。现有提速路线多半要妥协:off-policy执行、replay、低精度生成,省了compute但都在动on-policy的纯度。这篇把推理侧成熟的speculative decoding(用小模型起草、大模型校验)搬进NeMo-RL+vLLM的rollout环节,作为无损加速原语——输出分布和原模型一致,不破坏on-policy假设。8B规模同步RL实测rollout吞吐提升1.8倍,结合异步pipeline在235B规模模拟出2.5倍端到端加速。需要保留意见的是:speculative decoding的实际收益取决于draft模型的接受率,而RL训练中后期策略分布会持续偏移,摘要没说接受率在这种偏移下是否稳定——这是部署前要自己验的。

原文:Accelerating RL Post-Training Rollouts via System-Integrated Speculative Decoding

04 机器人 实时动作和高保真视频塞进同一套去噪流程的折中方案

UWM这类unified world model把视频生成和动作预测放在同一个diffusion框架里,但只建2D像素空间,动作那一路没法做到实时。X-WAM的处理方式是给同一套denoising分两套节奏——动作走少量步数快速解码,视频走完整步数追求质量,训练时从两者的联合分布里采样以对齐推理时的不同步调。再加一个轻量的深度预测分支,复用预训练DiT的后几层来产出4D重建(视频+几何),避免重训整个模型。在5800小时机器人数据上预训练,RoboCasa和RoboTwin 2.0的平均成功率到79.2%和90.7%,4D指标也优于现有方法。但摘要没披露具体延迟和动作频率,real-time到底快到什么程度、能不能撑起闭环控制,需要看正文确认。

原文:Unified 4D World Action Modeling from Video Priors with Asynchronous Denoising

也值得关注

今日观察

ClawGym做agent训练数据合成,OCR-Memory做长程轨迹的视觉化记忆——一条管在训练前,一条管在运行时,方向不重合,但都跳过了「agent loop怎么设计」那一层,直接动agent生命周期里更底层的基础设施。两篇都拿到不弱的社区信号(前者HF 43 upvotes超过今日所有highlights),并不是孤立巧合,是延续好几个月的一条隐线:当prompt工程和reasoning chain的边际收益越来越小,决定agent上限的反而是更朴素的工程问题——可验证的训练数据从哪来、长程轨迹怎么不爆context。

从业者要做的不是再换一套loop结构,是先盘自己的两条管道:训练数据合成是否到工业级(任务多样性、模拟环境、自动验证三件套齐不齐),运行时记忆是否能撑过百轮以上轨迹(不止能记住,还要能召回、能压缩)。这两条有短板,再聪明的prompt也补不上去。

行动建议:开张表把你现在agent系统的训练数据合成pipeline和运行时记忆模块逐项列出,对照ClawGym的三件套(人设意图驱动、模拟工作区、混合验证)和OCR-Memory的非text化思路(轨迹图像化、OCR召回),看哪一格是空的——那一格就是你下个季度的工程债。