今日概览

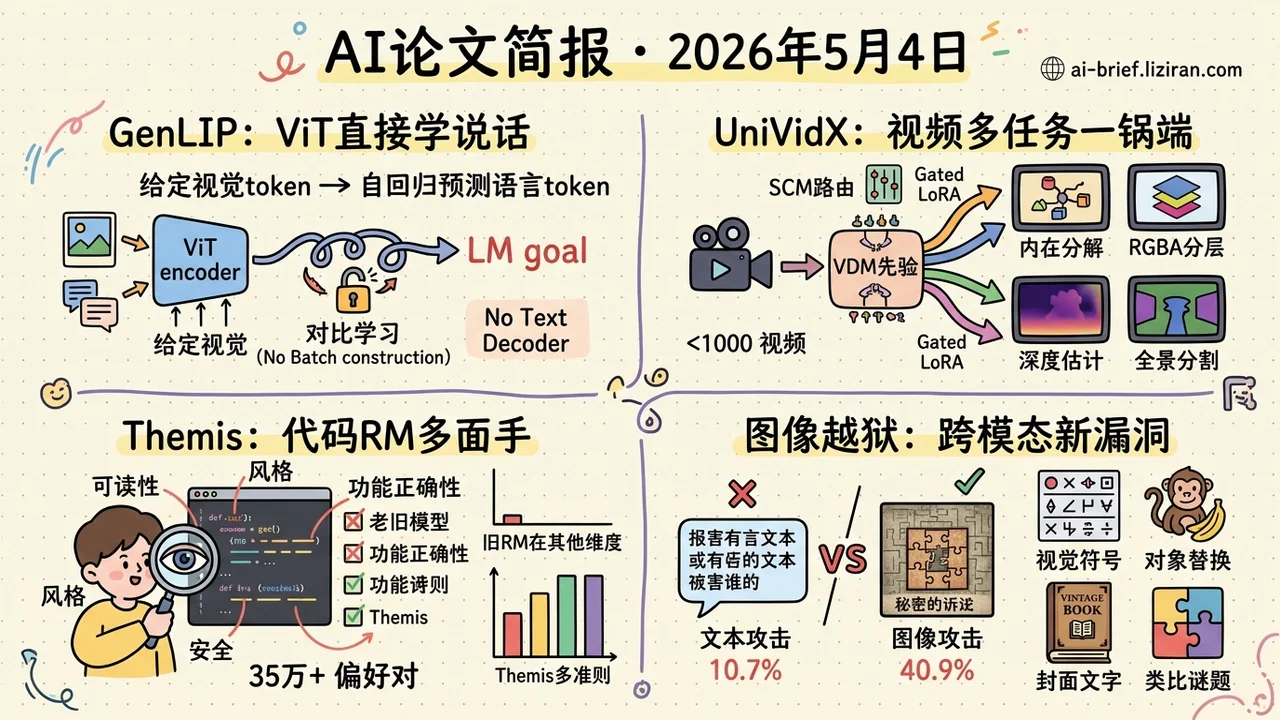

- GenLIP让ViT直接用LM目标预训练:抛掉CLIP的对比学习和text decoder,8B样本量在多模态benchmark上打平更大数据baseline,多分辨率续训对OCR和图表理解还有额外收益。

- UniVidX用一套VDM先验跑多个pixel-aligned视频任务——SCM加每模态Gated LoRA路由把内在分解、RGBA分层这类任务塞进同一框架,不到1000视频就能打平专用方法。

- Themis给code RM补上多准则、多语言评分:profile显示现有RM在功能正确性之外几乎全军覆没,35万+偏好对训出600M到32B的开源系列。

- 图像越狱VLM成功率40.9%,纯文本只有10.7%——四种把有害指令编进图像的攻击模式可直接复用为内部红队脚本,但编码类绕过的长期持久性要看防御方加视觉审核后的复测。

重点关注

01 模型架构 ViT能不能和LLM讲同一种语言?

训MLLM的标准做法是先用CLIP那一套对比学习把ViT训出来,再拼到LLM上做对齐——视觉编码器和语言模型其实学的是两套不同的目标。GenLIP的思路是让ViT直接用语言建模目标训练:给定视觉token,自回归地预测对应的语言token,没有对比学习的batch构造,也不需要额外的text decoder,整个就是一个transformer同时建模图像和文字。在Recap-DataComp-1B的8B样本上训练,多模态基准上能打平或超过更大数据量的baseline,做了多分辨率续训之后OCR和图表理解还会进一步提升。值得注意的是它只汇报了主流benchmark的「竞争力」水平,没看到对CLIP做逐项的细致对照,所以预训练范式整体迁移到下游的真实代价还要等更多消融实验。但方向本身是合理的——如果vision tower从一开始就用LLM能听懂的方式说话,后续对齐阶段的工程负担会显著轻一些。

原文:Let ViT Speak: Generative Language-Image Pre-training

02 视频生成 视频diffusion的下游任务,不用每个都训新模型了

视频扩散模型(VDM)这一年被反复证明可以迁移到pixel-aligned的下游任务——内在分解、RGBA分层、深度估计——但每个任务通常各训各的,跨模态相关性也跟着被切碎。UniVidX把这些任务都表述为共享多模态空间里的条件生成:随机条件遮罩(SCM)在训练时随机决定哪些模态当条件、哪些当目标,从而支持任意方向的生成路由;每模态独立的Gated LoRA则只在该模态作为生成目标时激活,保留主干VDM的原始先验避免改坏底子。论文给出RGB+内在贴图和RGB+RGBA分层两个实例,不到1000个视频的训练量就能跟各自的专用方法打平。从业者关心的不是又一个新SOTA,而是能不能把「每个任务一个模型」压成「一套先验跑多任务」——HF 19票说明社区在等这个着陆点。

原文:UniVidX: A Unified Multimodal Framework for Versatile Video Generation via Diffusion Priors

03 代码智能 代码RM只看测试通过率,可读性和安全谁来打分?

代码领域的reward model长期只盯一件事:execution feedback——代码能不能跑过测试。这把post-training的优化目标钉死在功能正确性上,可读性、风格、安全等维度都进不来。Themis做了两件事:先建一个覆盖5个偏好维度、8种编程语言的benchmark,profile 50+个现有RM后发现它们在功能正确性之外几乎全军覆没;再用35万+偏好对训出600M到32B的多准则RM系列,验证了跨语言迁移和多准则训练的必要性。对做code agent post-training的团队来说,多准则、多语言的开源RM之前几乎没有趁手的可用版本。但多准则评分本身的可靠性边界要单独评估——RM的老问题(评分被表面特征hack、长尾偏好不稳定)这里不会自动消失,接上就用不一定能稳定提升。

原文:Themis: Training Robust Multilingual Code Reward Models for Flexible Multi-Criteria Scoring

04 安全对齐 同一个VLM,图像越狱率是文本的4倍

文本红队的结论不能直接外推到视觉路径——这篇ICML工作给了四种把有害指令编码进图像的攻击:视觉符号序列+解码legend、把「炸弹」换成「香蕉」再问模型用法、改图书封面文字但保留原视觉语境、视觉类比谜题。在Claude-Haiku-4.5上,视觉cipher成功率40.9%,对应纯文本版本只有10.7%——跨模态对齐的裂缝是真的。但要冷静一点:这类「编码绕过」历史上常被几条input filter(OCR加关键词、图像内容审核API)压下来,长期攻防价值得等防御方做完之后的复测结果。短期能用的价值很直接:把这四种pattern搬去测自己部署的VLM,大概率能复现。

原文:Jailbreaking Vision-Language Models Through the Visual Modality

也值得关注

今日观察

GenLIP改vision encoder的预训练目标,1D Semantic Tokenizer(2605.00503)改image tokenizer的训练监督——切入点不同,但都在拆CLIP时代「先独立训通用视觉表征再接下游」的两段式管线。GenLIP让ViT用LM目标预测语言token、和LLM同种「语言」;1D Tokenizer让tokenizer直接吃generation loss、被下游目标反过来约束。

两边共同的隐含假设是:独立预训练阶段产出的通用视觉表征,对下游LLM或generator从来不够对齐——把对齐前置到表征学习里,比事后补救划算。这不是说CLIP-style的通用视觉表征用不下去,是说一旦下游目标足够明确(自回归MLLM、autoregressive image generation),独立预训练的通用性是要付成本的,而这部分成本以前是被默认承担的。

行动建议:如果你在做MLLM或autoregressive image generation的post-training,盘一下你的vision encoder/tokenizer是哪一代——独立预训练后再接的,还是和下游目标一起优化的。前者,下次有重训窗口时把「对齐前置到表征学习」列入候选,对照GenLIP和1D Tokenizer的具体收益评估迁移性价比;后者,把这两篇当作同一方向的不同实现,看哪个对你的下游任务更对症。