今日概览

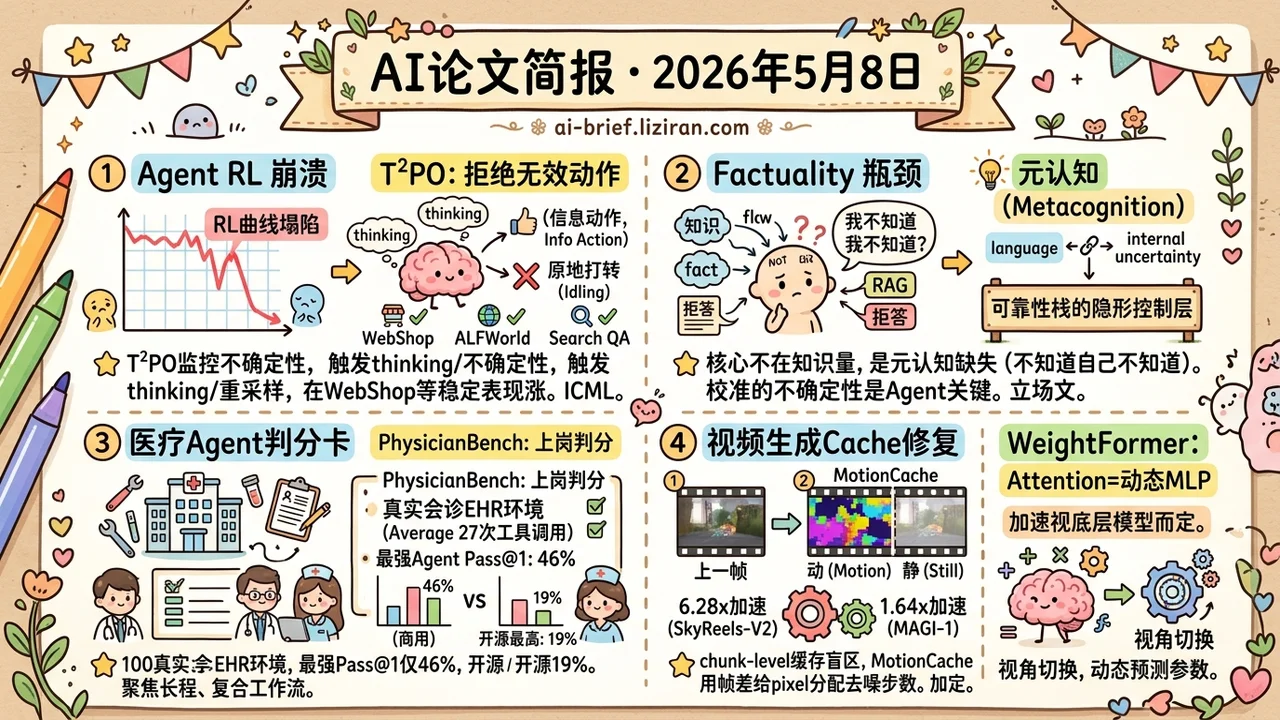

- 多轮agent RL崩溃的真凶可能不是credit assignment:T²PO用模型自身不确定性触发「thinking」和重采样,在WebShop/ALFWorld/Search QA上稳定性和表现都涨,ICML中稿。

- factuality的瓶颈是元认知,不是知识量——立场文指出模型仍然不知道自己不知道,校准过的不确定性才是Agent可靠性栈的隐形控制层。

- 医疗agent上岗判分卡:PhysicianBench把100个真实会诊搬进商用EHR环境,平均27次工具调用,最强agent pass@1只有46%、开源最高19%。

- 视频生成cache的pixel级修复:MotionCache用帧差给每个pixel分配去噪步数,SkyReels-V2拿到6.28倍加速、MAGI-1只有1.64倍,迁移效果高度依赖底层模型。

- 如果attention本质上是动态参数MLP:WeightFormer把attention数学上重写成参数动态预测的MLP,线性化架构的设计目标从「逼近softmax」变成「怎么动态预测好参数」。

重点关注

01 训练优化 多轮agent RL训练崩溃的真凶可能不是credit assignment

跑过multi-turn RL训练reasoning LLM的团队都熟悉那种崩溃曲线:奖励刚开始爬升,几百步后突然塌掉。常见解释是credit assignment不到位、轨迹过滤不够细,T²PO提出的诊断不一样:policy一直在生成「低信息动作」,既没减少模型自己的不确定性,也没从环境拿到有效信号,整轮rollout就是在原地打转。它的处理分两层:token级监控不确定性的边际变化,跌破阈值就触发一次「thinking」介入;turn级识别探索进展可忽略的交互,直接重采样掉。在WebShop、ALFWorld、Search QA三个环境上训练稳定性和最终表现都有提升,论文被ICML接收,有开源代码。需要看全文确认的是阈值怎么调、不同任务上的迁移性,但「用模型自身不确定性主动控制探索」这条路径,跟主流的credit assignment+trajectory filter是正交的。

原文:T²PO: Uncertainty-Guided Exploration Control for Stable Multi-Turn Agentic Reinforcement Learning

02 安全对齐 模型不是不会答,是不知道自己不该答

过去几年factuality的提升,主要靠让模型多记事实——把知识边界往外推。但作者指出一个被忽视的层次:模型仍然不知道自己不知道,所以即使在最简单的factoid QA上也照样自信地胡说。论文主张跳出「答还是不答」的二元选择,引入第三条路——让模型把语言上的不确定性和内在不确定性对齐,也就是metacognition(元认知)。对工具开发者来说,这一层在搭可靠性栈时很容易被越过去——通常加个RAG或者拒答阈值就交差了,但底下那个「模型自身的不确定性是否被忠实表达」才是真问题。需要注意的是这是立场文,作者承认这件事内在困难、也没给出落地方案,所以现阶段只是把问题命名清楚。

原文:Hallucinations Undermine Trust; Metacognition is a Way Forward

03 评测 医疗agent该不该上岗,这张判分卡比排行榜更值得看

之前的医疗agent benchmark大多停在静态知识题或单步操作——背medical QA、模拟一次开药决策——跟真实临床工作流的距离很远。PhysicianBench把100个真实会诊案例搬进电子病历(EHR)环境,用商用EHR厂商同款API做交互,平均每个任务要调27次工具,跨encounter拉数据、做决策、写病历,全流程有可验证的执行反馈。670个checkpoint按阶段打分,13个agent跑下来最强的pass@1只有46%,开源模型最多19%。差距不小,但更重要的是这个评测真的在测临床上岗能力,而不是医学考试分数。

原文:PhysicianBench: Evaluating LLM Agents in Real-World EHR Environments

04 推理加速 视频生成跳步加速的盲区在哪?

同一帧里,运动剧烈的物体边缘和近乎静止的背景被cache一视同仁——这是当前AR视频生成跳步加速的盲区。根源在于cache reuse停在chunk-level的粗粒度,把整段时间窗口当成一个整体决定要不要复用,对静态背景没事,对快速运动的物体就直接出现误差累积。MotionCache把粒度推到pixel级,用相邻帧差作为运动量的轻量代理,运动大的pixel多跑几步去噪、静止区域激进复用。在SkyReels-V2和MAGI-1上分别拿到6.28倍和1.64倍加速,VBench质量基本无损。两个模型差距这么大说明加速比高度依赖底层结构,迁移到其他AR视频模型需要重新评估。

原文:Motion-Aware Caching for Efficient Autoregressive Video Generation

05 模型架构 如果attention本质上是个动态参数MLP呢?

直觉上,attention的全局建模能力来自token之间的显式加权——这也是它必须O(N²)的根本原因。但WeightFormer给出了一个让人愣一下的数学重写:attention可以等价于一个参数被动态预测的MLP,所谓全局能力其实来自这些动态参数对全局上下文的压缩,而不是token-wise加权本身。从这个视角看,线性复杂度方案不必再围绕「如何逼近softmax attention」打转,可以直接去研究「怎么动态预测一个好的参数」。论文用视觉模型做了多种动态参数化策略的实验,证明这条路至少在中等尺度走得通。能不能扩到LLM尺度是另一回事,但这个重写本身已经足够打开新的设计空间。

原文:Linear-Time Global Visual Modeling without Explicit Attention

也值得关注

今日观察

今天有意思的不是某一篇,而是「long-horizon agent的可靠性」同时被四五个不同的层敲打。T²PO动训练稳定性那一层(多轮RL不崩);Metacognition动模型自我意识那一层(不知道自己不知道);PhysicianBench和AcademiClaw动任务定义那一层(去找现在解不了的真实长程任务);Counting probe动最小可靠性测试那一层(连数数都数不稳);Marginal Token Allocator动评估范式那一层(按token经济而不是文本生成评)。

每篇都在指认一个不同的失败位置,没有一篇在宣布突破。把它们拼到一起,浮现出来的隐含信号是:当下agent在真实长程任务上的不可靠不是单点问题,是分散在训练、自我认知、任务定义、最小测试、评估框架五个层面的共振。任何一层单独修都不够。

具体动作建议:如果你的团队正在做垂直Agent,挑一个最贴近自己业务的层先建监控——比如做医疗/法务这种长程tool-use场景,可以参考PhysicianBench把内部真实工作流的可验证执行链做成回归集;如果在跑多轮RL,把T²PO的「不确定性边际监控」加到训练日志里,比单看reward曲线更早能看出探索是否塌掉;如果在做evaluator,Counting probe这种最小可靠性测试值得加进CI而不是只跑大benchmark。