今日概览

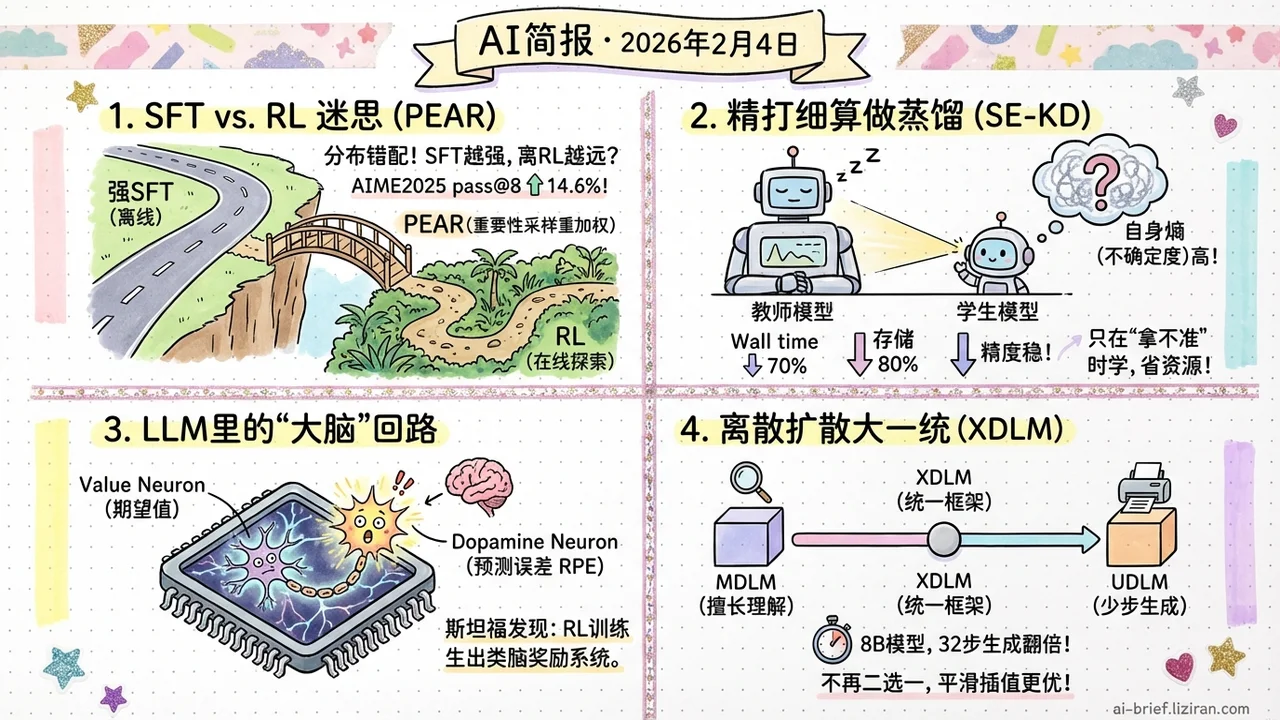

- SFT越强,RL反而越弱? PEAR用重要性采样重加权SFT损失,让SFT阶段为下游RL做好准备,AIME2025上pass@8提升14.6%

- 知识蒸馏70%的计算是浪费,SE-KD用学生模型自身的熵来选择蒸馏位置,wall time降70%、存储省80%,精度不降

- LLM内部藏着类似大脑的奖励子系统:Stanford团队在hidden states中找到了编码「期望值」和「预测误差」的value neuron和dopamine neuron

- 离散扩散模型终于不用在理解和生成之间二选一了。XDLM统一了两种噪声范式,8B模型32步生成MBPP翻倍

重点关注

01 训练优化 SFT练得越好,RL训完反而越差?

这可能是最违反直觉的训练现象之一:精心优化的SFT模型,经过同样的RL训练后,竟然打不过更弱的SFT起点。PEAR团队追溯了原因——传统SFT用离线数据训练,但RL阶段是online的,两者的数据分布存在根本错配。SFT越强,模型就越贴合离线数据的分布,离RL的online探索空间反而越远。PEAR的方案是在SFT阶段就用重要性采样对loss做重加权,让训练更偏向RL将要探索的分布。方法分token、block、sequence三个粒度,可以叠加到标准SFT上,额外开销很小。在Qwen 2.5/3和DeepSeek蒸馏模型上,PEAR一致提升post-RL性能,AIME2025上pass@8最高提升14.6%。

原文:Good SFT Optimizes for SFT, Better SFT Prepares for Reinforcement Learning

02 训练优化 知识蒸馏的大部分计算是无用功

大模型蒸馏到小模型时,传统做法是把教师模型在每个token位置的完整概率分布都拿来做监督。但直觉告诉我们,不是每个位置都同等重要——模型已经很确定的地方不需要额外指导。SE-KD沿着位置、类别、样本三个轴系统拆解了选择性蒸馏策略,发现学生模型自身的entropy(不确定度)是最好的重要性信号:只在学生「拿不准」的位置提供教师监督就够了。三个轴联合选择(SE-KD 3X)后,教师的输出可以离线缓存而不是实时推理,wall time省了70%,峰值内存降18%,存储降80%,精度没有牺牲。

原文:Rethinking Selective Knowledge Distillation

03 可解释性 LLM的隐藏层里有一套「奖励系统」,像大脑一样

RL训练的LLM内部到底学到了什么?Stanford团队从生物学类比出发,在模型的hidden states中发现了一个稀疏的「奖励子系统」。其中的value neuron编码了模型对当前状态「价值」的内部预期——类比大脑的奖赏回路。更有意思的是,当模型的预期和实际奖励出现偏差时,另一组dopamine neuron会高强度激活,编码的正是「预测误差」(RPE)信号。这些神经元在不同数据集、不同规模、不同架构之间都很稳健,且从同一基座模型微调出的不同模型之间有显著迁移性。介入实验证实这些神经元对推理能力至关重要。

原文:Sparse Reward Subsystem in Large Language Models

04 模型架构 离散扩散模型的理解和生成不再互斥

文本生成领域有两种离散扩散范式:MDLM(遮蔽噪声)擅长语义理解和零样本泛化,UDLM(均匀噪声)擅长少步高质量生成,但各有短板。XDLM的核心洞察是这两种范式本质上是同一个框架的两个特例——通过引入一个参数化的稳态噪声核,可以在二者之间平滑插值。实际好处很直观:零样本文本理解比UDLM高5.4分,少步图像生成FID从80.8降到54.1。扩展到8B参数语言模型后,32步生成MBPP得分15.0,比baseline翻了一倍。代码已开源。

原文:Balancing Understanding and Generation in Discrete Diffusion Models

也值得关注

今日观察

今天的两篇训练优化论文共同指向一个主题:训练流水线中被忽视的错配问题。PEAR揭示了SFT和RL之间的分布错配,SE-KD揭示了教师监督和学生需求之间的注意力错配。两篇都不是提出全新方法,而是重新审视现有流程中「想当然」的做法,用简单的修正获得显著收益。同时,Stanford的奖励子系统研究和PolySAE都在推进对模型内部机制的理解——前者从RL视角,后者从特征交互视角。做后训练流水线的团队值得重新审视SFT阶段的设计,把「为RL做准备」纳入优化目标。