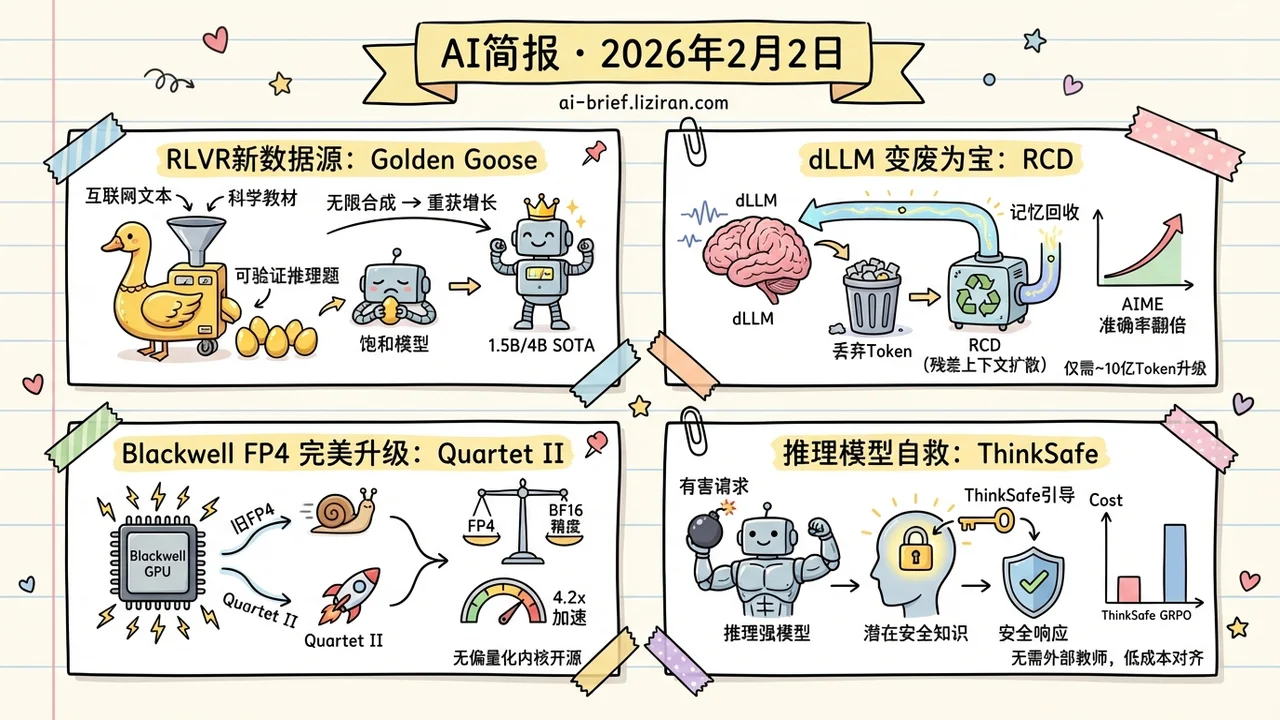

今日概览

- RLVR训练数据不够用?从互联网文本里无限合成就行。Golden Goose把未标注网页文本变成可验证推理任务,0.7M规模数据集让饱和模型重获增长,1.5B和4B模型刷新15项基准SOTA

- 扩散语言模型最大的计算浪费被堵上了,回收被丢弃的token表征让AIME准确率接近翻倍。Residual Context Diffusion只需约10亿token就能升级现有dLLM

- Blackwell GPU的FP4端到端预训练终于追平BF16精度:Quartet II用新的无偏量化方法实现4.2倍加速,kernel已开源

- 推理模型越强越不安全,但修复不需要外部教师。ThinkSafe用模型自身的潜在安全知识生成对齐数据,效果超过GRPO且计算成本大幅降低

重点关注

01 训练优化 RL训练数据见顶了?从网页文本里无限造

RLVR(带可验证奖励的强化学习)是当前让LLM学会推理的核心手段,但有个现实瓶颈:可验证的训练数据就那么多,模型训着训着就饱和了。Golden Goose提出了一个极其简单的思路——把互联网上那些「不可验证」的文本(比如科学教材)改造成多选填空题,由LLM自动找出关键推理步骤并生成干扰项。用这种方法从数学、编程、通用科学领域合成了GooseReason-0.7M数据集。效果很直接:已经在现有RLVR数据上饱和的模型,喂了这些数据后又开始涨了,1.5B和4B-Instruct模型在15个基准上达到新SOTA。更有说服力的是在网络安全领域的验证——从FineWeb原始网页里合成的训练数据,让Qwen3-4B超过了经过专门预训练和后训练的7B领域模型。

原文:Golden Goose: A Simple Trick to Synthesize Unlimited RLVR Tasks from Unverifiable Internet Text

02 模型架构 扩散语言模型最大的浪费被堵上了

扩散语言模型(dLLM)最吸引人的地方是可以并行解码,但当前最好的方法有个巨大浪费:每一步只保留最有信心的几个token,其余全部丢掉重来。Residual Context Diffusion(RCD)发现这些被丢弃的token并非一无是处——它们的表征里包含丰富的上下文信息。RCD把这些「废料」转化为残差信号注入下一步去噪,相当于让模型在迭代间保留记忆。训练上也很巧妙,用解耦的两阶段流水线绕开了反向传播的内存瓶颈,只需约10亿token就能把现有dLLM转换成RCD范式。效果很显著:在多个基准上提升5-10个百分点,AIME上准确率接近翻倍,达到同等精度所需的去噪步骤减少4-5倍。

原文:Residual Context Diffusion Language Models

03 推理加速 NVFP4端到端预训练终于追平BF16了

NVIDIA Blackwell GPU硬件支持NVFP4格式,理论上能让大模型预训练全程跑在4位精度上。但之前的量化训练方法为了保证梯度无偏性,不得不在精度上让步,和标准的FP16/FP8训练还有明显差距。Quartet II的核心贡献是一种新的无偏量化方法MS-EDEN,量化误差比随机舍入(stochastic rounding)低2倍以上。把它集成到线性层的全NVFP4方案后,前向和反向传播的梯度估计都一致更好。在1.9B参数、38B token规模的端到端训练中验证了效果,同时提供了Blackwell GPU上的kernel实现,相比BF16最高加速4.2倍。

原文:Quartet II: Accurate LLM Pre-Training in NVFP4 by Improved Unbiased Gradient Estimation

04 安全对齐 推理模型越强越不安全?让它自己修

大型推理模型(LRM)为了追求推理能力,RL训练时过度优化「顺从性」,导致面对有害请求时反而更容易配合。现有的修复方法依赖外部教师模型蒸馏安全行为,但这引入了分布偏移,会损伤模型原生的推理能力。ThinkSafe的关键洞察是:虽然顺从性压制了安全机制,模型内部其实还保留着识别危害的潜在知识。通过轻量级的拒绝引导(refusal steering),解锁模型自身的安全推理能力,让它生成分布内的安全响应作为训练数据。在DeepSeek-R1-Distill和Qwen3上的实验显示,ThinkSafe在安全性上显著优于基线,推理能力基本无损,而且计算成本比GRPO低得多。

原文:THINKSAFE: Self-Generated Safety Alignment for Reasoning Models

也值得关注

今日观察

今天扩散语言模型一下子冒出三篇高质量工作——RCD回收废弃token、FourierSampler做频域引导、Masked Diffusion的正则化调优。dLLM正在从「概念验证」快速走向「工程可用」,并行解码的实际效率瓶颈正在被逐一解决。同时,RLVR训练数据扩展(Golden Goose)和FP4预训练(Quartet II)都指向同一个方向:让更多人以更低成本训练更强的模型。做推理模型训练的团队值得把dLLM解码优化和RLVR数据合成加入技术跟踪列表。