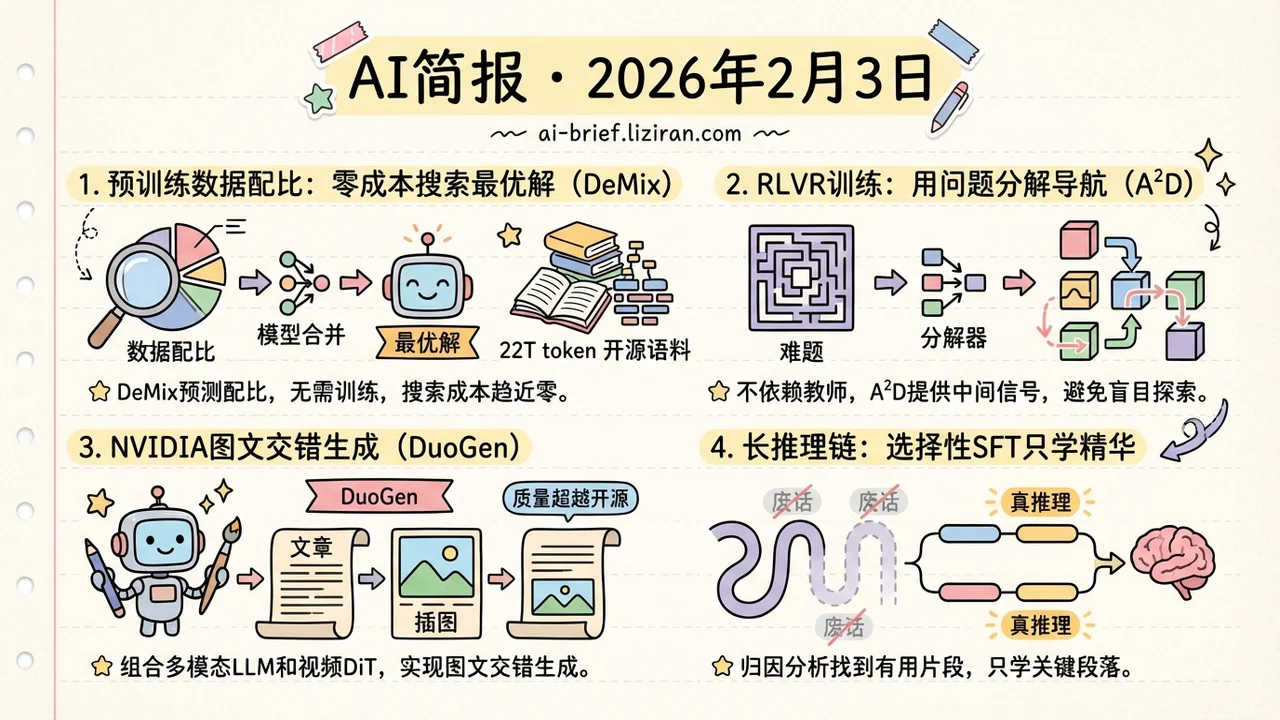

今日概览

- 预训练数据配比不用训练就能搜到最优解,DeMix用模型合并预测配比效果,搜索成本趋近于零,附带22T token开源语料

- RLVR训练时模型在难题上盲目探索,A²D用问题分解提供中间导航,不依赖教师模型

- NVIDIA要让一个模型同时写文章和画插图:DuoGen组合多模态LLM和视频DiT,图文交错生成质量超越同类开源方案

- 长推理链里大部分token都是废话。选择性SFT只学有用的片段就够了,Segment-Level Attribution用归因分析找到真正推动推理的段落,ICLR 2026

重点关注

01 训练优化 预训练数据配比还在靠小模型代理实验猜?

LLM预训练绕不开一个关键决策:数学、代码、通用文本各放多少比例?现有做法要么用小模型做代理实验(结果经常不准),要么在大规模上逐个尝试(成本极高)。DeMix的思路很巧妙——先在各个候选数据集上分别训好「组件模型」,然后通过模型权重加权合并来模拟不同配比的效果。这样搜索过程和训练过程完全解耦,想试多少种配比都不用额外训练。效果上做到了更低搜索成本下更高的benchmark表现。更有价值的是同步开源了DeMix Corpora,一个22T token的高质量预训练数据集,附带经验证的配比方案。

02 推理 RLVR训练时模型在瞎摸,能不能给条路?

RLVR(带可验证奖励的强化学习)是训推理模型的主流方法,但有个根本问题:奖励信号只告诉模型最终答案对不对,过程中完全没有引导。碰到难题时模型基本在盲目探索,效率很低。A²D的做法分两步:先用RLVR训一个「分解器」,让它学会把复杂问题拆成更简单的子问题;再用分解器为训练集标注子问题,在RLVR训练推理模型时把子问题作为中间引导。关键是分解器本身也是RLVR训出来的,不需要教师模型蒸馏。实验显示这是个即插即用的模块,可以叠加到不同的RLVR算法上。

原文:Adaptive Ability Decomposing for Unlocking Large Reasoning Model Effective Reinforcement Learning

03 多模态 一个模型能不能边写文章边画配图?

图文交错生成(Interleaved Generation)是多模态模型最诱人的能力之一——想象一个模型帮你写教程的同时直接生成步骤示意图。但现有方案受限于训练数据不足和基座模型能力,生成质量远不够用。NVIDIA的DuoGen系统性地攻这个问题:数据层面,从策展网页中改写多模态对话,再合成覆盖日常场景的多样化样例;架构层面,把预训练好的多模态LLM和视频生成DiT组合起来,用两阶段策略先调LLM再对齐DiT,避免了从头预训练视觉模型的巨大成本。在公开和自建benchmark上,文本质量、图片保真度和图文一致性都超过了现有开源模型。

原文:DuoGen: Towards General Purpose Interleaved Multimodal Generation

04 推理 长推理链80%是废话,只学关键段落效果更好

大型推理模型(LRM)靠生成长长的思维链来解题,但仔细看这些链条,大部分内容是重复、截断或无意义的填充。问题是用SFT学习时,模型会不加区分地模仿这些冗余模式,反而拖累表现。Segment-Level Attribution的解决思路很直接:用集成梯度归因量化每个token对最终答案的贡献,然后按「归因强度」和「方向一致性」两个维度打分。归因强、但方向有正有负(说明在做真正的权衡推理)的段落被标记为重要;纯正或纯负方向的段落通常是浅层模式。训练时只对重要段落计算loss,其余屏蔽掉。在多个模型和数据集上,这种选择性SFT同时提升了准确率和输出效率。

原文:Segment-Level Attribution for Selective Learning of Long Reasoning Traces

也值得关注

今日观察

今天有两个值得注意的方向交汇:DeMix的「模型合并做数据配比搜索」和A²D的「RLVR子问题引导」,加上昨天的Golden Goose,连续几天都在攻LLM训练中的数据效率问题——不是简单地找更多数据,而是更聪明地使用数据。同时,Segment-Level Attribution和Latent-CoT的分析都在揭示推理链的真实结构:真正有用的推理步骤远比表面看起来少。做推理模型训练和数据工程的团队值得关注「数据配比自动搜索」和「推理链质量过滤」这两个方向。