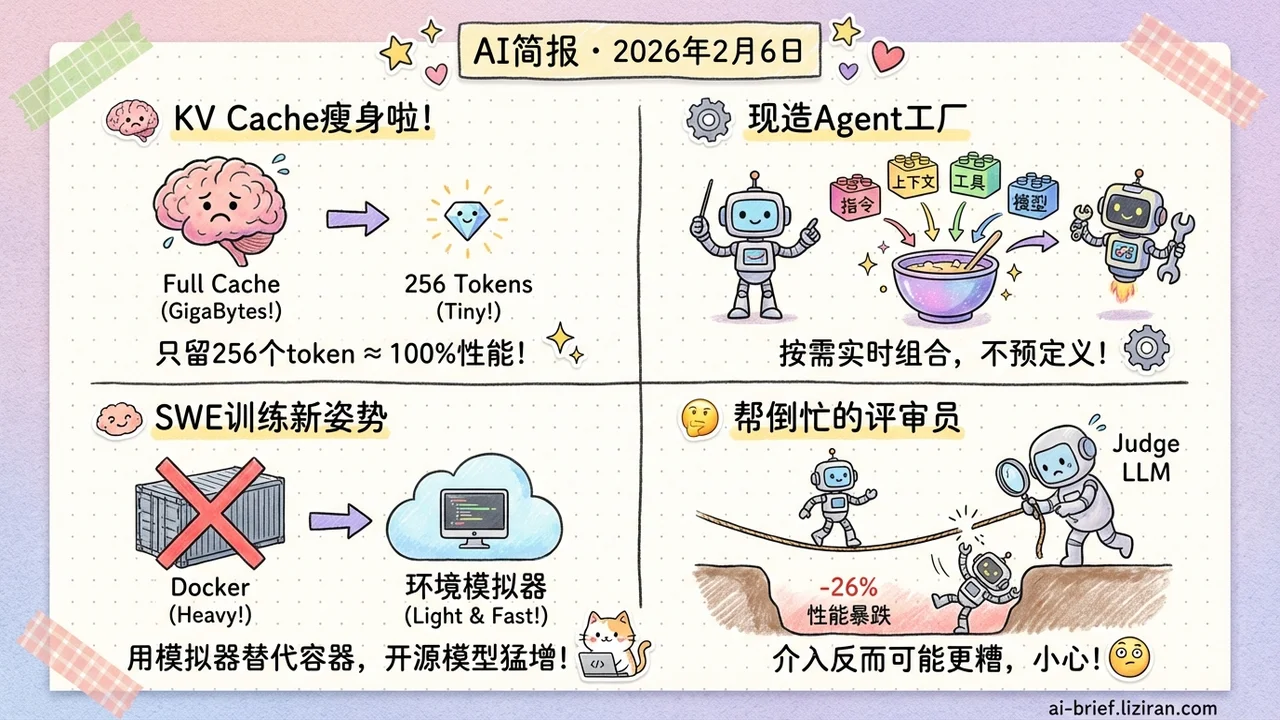

今日概览

- 只保留256个token就能逼近全量注意力性能,FASA发现RoPE位置编码中隐藏的频率级稀疏性,用它做token筛选,KV cache压缩到18.9%仍保持近100%准确率

- 多Agent系统不预定义sub-agent,让系统根据任务需求实时「造」专用执行器。AOrchestra在GAIA/SWE-Bench/Terminal-Bench三项基准上相对提升16.28%

- 训练SWE Agent不再需要Docker:SWE-World用学习到的环境模拟器替代容器化执行反馈,配合SWE-Master的后训练框架,开源32B模型在SWE-bench Verified上达到70.8%

- 能预测Agent会失败,却未必能阻止它失败。LLM评审员介入后反而让一个模型性能暴跌26个百分点

重点关注

01 推理加速 256个token就够了?RoPE里藏着KV cache压缩的「免费午餐」

长上下文推理最大的成本不是计算,是KV cache的显存。动辄几十GB的缓存让消费级硬件望而却步。现有的token剪枝方案要么靠静态规则一刀切(可能丢关键信息),要么靠启发式策略动态选择(效果不稳定)。FASA找到了一个更优雅的切入点:RoPE位置编码的频率分块(frequency chunk)中,只有一小部分「主导」分块和完整注意力头高度一致——用这些分块来判断哪些token重要,几乎不需要额外计算。实验结果很有说服力:在LongBench上只保留256个token就达到full-KV近100%的性能,在AIME24上用18.9%的cache实现了2.56倍加速。同期另一篇HySparse也在攻同一个问题,思路是用少量全注意力层做「预言机」来指导稀疏层的token选择,80B MoE模型只需5层全注意力就能KV cache压缩近10倍。

原文:FASA: Frequency-aware Sparse Attention

02 Agent 不预定义工作流,让系统按需「造」Agent

多Agent系统越做越复杂,但有一个尴尬:sub-agent通常是预先定义好的,碰到新类型的子任务就抓瞎。AOrchestra提出了一个直觉上很自然的抽象——任何Agent都可以表示为⟨指令, 上下文, 工具, 模型⟩四元组。有了这个「配方」,系统不再维护固定的Agent库,而是由中心编排器在每一步根据任务需求实时构造专用Agent:选什么工具、用哪个模型、给什么上下文,全部动态决定。这样做的好处不只是灵活,还能做性能-成本的帕累托权衡——简单子任务用轻量模型,复杂的才上大模型。在GAIA、SWE-Bench、Terminal-Bench三项基准上,搭配Gemini-3-Flash时相对最强基线提升16.28%。

原文:AOrchestra: Automating Sub-Agent Creation for Agentic Orchestration

03 代码智能 训练Coding Agent,终于可以不被Docker绑架了

训练SWE Agent最大的基础设施负担是什么?Docker环境。每个代码修复任务都需要一个依赖完整、可执行测试的容器,构建和维护成本高得惊人。SWE-World和SWE-Master是同一团队的一套组合拳。SWE-World用LLM训练了一个「环境模拟器」——输入Agent的操作轨迹,直接预测执行结果和测试反馈,完全绕开了物理Docker环境。不只是省资源,这个模拟器还能在推理时对多个候选方案做虚拟评估,实现test-time scaling。SWE-Master则是配套的后训练框架,覆盖了从教师轨迹合成、长周期SFT到带执行反馈的RL的完整流水线。两者配合的效果:Qwen2.5-Coder-32B从6.2%提升到52%(Docker-free SFT),RL进一步到55%,加上test-time scaling到68.2%。SWE-Master框架单独用RL达到61.4%,TTS@8到70.8%。

原文:SWE-World: Building Software Engineering Agents in Docker-Free Environments

04 Agent 你的Agent「监督员」可能在帮倒忙

一个看似合理的直觉:用一个LLM评审员监控Agent运行,预测到要失败就主动干预,应该能提高成功率吧?这篇论文给出了一个反直觉的答案——不一定,甚至可能更糟。研究者训练了一个离线准确率很高的二元评审器(AUROC 0.94),但部署后发现它对一个模型造成了26个百分点的性能崩塌,对另一个模型几乎没影响。原因是存在一个干扰-恢复权衡:介入确实能挽救部分注定失败的轨迹,但也会打断那些「虽然看起来不太对但最终会成功」的轨迹。团队提出了一个实用建议:部署前先用50个任务做小规模pilot test来判断介入到底是帮忙还是添乱。

原文:Accurate Failure Prediction in Agents Does Not Imply Effective Failure Prevention

也值得关注

今日观察

今天有一个非常清晰的技术趋势:KV cache压缩正在从单点优化走向系统性方案。FASA从RoPE频率结构切入、HySparse从架构层面做全注意力-稀疏混合、Quant VideoGen从量化角度攻视频生成场景——三篇论文从不同维度在解同一个问题,且方法之间理论上可以叠加。另一个值得注意的方向是SWE Agent训练的基础设施降本:SWE-World证明了用模拟器替代Docker是可行的,这可能会显著加速开源SWE Agent的迭代速度。做推理部署的团队建议关注FASA和HySparse的组合潜力;做代码Agent的团队建议关注SWE-World的模拟器思路。