今日概览

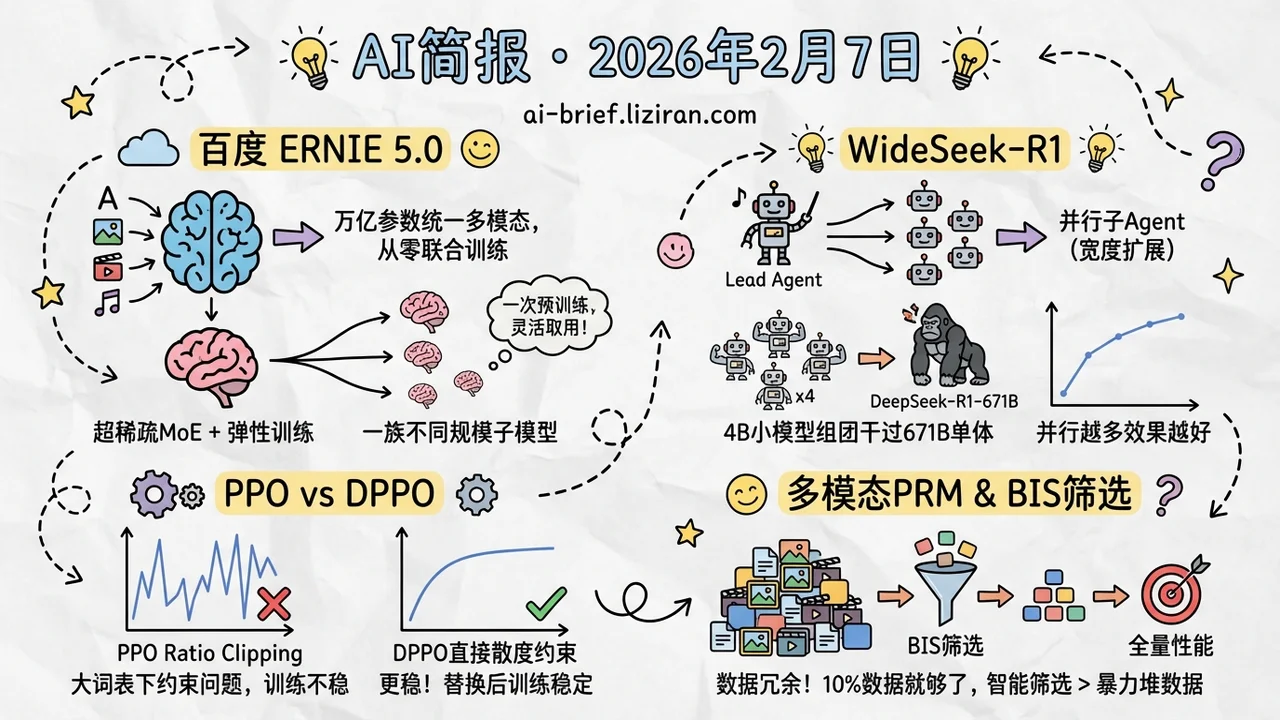

- 百度发布万亿参数统一多模态模型ERNIE 5.0,文本、图像、视频、音频从零开始联合训练,超稀疏MoE架构加弹性训练,一次预训练产出一族不同规模的子模型

- 多Agent强化学习做「宽度扩展」,4B小模型组团干过671B单体。WideSeek-R1并行子Agent越多效果越好,信息检索任务上4B集群匹敌DeepSeek-R1

- PPO的核心机制不适合LLM:DPPO指出ratio clipping在大词表下系统性地过度约束低概率token、放任高概率token漂移,用直接散度约束替换后训练更稳

- 多模态PRM训练数据存在大量冗余,10%的数据就够了。BIS筛选策略只用十分之一数据就达到全量性能

重点关注

01 多模态 百度的万亿参数野心:一次训练,一族模型

「统一多模态」这个词已经喊了好几年,但真正把文本、图像、视频、音频全部用同一个自回归目标从零训练的万亿参数模型,公开报告的这是第一个。ERNIE 5.0的技术选择很值得关注:用超稀疏MoE(mixture-of-experts)架构配模态无关的专家路由——不管输入是文字还是视频帧,走的都是同一套路由逻辑,让模型自己学哪个专家擅长处理什么。更实用的是它的弹性训练范式:在单次预训练过程中,模型同时学习不同深度、不同专家容量、不同稀疏度的子模型,部署时可以按资源约束灵活取用,不需要针对每个场景单独训练。这本质上是在回答一个工程问题——万亿参数模型训出来了,怎么让不同硬件条件的团队都能用?

02 Agent 模型不够大?那就多派几个

深度学习的主旋律一直是「深度扩展」——把单个模型做得更深更强。但当任务本身就很「宽」——比如需要同时搜集多个维度的信息——单Agent的瓶颈不在个体能力,而在组织效率。WideSeek-R1提出了一个互补的扩展维度:宽度扩展。用一个lead agent做任务拆分和编排,多个子Agent并行执行信息检索,全部通过多Agent强化学习(MARL)联合优化。结果很惊人:WideSeek-R1-4B在WideSearch基准上达到40.0% item F1,和单体DeepSeek-R1-671B相当——参数量差了167倍。而且性能随着并行子Agent数量增加持续提升,说明宽度扩展确实有scaling law的味道。

03 训练优化 PPO的信任域机制对LLM来说从根上就不对

PPO是LLM强化学习的事实标准,但这篇论文指出了一个结构性问题:PPO用来约束策略更新的ratio clipping在大词表场景下是病态的。问题出在概率比(probability ratio)是单token的采样估计,不是真实的策略散度——低概率token的比值波动很大,被裁剪过度约束(学不到东西);高概率token的比值变化很小,裁剪管不住(可能发生灾难性漂移)。DPPO的解法很直接:不用启发式裁剪,改为直接估计策略散度(Total Variation或KL散度),并提出了Binary和Top-K两种近似方法来控制显存开销。实验显示训练稳定性和效率都优于现有方法。

原文:Rethinking the Trust Region in LLM Reinforcement Learning

04 训练优化 你的过程奖励模型训练数据可能有90%是浪费

训练多模态过程奖励模型(PRM)通常需要大规模Monte Carlo标注语料,成本不低。但这篇论文发现了一个好消息:绝大部分训练数据是冗余的。随机子采样很快就饱和,说明有效信息集中在少数样本中。作者从理论上分析了什么样的数据点最有信息量——关键看两个因素:正负标签的混合比例和标签可靠性(正样本的平均MC得分)。基于这两个指标,提出的BIS(Balanced-Information Score)筛选策略在InternVL2.5-8B和Qwen2.5-VL-7B两个骨干上验证:只用10%的数据就达到甚至超过全量训练的效果。

原文:Training Data Efficiency in Multimodal Process Reward Models

也值得关注

今日观察

今天有两个值得注意的信号。第一,统一多模态模型的竞争进入万亿参数阶段:ERNIE 5.0是第一个公开报告的万亿参数统一自回归多模态模型,OmniSIFT则在解决这类模型的推理成本问题——训和用两端同时在推进。第二,「小模型组团」正在成为和「大模型单打」并行的范式:WideSeek-R1的宽度扩展、π-Distill的特权信息蒸馏、Interfaze的异构小模型栈,从不同角度在证明不一定非要用最大的模型。做多模态部署的团队建议关注OmniSIFT的token压缩方案;做Agent系统的团队值得研究WideSeek-R1的多Agent MARL训练框架。