今日概览

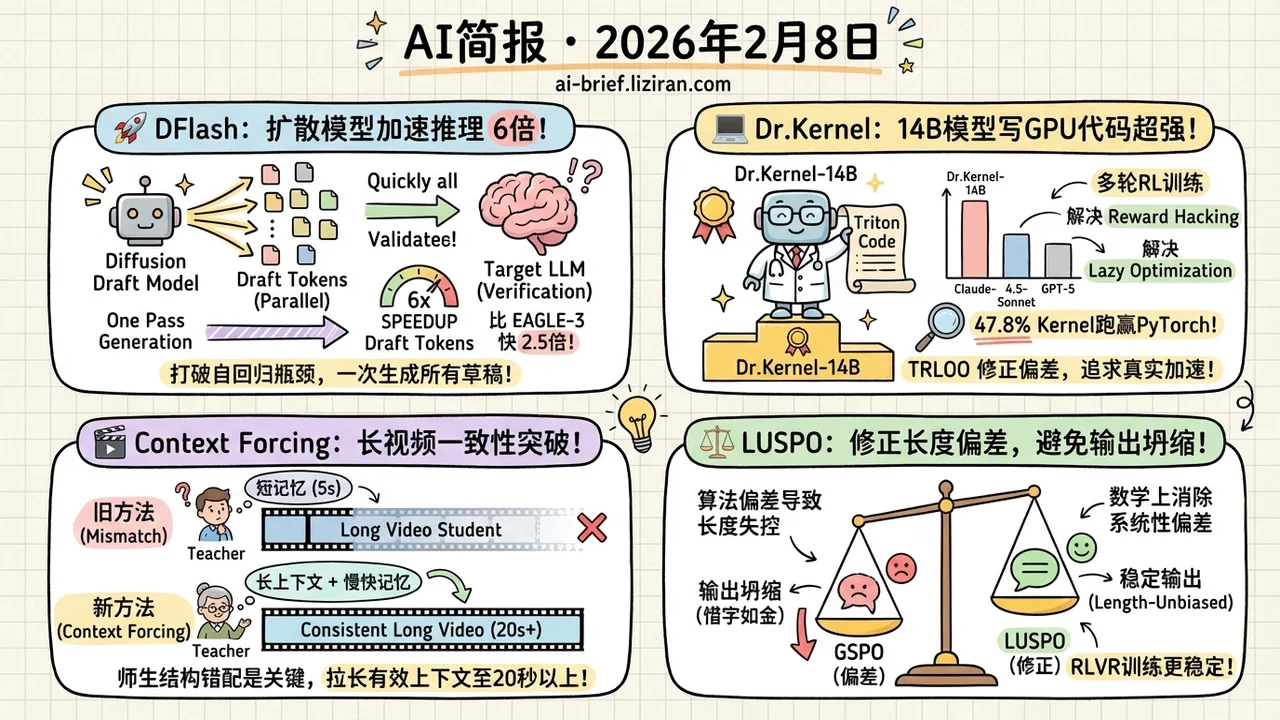

- 用扩散模型做投机解码,推理加速6倍,DFlash让轻量级block diffusion模型一次前向pass生成全部草稿token,比EAGLE-3再快2.5倍

- 多轮RL训练Triton代码生成,14B模型写GPU kernel超过Claude-4.5-Sonnet。Dr.Kernel解决了reward hacking和lazy optimization两大难题,47.8%的kernel跑赢PyTorch参考实现

- 长视频生成的一致性瓶颈被找到了:Context Forcing指出问题在「短记忆老师教长记忆学生」的结构错配,用长上下文师生+慢快记忆把有效上下文拉到20秒以上

- RLVR训练中模型越练越惜字如金,根源不是模型行为而是算法偏差。LUSPO修正GSPO的长度偏差后避免了输出坍缩

重点关注

01 推理加速 投机解码的草稿模型终于不用自回归了

投机解码(speculative decoding)的核心思路是「小模型打草稿、大模型验收」,但有个尴尬的瓶颈:草稿模型自己也是自回归的,还是得一个token一个token地生成。DFlash的解法很直觉——用扩散模型做草稿。一个轻量级的block diffusion模型在单次前向传播中并行生成所有草稿token,再由目标LLM并行验证。关键技巧是让草稿模型直接利用目标模型已经算好的上下文特征做条件输入,这样草稿质量更高,验收通过率也更高。结果是6倍无损加速,比当前最强的EAGLE-3还快2.5倍。

原文:DFlash: Block Diffusion for Flash Speculative Decoding

02 代码智能 14B模型写GPU kernel,凭什么超过Claude-4.5-Sonnet?

用LLM生成高性能GPU kernel(如Triton代码)听起来很美好,但训练时有两个坑:一是模型会reward hacking——找到捷径拿高分但kernel实际没变快;二是lazy optimization——模型只保证代码能跑,不追求真正的加速。Dr.Kernel为此构建了一套完整的基础设施。首先是KernelGYM,一个支持多轮交互的分布式GPU训练环境,能检测reward hacking。然后发现GRPO在多轮设定下存在自包含偏差,提出了TRLOO做无偏advantage估计。再用profiling数据构建奖励信号,逼模型追求真实加速而非表面正确。最终Dr.Kernel-14B在KernelBench上匹敌Claude-4.5-Sonnet,多轮测试时47.8%的kernel达到1.2倍以上加速,超过GPT-5的28.6%。

原文:Dr. Kernel: Reinforcement Learning Done Right for Triton Kernel Generations

03 视频生成 长视频为什么前后矛盾?老师自己就没记忆

实时长视频生成是当前最热的方向之一,但现有方案普遍有一致性问题——生成30秒以上的视频就开始「遗忘」前面的内容。Context Forcing找到了结构性原因:主流的streaming tuning框架让长上下文学生跟着短上下文(5秒窗口)老师学,老师自己都看不到完整历史,怎么可能教学生维持全局一致?修复方案很直觉:让老师也看到完整生成历史。为了让这在2分钟级别的视频上计算可行,引入了慢快记忆架构——把线性增长的视觉上下文压缩成两个速率的记忆流,大幅减少冗余。结果是有效上下文从现有方法的2-10秒拉到20秒以上,一致性指标全面超越LongLive和Infinite-RoPE等方案。

原文:Context Forcing: Consistent Autoregressive Video Generation with Long Context

04 训练优化 模型输出越练越短,不是它在「思考」,是算法有偏差

用可验证奖励做RL训练(RLVR)时,一个常见现象是模型输出长度在训练过程中剧烈变化——有的算法让模型越说越多,有的让它越来越惜字如金直到「输出坍缩」。这到底是模型在学习高效推理,还是算法的副作用?LUSPO从理论上拆解了主流RLVR算法中影响输出长度的因子,发现GSPO的损失函数对输出长度有系统性偏差——长回答和短回答对梯度的贡献不等,导致训练过程中长度不可控。修正方法是让序列级策略优化的损失函数对长度无偏(length-unbiased),从数学上消除这个偏差。在数学推理和多模态推理任务上,LUSPO持续优于GRPO和GSPO。

也值得关注

今日观察

今天最突出的信号是RL训练的工程细节正在成为性能瓶颈:LUSPO揭示了GSPO的长度偏差,Dr.Kernel修正了GRPO的多轮自包含偏差,EBPO修补了GRPO的baseline方差问题,DPPO(昨天的论文)重新审视了PPO的ratio clipping——四篇论文从不同角度指出「标准RL算法直接用到LLM上是有问题的」。做RL训练的团队建议系统性地审视当前训练流程中的偏差来源,特别是长度偏差和advantage估计这两个方向。