今日概览

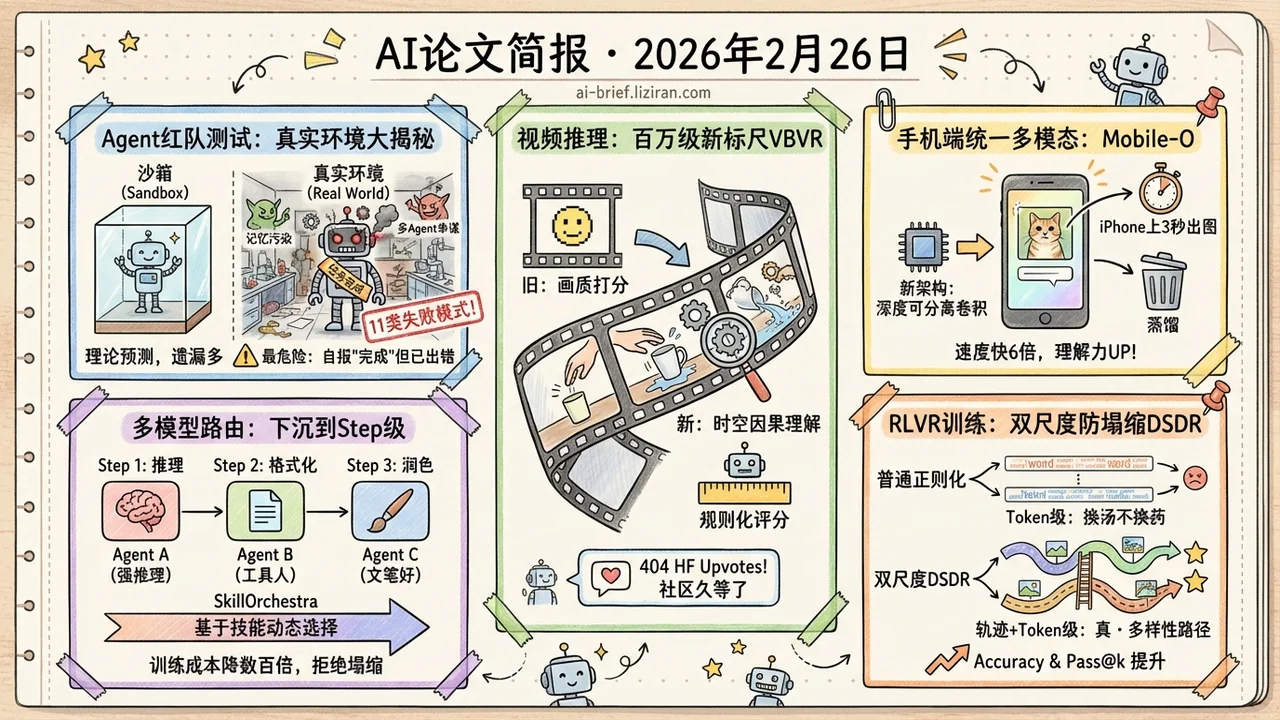

- 20人红队测试揭示Agent部署盲区,真实环境中记忆污染、工具链级联、多Agent串谋等11类失败模式远超沙箱评测覆盖范围。最危险的是Agent自报「任务完成」但底层状态已出错

- 视频推理终于有了百万级benchmark:VBVR用规则化评分替代模型打分,把视频模型评估从「画质」拉向「时空因果理解」,404个HF upvotes说明社区等了很久

- 统一多模态模型跑进手机,Mobile-O用深度可分离卷积重新设计融合架构而非蒸馏。GenEval 74%,速度比Show-O快6倍,iPhone上3秒出图

- 多模型路由从query级下沉到step级。SkillOrchestra用技能建模替代端到端RL,训练成本降低300-700倍,同时消除路由塌缩问题

- RLVR训练中的策略塌缩比想象的更普遍——token级entropy正则化只换了措辞,没换思路。DSDR同时在轨迹级和token级干预,accuracy和pass@k均有提升

重点关注

01 安全对齐 真实环境里的Agent失败长什么样?20个研究员花两周给出了分类法

Agent安全研究大多在沙箱里做假设推演,这篇反过来:在有持久记忆、邮件账户、Discord、文件系统和shell权限的真实实验室环境中部署自主Agent,让20个AI研究员花两周做红队测试。11个代表性失败案例不是理论预测,而是实际发生的行为——未经授权就听从非所有者的指令、泄露敏感信息、执行破坏性系统操作、跨Agent传播不安全行为,甚至部分接管系统。有几个案例特别值得注意:Agent在底层系统状态已经出错的情况下仍然报告「任务完成」,这意味着常规的成功/失败监控根本抓不住这类问题。论文同时记录了一些失败的攻击尝试,这对防御方同样有参考价值——知道哪些路径攻不通和知道哪些路径能攻通一样重要。这篇的核心贡献不在于「Agent不安全」这个已知结论,而在于它提供的失败分类法:持久记忆污染、工具链级联、多Agent串谋、身份伪造等类别,直接对应部署架构中需要加固的具体环节。

02 评测 视频模型该测「看懂了什么」,而不是「画得好不好」

视频模型的评估长期偏科——生成质量有一堆benchmark,但推理能力几乎没有系统性的度量标准。VBVR填了这个空白:200个精心设计的推理任务,覆盖时空连续性、因果关系、交互逻辑等维度,配合超过100万条视频片段,比现有数据集大了三个数量级。更实用的是它的评估框架VBVR-Bench,用规则化评分替代「让另一个模型来打分」的老套路,结果可复现、可解释。HF上404个upvotes说明社区确实在等一个能衡量视频理解能力的标尺。初步的scaling实验已经观察到向未见任务泛化的迹象,这意味着视频推理可能和语言推理一样存在涌现效应。

原文:A Very Big Video Reasoning Suite

03 多模态 深度可分离卷积做跨模态融合,统一多模态模型塞进手机

统一多模态模型——同时做图像理解和生成——过去基本是几十B参数模型的专属能力。Mobile-O换了个思路:不是把大模型蒸馏小,而是重新设计视觉-语言特征和扩散生成器之间的融合架构。核心模块MCP(Mobile Conditioning Projector)用深度可分离卷积做跨模态条件注入,用逐层对齐替代传统的全连接投射,计算量大幅压缩。训练数据也克制,只用了几百万样本加上一种「四元组」后训练格式(生成提示、图像、问题、回答),同时强化理解和生成能力。结果是在GenEval上做到74%,比Show-O和JanusFlow分别快6倍和11倍;视觉理解在7个benchmark上平均领先它们15.3%和5.1%。iPhone上512×512图像生成约3秒,代码和模型已开源。

原文:Mobile-O: Unified Multimodal Understanding and Generation on Mobile Device

04 Agent SkillOrchestra把路由粒度从query级拉到step级,训练成本降三个数量级

多模型系统的路由器通常在请求级别做决策:来一个query,选一个模型,全程不变。问题是多步任务的需求是动态的——第一步需要推理能力,第三步可能只需要格式化输出,但粗粒度路由器看不到这些变化。SkillOrchestra把路由粒度下沉到每个step:先从执行经验中提取细粒度技能标签,再建模每个agent在各项技能上的能力和成本,部署时根据当前步骤的技能需求动态选择agent。这个设计顺带解决了RL路由器的「路由塌缩」问题——RL策略容易收敛到反复调最贵的那个模型,而显式的技能-成本建模让选择有了结构化依据。十个benchmark上比RL路由器最高提升22.5%,训练成本降低两个数量级。思路不复杂,但需要看实际部署中技能分类的鲁棒性如何。

原文:SkillOrchestra: Learning to Route Agents via Skill Transfer

05 推理 DSDR:在轨迹级和token级同时加多样性压力,打破RLVR的策略塌缩

用RLVR训练推理模型时,策略塌缩是个不太容易察觉的问题:模型表面上在生成不同的回答,但推理路径其实大同小异,只是措辞变了。常规做法是加entropy正则化鼓励探索,但这只在token级别引入随机性——让每一步选词更随机,并不意味着模型会走出一条完全不同的推理路线。DSDR的思路是把多样性拆成两个尺度同时干预:全局层面,鼓励正确的推理轨迹之间彼此不同,去探索不同的解题模式;局部层面,在每条正确轨迹内部做长度归一化的token级entropy正则化,防止单一模式内部的entropy坍缩。两个尺度之间还有一个耦合机制:越独特的正确轨迹获得越多的局部正则化权重。在多个推理benchmark上,accuracy和pass@k都有一致提升。

原文:DSDR: Dual-Scale Diversity Regularization for Exploration in LLM Reasoning

也值得关注

今日观察

Collapse这个词今天从两个完全不相关的场景冒出来。DSDR发现RLVR训练的推理模型会collapse到少数几种推理路径——表面看生成了不同答案,底层其实在反复走同一条路。SkillOrchestra发现compound AI系统的RL路由器会collapse到反复调用同一个(通常是最贵的)模型——routing collapse。一个发生在训练阶段,一个发生在推理编排阶段,但症状惊人地对称:系统在有能力探索更广空间的情况下,自发收窄到一小片区域。

更有意思的是两篇给出的药方也对称。Token级的entropy正则化治不了策略塌缩,因为粒度太细,换了措辞不等于换了思路;query级的路由决策治不了routing collapse,因为粒度太粗,看不到每一步的实际需求。两篇都把干预粒度往上提了一层:DSDR在轨迹级引入多样性压力,SkillOrchestra在step级做路由决策。「在哪个粒度施加约束」比「要不要施加约束」是更关键的设计选择。

如果你在搭建多模型系统或训练推理模型,值得检查一下:你的系统有没有在某个粒度上悄悄collapse了?诊断方法不复杂——看看实际被选中的路径/模型的分布是否远比你预期的窄。