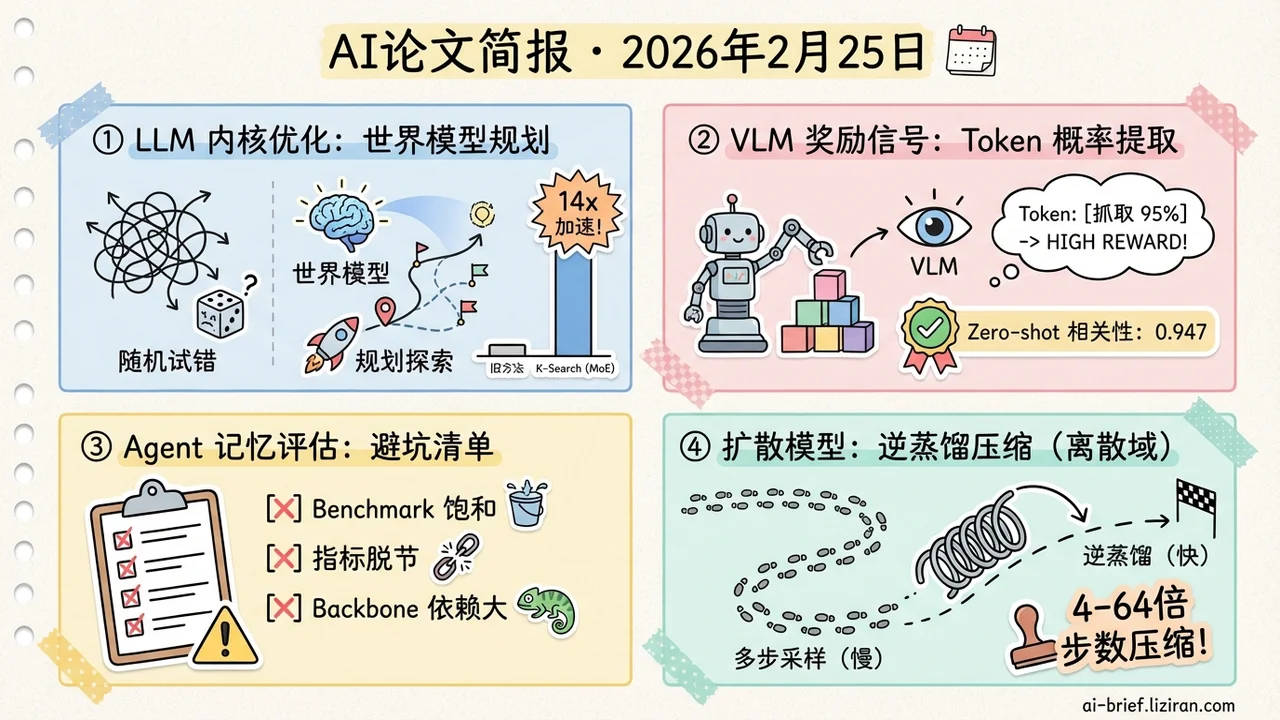

今日概览

- LLM内部构建kernel行为的「世界模型」来规划优化路径,MoE等复杂kernel上比进化搜索快14倍,把算子调优从随机试错变成有规划的探索

- VLM的token概率直接提取reward信号:预训练模型的logits里编码了任务进展信息,130+真实机器人任务上zero-shot相关性达0.947

- Agent记忆系统的评估体系存在结构性缺陷,benchmark饱和、指标与语义效用脱节、换backbone结论就变。对搭建agent系统的团队来说是一份避坑清单

- 扩散语言模型的逆蒸馏从连续域搬到离散域,解决了唯一性和梯度稳定两个新问题,实现4到64倍步数压缩

重点关注

01 代码智能 让LLM先「想明白」再改kernel,比盲目搜索快14倍

现有的LLM kernel优化方法基本是把模型当随机代码生成器——在进化搜索循环里不断变异、筛选,碰上需要多步协调修改的复杂kernel就容易卡住,因为中间步骤可能暂时变差,搜索就把这条路丢掉了。K-Search的核心洞察是把高层算法规划和底层代码实现拆开:LLM内部维护一个kernel行为的「世界模型」,先在策略层面想清楚优化路径,再去写具体实现。这个世界模型和搜索过程协同进化——每次实际执行的反馈会更新模型的认知,让后续规划更准确。实际效果上,在FlashInfer的GQA、MLA和MoE等复杂kernel上,K-Search平均比现有最好的进化搜索快2.1倍,MoE kernel上最高达到14.3倍。在GPUMode的TriMul任务上,K-Search在H100上跑到1030μs,超过了此前的进化搜索和人工方案。这个「先规划再实现」的思路对做ML infra的团队有直接参考价值——算子调优不一定要靠暴力搜索,让模型学会推理优化路径本身可能是更高效的方向。

原文:K-Search: LLM Kernel Generation via Co-Evolving Intrinsic World Model

02 机器人 预训练模型的隐藏宝藏:token概率本身就是奖励信号?

强化学习训练机器人有个经典难题:reward太稀疏,模型做了一堆动作,直到最后才知道成功还是失败。传统做法是训练一个专门的reward model来提供中间反馈,但这又引入了泛化性问题——换个任务换个机器人就不好使了。TOPReward的思路让人眼前一亮:直接从预训练VLM(视觉语言模型)的token输出概率中提取任务进展信号,不需要任何额外训练。关键洞察是,VLM在预训练阶段已经学到了「事情进行到哪一步」的世界知识,这些信息编码在token的logits里,只是之前没人去挖。在130多个真实机器人任务上zero-shot测试,TOPReward达到0.947的进度相关性,而之前最好的方法GVL在同一个开源模型上几乎是零相关——差距不是一点半点。这个发现的意义可能超出机器人领域:预训练模型的内部信号远比我们目前利用的要丰富得多。

原文:TOPReward: Token Probabilities as Hidden Zero-Shot Rewards for Robotics

03 Agent Agent记忆系统的评估体系,可能从根上就不对

搭建过agent系统的团队大概都经历过这种困惑:记忆模块在benchmark上跑分不错,上线后却感觉不到明显收益,甚至不确定它到底有没有在起作用。这篇survey提供了一个解释——问题可能不在你的方案,而在评估体系本身。作者系统拆解了当前Agent记忆系统的评估方法,发现几个结构性问题:benchmark规模不足导致饱和效应,评估指标与实际语义效用脱节,同一套记忆方案换个backbone模型表现差异巨大。作者将记忆架构归纳为四种结构,并逐一分析了每种结构在延迟和吞吐上的系统开销——这些成本在多数论文中被直接忽略了。这不是一篇提出新方案的论文,而是一份帮你重新审视「我的记忆模块到底有没有用」的检查清单。

原文:Anatomy of Agentic Memory: Taxonomy and Empirical Analysis of Evaluation and System Limitations

04 推理加速 逆蒸馏搬进离散空间,扩散语言模型向实用迈了一步

扩散模型(Diffusion Model)在文本生成上已经展现出不错的效果,但有个绕不开的问题:多步采样让推理速度远慢于自回归模型,实际部署很难接受。IDLM把连续扩散中已有的逆蒸馏(Inverse Distillation)技术搬到离散文本域,但这一步并不简单——离散空间里反向传播不稳定,而且逆蒸馏的目标函数在离散情况下缺乏唯一性保证,容易收敛到次优解。他们给出了唯一解的理论证明,并引入梯度稳定的松弛方法来解决训练不稳定问题。最终在多个扩散语言模型上实现了4到64倍的步数压缩,同时保持了生成质量。这类工作对扩散语言模型能否真正走出实验室至关重要——生成质量再好,推理成本不降下来就没法用。

也值得关注

今日观察

我们习惯把大模型当黑箱用:喂入输入,拿走输出,中间发生了什么无所谓。但模型在生成输出的过程中产生的「副产品」——概率分布的形状、内部的状态表征——本身就携带着大量可利用的信息,只是一直被丢掉了。

TOPReward展示了一个很直接的例子:VLM的token概率分布里直接编码了任务进展信息,把它当reward用,不需要额外训练reward model,在130+真实机器人任务上zero-shot相关性达到0.947。K-Search则从另一个角度利用了模型内部信号——让LLM构建关于kernel行为的世界模型,用这个内部认知来规划搜索方向而非盲目变异。两个工作的共同点在于:它们都没有从外部引入新的监督信号(人工标注的reward函数、手工设计的benchmark),而是从模型在预训练阶段已经积累的知识中提取出可利用的结构。

这背后的逻辑很直觉——一个在海量数据上训练过的大模型,它的参数里沉淀的远不止「给定输入预测输出」这一件事。概率分布的形状、中间层的激活模式、不同token之间的相对置信度,这些「副产品」都携带着模型对世界的理解,只是传统pipeline只用了最终输出这一层。

当外部标注的边际成本越来越高,而预训练模型的能力越来越强,从模型内部挖掘信号的性价比会持续上升。如果你在搭建需要reward signal或评估函数的系统,值得花时间看看你使用的基础模型里有没有现成的、还没被利用的内部信号——可能比从头训一个专用模块更省事、泛化性也更好。