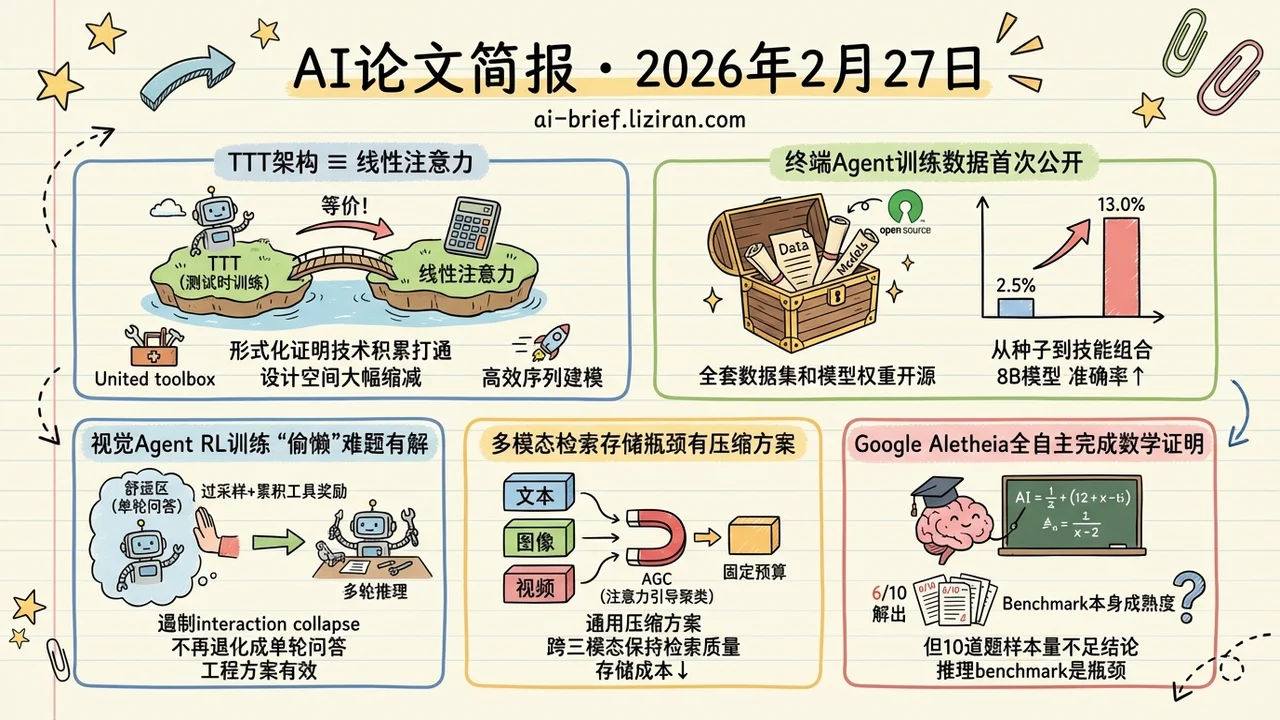

今日概览

- TTT架构被证明等价于线性注意力算子,NVIDIA团队的形式化证明将两个独立研究社区的技术积累打通,高效序列建模的设计空间大幅缩减

- 终端Agent的训练数据工程首次系统公开:从种子任务生成到技能组合、训练策略对比,全套数据集和模型权重开源。8B模型准确率从2.5%跳到13.0%

- RL训练视觉Agent的「偷懒」难题有了工程方案,过采样+累积工具奖励的组合有效遏制interaction collapse,模型不再退化成单轮问答

- 多模态检索的存储瓶颈迎来通用压缩方案。注意力引导聚类将文档向量压到固定预算内,跨文本、图像、视频三种模态均保持检索质量

- Google Aletheia全自主完成数学证明挑战,但10道题的样本量远不够下结论——数学推理benchmark本身的成熟度可能是更大的瓶颈

重点关注

01 模型架构 两条研究路线撞到了一起:TTT和线性注意力本就是同一件事

TTT(测试时训练)这几年被包装成「模型在推理时自我学习」的新范式,和线性注意力分属两个独立的研究社区,各自发论文、各自刷榜。NVIDIA团队这篇工作做了一件让人意外的事:他们证明了一大类TTT架构——包括用KV绑定做序列建模的那些——在数学上可以严格表示为一种可学习的线性注意力算子。不是「类似」,不是「可以类比」,是形式化等价。这个发现解释了之前一些让人困惑的实验现象:TTT模型的行为和记忆假说对不上,因为它根本就不是在做记忆,而是在做注意力。更实际的收益是,既然两者等价,线性注意力社区积累的并行化技巧和架构简化方法可以直接迁移过来——论文展示了完全并行的TTT公式,性能不降但效率提升。对做高效架构的团队来说,这意味着设计空间大幅缩减:与其在两条路线上分别探索,不如在统一框架下做选择。

原文:Test-Time Training with KV Binding Is Secretly Linear Attention

02 代码智能 终端Agent训练数据的「黑箱」终于被打开了

Terminal agent进步很快,但怎么训的、数据哪来的,几乎没人说。NVIDIA这篇直接把数据工程摊开讲:Terminal-Task-Gen是一个轻量级的合成任务生成pipeline,支持从种子任务扩展和按技能组合两种构造方式,产出的Terminal-Corpus是目前最大的开源终端任务数据集。更有价值的是训练策略的系统对比——过滤、课程学习、长上下文训练、scaling行为,每个环节都给了实验结论。基于Qwen3微调的Nemotron-Terminal系列效果很能说明问题:8B模型从2.5%跳到13.0%,32B从3.4%到27.4%,直接追平更大规模的模型。82个HF upvotes反映的不只是论文质量,更是社区对这个领域透明度的渴望——终于有人把terminal agent的数据配方公开了。

原文:On Data Engineering for Scaling LLM Terminal Capabilities

03 Agent RL训练多模态Agent,最大的敌人是模型自己「偷懒」

用RL训练视觉Agent时有个反直觉的现象:模型训着训着不调工具了,多轮推理退化成单轮问答——研究者称之为interaction collapse。PyVision-RL针对这个问题给出了一套工程化组合拳:用过采样-过滤-排序的rollout策略保证训练样本质量,再用累积工具奖励(每次正确调用工具都给正反馈)来抵消模型「少做少错」的倾向。在视频理解场景还加了按需帧采样,推理时只提取任务相关帧,大幅减少视觉token开销。整套方案基于开源权重模型,图像和视频各训了一个版本,效果和效率都有明显提升。

原文:PyVision-RL: Forging Open Agentic Vision Models via RL

04 检索 Late interaction向量压到固定预算,多模态检索的存储难题有了通解

Late interaction(延迟交互)检索在文本、图像、视频上效果都不错,但代价是每个文档要存一整组向量,存储和计算成本随文档长度线性增长。文本还好,到了图像和视频这种动辄成百上千token的模态,索引膨胀就成了实际部署的硬伤。这篇工作的思路是把多向量文档表示压缩到固定数量的向量内,且不依赖具体模态。四种压缩方案中,注意力引导聚类(AGC)表现最稳——它用注意力权重找出文档中语义最关键的区域作为聚类中心,再加权聚合周围token。在文本(BEIR)、视觉文档(ViDoRe)和视频(MSR-VTT)三类任务上,AGC在压缩后的检索质量接近甚至超过未压缩的全索引。

原文:Multi-Vector Index Compression in Any Modality

05 推理 数学竞赛的AI对手来了,但10道题能说明什么?

数学证明一直是AI最难啃的骨头——不是计算难,而是需要真正的创造性推理和逻辑构建。Google的Aletheia(基于Gemini 3 Deep Think)参加了首届FirstProof数学挑战赛,全程自主运作,没有人工干预,这本身就是个值得注意的信号。但冷静看数字:总共10道题,解出6道,专家对其中1道的判定还有分歧。10道题的样本量,连统计显著性的边都摸不到,更像是一次公开的能力演示而非严格评估。Google把原始prompt和输出全部开源了,这种透明度值得肯定,但也恰恰说明他们清楚这不是一个可以拍胸脯的结论。真正的问题不是「AI能不能做数学」,而是我们还缺少一套足够大、足够难、评判标准足够一致的benchmark来回答这个问题。

也值得关注

今日观察

今天有个值得展开讲的现象:我们对神经网络架构的理解,经常停留在「它应该在做什么」的叙事层面,而不是「它实际在做什么」的机制层面。

TTT那篇论文是个典型案例。TTT社区一直用「测试时在线学习」来解释模型行为——推理时持续更新内部状态,像是在积累短期记忆。这个叙事很直觉,也很好发论文。但NVIDIA的形式化分析证明,这些模型实际执行的运算就是线性注意力。不是「像」,是数学等价。之前那些对不上号的实验结果——模型行为和记忆假说矛盾——突然就有了解释。

蛋白质语言模型那篇揭示了类似的错位。大家把NLP领域的Transformer搬到蛋白质序列上,默认注意力机制的工作方式应该差不多。但实际分析发现,PLM学出的注意力模式和NLP Transformer有系统性差异——同一个架构,在不同数据域里发展出了不同的计算策略。

这两个案例指向同一个实际教训:架构迁移时,我们习惯性地把源领域的解释一并搬过来,但模型并不关心你的叙事。它会在新数据上找到自己的最优策略,而这个策略可能和你的直觉完全不同。更关键的是,两篇论文都展示了「正确理解机制」的工程回报——TTT那篇直接给出了可并行化的等价公式,蛋白质那篇据此改进了推理效率。误解机制不只是学术层面的遗憾,它直接导致你错过了本可以拿到的优化空间。

给从业者的建议: 当你把一个架构或方法从一个领域迁移到另一个时,花时间做机制层面的验证——probe中间表示,比较注意力分布,检查和源领域的假设是否真的成立。这比盲目调参的ROI高得多。