今日概览

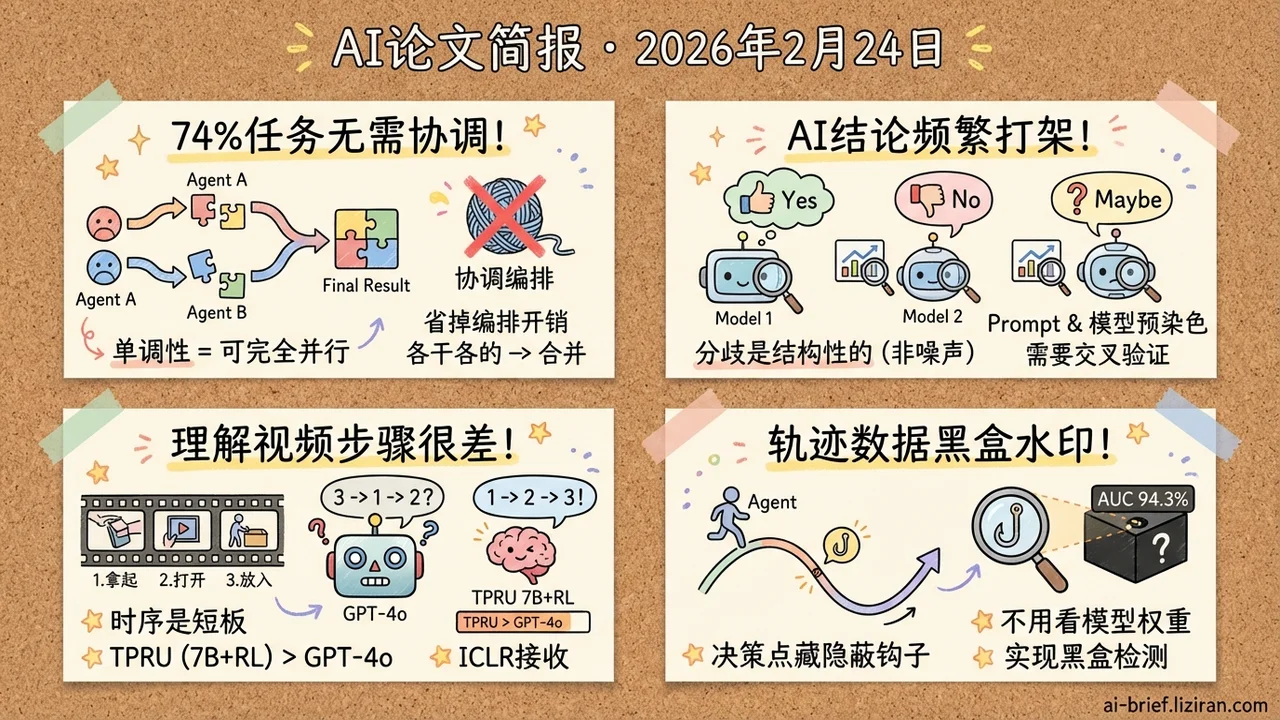

- 企业工作流中74%的任务不需要agent间协调,单调性分析提供了形式化判据:子结果合并不会变差的任务可以完全并行,省掉全部编排开销。

- 多个AI分析师对同一数据的结论频繁矛盾——分歧不是噪声而是结构性的,prompt措辞和模型选择已经预先给结论染了色。

- 多模态模型理解视频内容没问题,但理解步骤顺序准确率骤降。TPRU用RL微调7B模型在时序任务上超过GPT-4o,ICLR接收。

- Agent轨迹数据有了黑盒水印方案,在决策点嵌入隐蔽钩子动作,检测AUC达94.3,不需要访问模型权重。

重点关注

01 Agent 你的multi-agent系统里,可能有一半的协调是白费的

Multi-agent系统的协调开销经常比任务本身还贵——这不是夸张,是可测量的事实。但问题不在于「怎么协调更高效」,而在于「这个任务到底需不需要协调」。这篇论文从分布式系统理论里借了一个精确判据:单调性。如果一个任务是单调的——也就是说新信息只会补充结论、不会推翻之前的结果——那agents完全可以各干各的,最后合并就行,不需要任何中间同步。研究团队分析了65个企业工作流,发现74%满足单调性条件;在O*NET数据库的13417个职业任务上复现,42%是单调的。换算下来,24%到57%的协调开销是「为了正确性」根本不需要的。这个比例大到值得每个搭multi-agent pipeline的团队认真审视自己的编排层——你加的那些状态同步、顺序依赖、中间检查点,有多少其实可以直接砍掉?

原文:When Coordination Is Avoidable: A Monotonicity Analysis of Organizational Tasks

02 评测 同一份数据交给多个AI分析师,结论为什么会打架?

让不同LLM扮演独立数据分析师,对同一份数据集检验同一个假设——结果和人类「多分析师」研究一样令人不安:效应量、p值乃至「是否支持假设」的二元判断都出现大幅分散,频繁出现完全相反的结论。分歧不是随机噪声,而是结构性的:变量预处理、模型选型、推断方式上的隐式决策在每条分析路径上制造系统性分叉。更关键的是,这些分歧是可操控的——换一个persona提示词或换一个底层模型,结论分布就会整体偏移,即便剔除了方法论不合格的分析也是如此。对正在用AI agent做数据驱动决策的团队来说,这意味着「让AI分析一下」得到的单次结论,其实已经被prompt措辞和模型选择预先染色了,但这个偏置很难从结果本身看出来。

原文:Many AI Analysts, One Dataset: Navigating the Agentic Data Science Multiverse

03 机器人 多模态模型能看懂视频,但看不懂「步骤」——这个差距有多大?

多模态模型理解静态画面已经不错,但让它看一段机器人操作视频,说出「先拿起杯子、再打开柜门、最后放进去」这样的时序和步骤关系,准确率就大幅下滑。这个能力缺口直接卡住了embodied AI的落地——无论是机器人操作还是GUI导航,都需要模型理解动作的先后顺序和因果关系。TPRU针对这个问题构建了大规模时序数据集,覆盖机器人操作、日常活动等场景,设计了三类任务:时序重排、下一帧预测、前帧回溯。关键设计是引入了高质量负样本,逼模型从「被动看」转向「主动验证」。用RL微调7B模型后,准确率从50%跳到76%,超过了GPT-4o等大得多的模型,且泛化到外部benchmark依然有效。

原文:TPRU: Advancing Temporal and Procedural Understanding in Large Multimodal Models

04 安全对齐 Agent轨迹数据的版权保护,终于有了可用方案

一条高质量的agent轨迹数据背后是任务设计、强模型生成、人工筛选的层层投入,成本不低。但目前这类数据集几乎没有版权保护手段——被复制、被蒸馏,创建者很难追溯。ActHook借鉴了软件工程中的hook机制,在agent的决策点插入隐蔽的「钩子动作」:只有特定密钥触发时才会激活,不影响正常任务执行。在水印数据上训练过的agent会以显著更高的概率产生这些钩子动作,从而实现黑盒检测——不需要访问模型权重,只看输出行为就能判断数据来源。在数学推理、网页搜索、软件工程三类agent任务上,检测AUC达到94.3,同时对原始性能几乎没有损耗。

原文:Watermarking LLM Agent Trajectories

也值得关注

今日观察

假设你正在设计一个multi-agent数据分析系统。按直觉,你会加一个协调层让agents共享中间结果、对齐分析口径,然后取最终共识作为输出。今天两篇论文分别拆掉了这个设计中两个看起来合理的默认选项。

协调可避免性那篇说:如果每个agent的子分析满足单调性——新数据只补充不推翻——那协调层是纯粹的开销浪费,各跑各的再合并效果一样。Analyst multiverse那篇说:就算你让agents各自独立分析了,也不能简单取「共识」——因为结论的分散不是噪声,是分析路径上隐式决策的系统性产物,多数投票不能消除结构性偏差。

这两个结论叠在一起,指向一个具体的工程启示:multi-agent系统里,「协调」和「聚合」是两个独立的设计决策,不应该绑定在一起。很多系统默认「协调→共识→输出」的线性流程,但更合理的做法可能是:先用单调性判据决定哪些子任务根本不需要协调,省掉编排成本;然后对需要聚合的结果,不取共识而是保留分歧——把多条分析路径的差异显式呈现给决策者,让人来判断哪些分歧是方法论噪音、哪些是真实的不确定性。再加上轨迹水印提供的数据溯源能力,每条分析路径的来源和可信度也有了锚点。

行动建议: 审视你现有的multi-agent pipeline,把协调层和聚合层拆开评估。对满足单调性的子任务直接砍掉协调;对聚合环节,把「取共识」替换为「呈现分歧分布」,让下游决策者看到完整的结论光谱而非一个可能误导的单点结论。