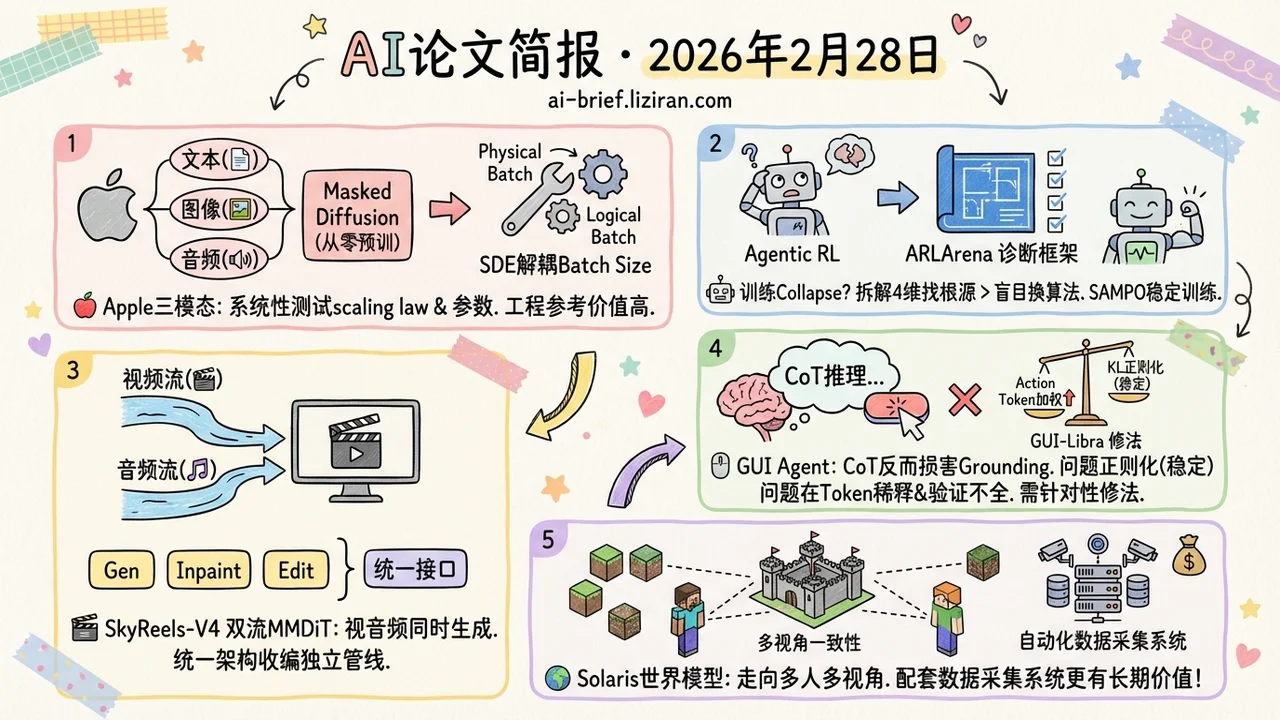

今日概览

- Apple从零预训三模态masked diffusion模型,系统性测试了scaling law、模态混合和噪声调度,对做多模态扩散的团队直接可参考。masked diffusion正在成为自回归之外的可选路线

- Agentic RL训练collapse有了系统性诊断框架:ARLArena把policy gradient拆成四个设计维度逐一消融,找到不稳定根源,比盲目换算法有效得多

- SkyReels-V4用双流MMDiT同时生成视频和音频,文生视频、inpainting、editing统一为单一接口。统一架构正在收编独立的模态pipeline

- GUI Agent加CoT推理反而损害grounding能力。GUI-Libra发现问题出在action token被稀释和step级验证不完整,给出了针对性修法

- 世界模型走向多人多视角,Solaris在Minecraft里实现多玩家一致性模拟。配套的自动化数据采集系统可能比模型本身更有长期价值

重点关注

01 模型架构 一个模型同时生成文字、图片和语音,masked diffusion能走多远?

Apple从零预训练了一个3B参数的三模态masked diffusion模型,同时处理文本、图像和音频——不是在已有语言模型上接模态,而是重新设计了整套预训练方案。这个方向本身就值得注意:masked diffusion(通过逐步「揭示」被遮蔽的token来生成内容)正在成为自回归之外的另一条技术路线,而Apple选择在这条路上做大规模系统性探索。团队在6.4T token上训练,系统性测试了多模态scaling law、模态混合比例、噪声调度和batch size效应,这些工程细节对做多模态扩散的团队直接可用。其中一个实用贡献是基于SDE的batch size重参数化方法,把「物理batch size」(受GPU显存限制)和「逻辑batch size」(影响梯度方差)解耦,省去了反复调优最佳batch size的麻烦。结果层面,文本生成、文生图和文生语音都达到了「能用」的水平,但这更多是一个设计空间的系统性探索,而非刷榜工作——论文标题里的「design space」说得很直白。对从业者来说,关键问题不是这个模型本身能不能用,而是masked diffusion作为统一多模态生成的技术路线,是否值得分配注意力去跟进。

原文:The Design Space of Tri-Modal Masked Diffusion Models

02 Agent 训练Agent的RL不缺算法,缺的是稳定性诊断

Agentic RL(用强化学习训练LLM Agent)的论文越来越多,但一个尴尬现实是:训练动不动就collapse,复现困难,调参全靠运气。ARLArena的思路不是提出又一个agent系统,而是先搞清楚训练为什么崩。他们把policy gradient拆成四个核心设计维度,在标准化测试床上逐一消融,找到了不稳定的主要来源。基于这些发现提出的SAMPO方法,在多种agent任务上实现了稳定训练。对做agent RL的团队来说,这套诊断框架可能比最终的算法更有价值——知道哪个维度出了问题,比盲目换算法有效得多。

原文:ARLArena: A Unified Framework for Stable Agentic Reinforcement Learning

03 视频生成 双流MMDiT把视频和音频塞进同一个生成器,独立pipeline还剩多少空间?

双流MMDiT(多模态扩散Transformer)架构是SkyReels-V4的核心设计:一个分支生成视频,一个分支生成时间对齐的音频,两个分支共享同一个多模态大语言模型作为文本编码器。这意味着视频和音频不再是「各做各的再拼一起」,而是从生成阶段就互相感知。更值得注意的是能力覆盖面——文生视频、图生视频、视频续写、inpainting、编辑,全部用channel拼接的统一接口实现,不再需要为每个任务维护独立pipeline。支持1080p、32FPS、15秒时长,效率上靠「低分辨率全序列+高分辨率关键帧」的联合生成策略来控制计算量。这是目前公开的能力最全面的视频基础模型之一,统一架构正在一步步把原来各管各的模态pipeline收编进来。

原文:SkyReels-V4: Multi-modal Video-Audio Generation, Inpainting and Editing model

04 Agent 给GUI Agent加CoT推理,效果反而变差?

训练GUI agent时有个违反直觉的现象:用SFT加上思维链推理,模型的grounding能力(准确点击/操作目标元素)反而下降。原因是推理token稀释了对动作和坐标的关注。另一个问题出在RL阶段——step级验证在GUI任务上天然不完整,同一个目标可能有多条合法操作路径,但训练时只有一条示范动作作为正确答案,导致离线指标和实际任务完成率脱节。GUI-Libra针对这两个问题给出了具体修法:SFT阶段混合「推理+动作」和「直接动作」两种数据,并对action token加权重;RL阶段引入KL正则化信任域来稳定部分可验证场景下的训练,再用成功率自适应缩放来降低不可靠负梯度的影响。这套方案在web和移动端benchmark上都提升了step准确率和端到端完成率,关键是不需要昂贵的在线数据采集。

05 多模态 世界模型走向多人视角,先要解决数据问题

Video world model(视频世界模型)发展到现在,有个基础假设一直没被挑战:只模拟一个agent的视角。但真实环境天然是多agent的——多个参与者同时行动,彼此的观察既独立又需要空间一致。Solaris在Minecraft里迈出了这一步,训练出能同时生成多玩家视角且保持一致性的视频世界模型。但比模型本身更值得关注的是配套基础设施:一套自动化的多玩家数据采集系统,能持续、同步地录制多个agent的视频和动作,积累了1264万帧多人游戏数据。训练采用分阶段策略,从单人逐步过渡到多人建模,并引入了Checkpointed Self Forcing来解决长时序训练的显存问题。

原文:Solaris: Building a Multiplayer Video World Model in Minecraft

也值得关注

今日观察

今天有三篇工作不约而同地在做同一件事:把原本分开处理的模态统一到一个架构里从零训练。Apple的三模态masked diffusion同时处理文本、图像和音频;SkyReels-V4用双流MMDiT联合生成视频和音频;VecGlypher用一个多模态语言模型直接输出SVG。

这和过去一年流行的「在已有模型上插adapter加模态」路线根本不同。那条路的逻辑是省成本——用一个冻结的backbone加轻量模块就能支持新模态。但现在越来越多团队愿意付从零预训练的代价来换真正的模态对齐,说明adapter路线的天花板可能已经被碰到了。Apple在论文里系统性测试了多模态scaling law,这本身就意味着他们在评估这条路能走多远——不是做一个demo,而是在认真规划技术路线。

值得追踪的关键问题:从零训练的统一架构在什么数据和计算规模上开始系统性超过「拼接式」方案?这个拐点直接决定了中小团队的技术选型——如果拐点在10B参数以下,adapter路线的性价比优势就会迅速缩小。建议做多模态方向的团队开始在自己的场景上做对比实验,而不是默认adapter就够用。