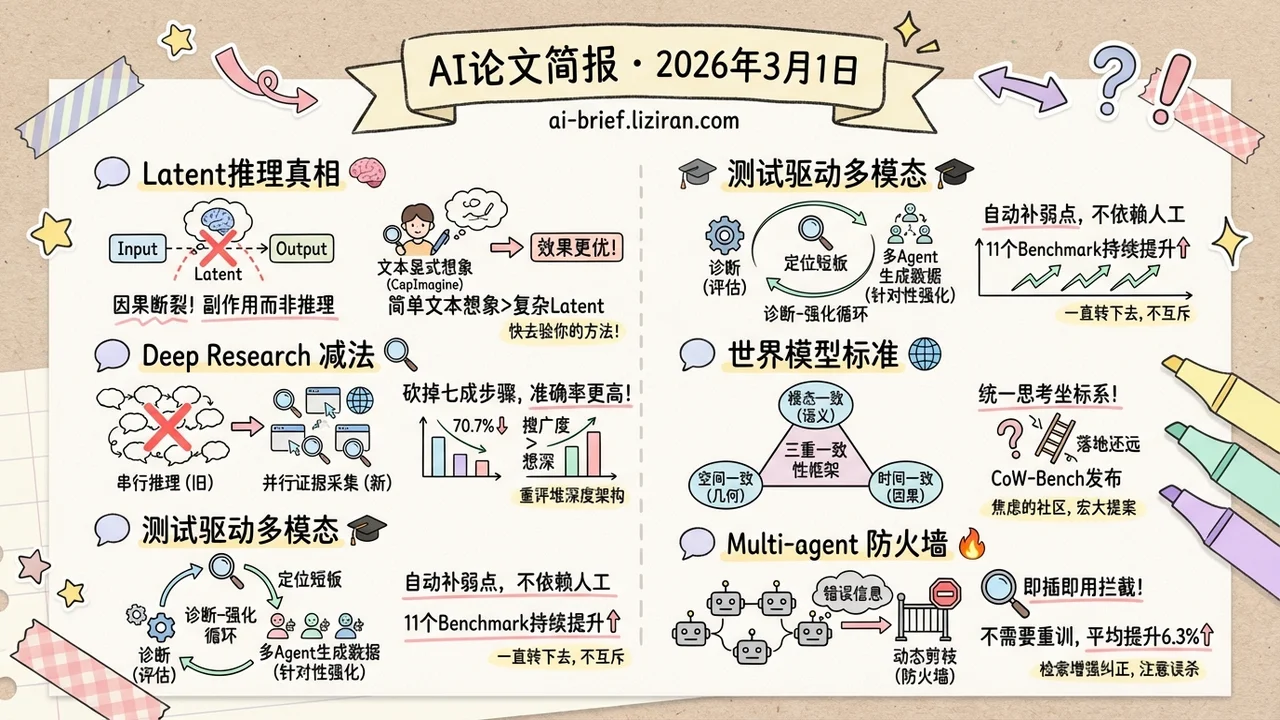

今日概览

- Latent推理的性能提升来自副作用而非推理本身,因果中介分析显示latent token与输入输出之间存在因果断裂,用文本做显式想象的简单方案反而更优

- Deep research agent砍掉七成推理步骤反而更准:并行证据采集替代串行推理链,搜索广度比推理深度更值得投入

- 教育心理学的「测试驱动纠错」被搬进多模态训练,诊断-强化循环让模型自动定位弱点并生成针对性数据。11个benchmark持续提升且不互相干扰

- 世界模型的「合格标准」有了框架但离落地还远——三重一致性(模态、空间、时间)提供了统一思考坐标系,184个HF upvotes更多反映社区焦虑

- Multi-agent错误传播有了即插即用的防火墙,推理时动态剪枝拦截错误信息流,不需要重训或改拓扑,平均提升6.3个百分点

重点关注

01 多模态 Latent推理的性能提升,可能跟「推理」本身无关

今年多模态领域最火的方向之一是latent visual reasoning——让模型在隐藏状态里「想象」,模拟人类的视觉推理过程。听起来很优雅,但这篇工作用因果中介分析(Causal Mediation Analysis)把这个过程拆开后,发现了两个让人意外的断裂:第一,对输入做大幅扰动,latent token几乎不变——说明它们根本没在认真「看」输入;第二,对latent token做扰动,最终答案也不怎么变——说明这些token对输出的因果影响微乎其微。进一步的探测实验显示,latent token编码的视觉信息很少,而且彼此高度相似。换句话说,模型确实在latent空间里做了「某些事」,但这些事大概率不是推理,更像是额外计算量和注意力模式带来的副作用。作者提出了一个朴素的替代方案CapImagine——直接用文本做显式「想象」,在视觉推理基准上显著超过了那些复杂的latent空间方法。对所有在做latent reasoning的团队来说,这个因果分析值得认真审视:你的方法是否也需要验证,性能提升到底来自哪里。

原文:Imagination Helps Visual Reasoning, But Not Yet in Latent Space

02 Agent 推理步骤砍掉七成,准确率反而更高?

Deep research agent的主流做法是加深推理链——一步步想透再行动。SMTL反过来:把串行的长链推理拆成并行的证据采集,在有限上下文窗口内高效管理信息。在BrowseComp上,推理步骤比Mirothinker-v1.0减少70.7%,准确率反而更高(48.6%)。框架还引入了统一的数据合成流水线,让同一个agent能同时处理确定性问答和开放式调研,GAIA 75.7%、Xbench 82.0%都达到了同级最优水平。训练方式是SFT加RL,整体思路是用搜索广度换推理深度——搜得更多,想得更少。

原文:Search More, Think Less: Rethinking Long-Horizon Agentic Search for Efficiency and Generalization

03 训练优化 把「诊断-纠错」循环引入大模型训练流程

「测试驱动的纠错优于重复练习」——这个教育心理学的经典发现,被DPE(Diagnostic-driven Progressive Evolution)直接搬进了多模态大模型的训练流程。具体做法是在训练中加入一个螺旋式的诊断循环:先用当前模型跑一轮评估,定位哪些能力是短板,然后用多个Agent自动生成针对这些短板的训练数据——包括调用搜索引擎和图像编辑工具来构造更真实多样的样本。每轮训练结束后重新诊断,再针对新暴露的弱点生成下一批数据。在Qwen3-VL-8B和Qwen2.5-VL-7B上跑了11个benchmark,持续稳定提升,没有出现常见的「补了这边塌了那边」的问题。关键是这套循环可以一直转下去,不需要人工干预数据配比。

原文:From Blind Spots to Gains: Diagnostic-Driven Iterative Training for Large Multimodal Models

04 多模态 世界模型需要什么才算「合格」?这篇论文给了一个框架,但答案还远

Sora之后,「世界模型」成了热词,但没人说得清一个世界模型到底该满足什么条件。这篇论文试图回答这个问题,提出「三重一致性」框架:模态一致性(语言、视觉等不同模态的语义对齐)、空间一致性(几何关系的正确性)、时间一致性(因果推理的连贯性)。框架本身有启发性——它把散落在各个子领域的评价标准拉到同一个坐标系下,还配套发布了CoW-Bench来统一评估视频生成和多模态模型。但184个HF upvotes更多反映的是社区对这个问题本身的焦虑,而不是这篇论文已经解决了什么。作为理论框架,它的价值完全取决于后续能否指导具体的模型设计——目前来看,更像是一个有雄心的提案,而非可操作的工程路线图。

原文:The Trinity of Consistency as a Defining Principle for General World Models

05 Agent 即插即用的错误传播防火墙:AgentDropoutV2

Multi-agent系统有个结构性痛点:一个agent输出了错误信息,后续agent基于这个错误继续推理,错误被逐层放大。现有方案要么重新设计agent拓扑,要么fine-tune模型,部署成本都不低。AgentDropoutV2换了个思路:在推理阶段加一层「主动防火墙」,拦截每个agent的输出,用一个基于检索增强的纠正器(retrieval-augmented rectifier)来识别和修复错误——修不了的直接丢弃,防止污染下游。关键设计是用历史失败模式作为先验知识来定位潜在错误,并且能根据任务难度动态调整纠正力度。在数学推理benchmark上平均提升6.3个百分点,不需要重训,即插即用。

也值得关注

今日观察

今天有三篇独立的工作在做同一类操作:把一个看起来合理的技术解释拆开,检查实际机制是否和表面叙事一致。Imagination那篇用因果中介分析发现latent reasoning的性能提升来自注意力模式的副产品,不是latent空间的推理能力。SMTL发现deep research agent堆推理深度的收益远不如铺证据宽度。Scale Can't Overcome Pragmatics则指出VLM推理能力的短板根源在训练数据——人类描述图像时会省略「显而易见」的信息,这种reporting bias直接传导给了模型,跟模型本身的推理能力没有直接关系。

三篇论文拆的对象不同,但暴露的思维模式是同一个:一个方法有效→假设一个看起来合理的原因→沿着这个假设加倍投入。问题在于「看起来合理」不等于「因果成立」。Latent reasoning的case尤其典型:如果不做因果分析,团队可能会继续投入更大的latent空间、更复杂的想象机制,而真正起作用的只是额外的计算量。

这个判断框架对日常技术决策有直接用处:下次某个方法在你的项目里跑出了好结果,花半天做一个消融实验,确认性能提升的真实来源,再决定往哪个方向加倍投入。半天的验证成本,可能帮你省掉几周走错方向的代价。