今日概览

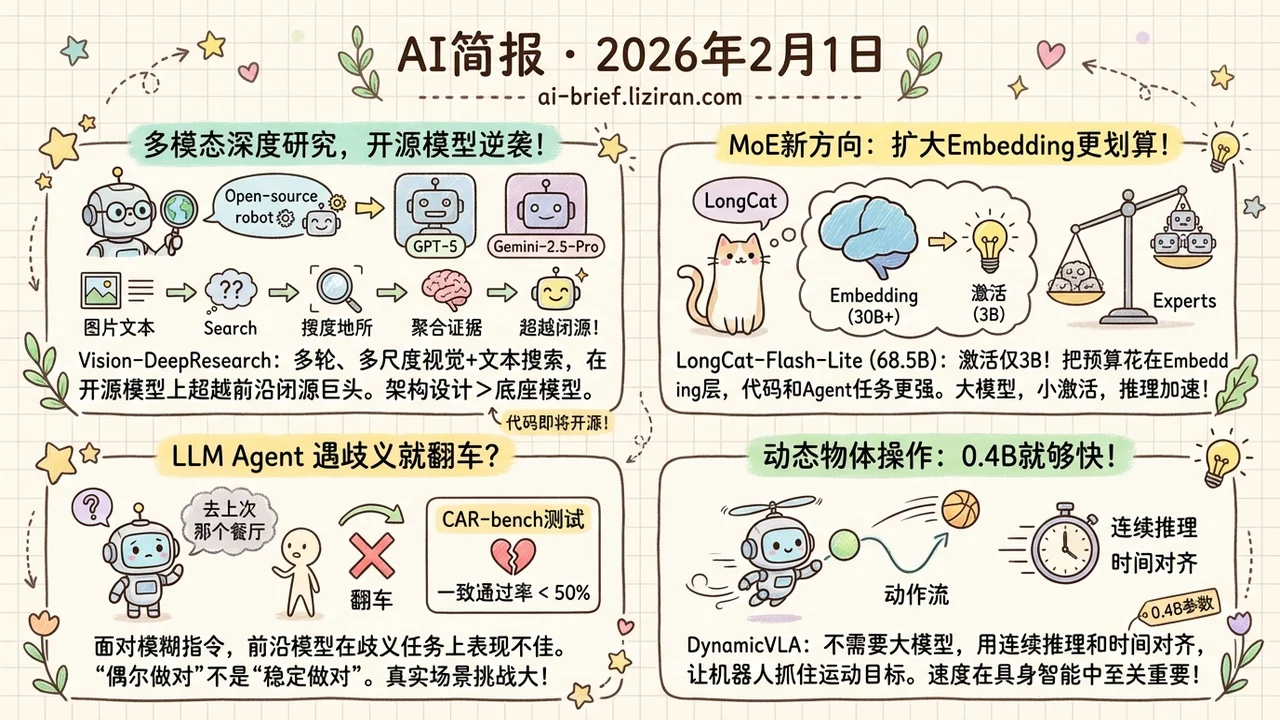

- 多模态深度研究不再是闭源大模型的专利,Vision-DeepResearch通过多轮、多实体、多尺度的视觉+文本搜索,在开源模型上超越GPT-5和Gemini-2.5-Pro

- MoE模型的扩展方向可能搞反了。扩大embedding比增加expert更划算,LongCat-Flash-Lite用68.5B参数(激活仅3B)在代码和Agent任务上超越同规模MoE

- LLM Agent在理想场景下表现不错,但一遇到模糊指令就大面积翻车:CAR-bench测试显示前沿推理模型在歧义任务上的一致通过率不到50%

- 动态物体操作不需要大模型,0.4B参数就够了。DynamicVLA用连续推理和时间对齐的动作流让机器人抓住运动中的目标

重点关注

01 多模态 开源模型做「深度研究」能打赢闭源大模型吗?

当前的多模态搜索框架有个隐含假设:用一张图和几条文本查询就能找到答案。但现实场景中图片里有大量无关信息,一次检索根本不够。Vision-DeepResearch把「深度研究」范式搬到了多模态领域——模型可以进行几十轮推理、上百次搜索引擎交互,从多个图片区域和文本源逐步聚合证据。训练方式也不是简单的prompt工程,而是冷启动监督+RL训练,把深度搜索能力内化到模型权重中。结果是在多模态研究任务上超越了基于GPT-5、Gemini-2.5-Pro和Claude-4-Sonnet构建的工作流。代码即将开源。

原文:Vision-DeepResearch: Incentivizing DeepResearch Capability in Multimodal Large Language Models

02 模型架构 MoE该扩expert还是扩embedding?答案可能和直觉相反

Mixture-of-Experts已经是稀疏扩展的标准路线,但收益递减和系统瓶颈越来越明显。这篇论文探索了一个正交方向:把参数预算花在embedding层而非expert层。LongCat-Flash-Lite是一个68.5B参数的模型,激活参数仅约3B,其中超过30B参数分配给了embedding。听起来反直觉,但在同等激活参数下,它不仅超过了等参MoE基线,在Agent和代码任务上还表现出了超预期的竞争力。配合投机解码,这种稀疏性可以直接转化为推理加速。

原文:Scaling Embeddings Outperforms Scaling Experts in Language Models

03 评测 前沿推理模型为什么搞不定车载语音助手?

现有Agent基准测试的问题是太理想化——指令清晰、工具齐全、信息完整。但真实用户不会说「导航到北京市朝阳区XX路XX号」,他们会说「去上次那个餐厅」。CAR-bench针对这种真实场景设计了58个互联工具和两类刁钻任务:歧义消解(用户指令不完整,需要追问或内部查询)和幻觉检测(缺少工具或信息时能否承认做不到)。结果很残酷:即使是前沿推理模型,在歧义消解任务上的一致通过率也不到50%,要么不追问就直接行动,要么在缺少工具时编造信息来满足用户。

原文:CAR-bench: Evaluating the Consistency and Limit-Awareness of LLM Agents under Real-World Uncertainty

04 机器人 0.4B参数能让机器人抓住飞来的物体吗?

VLA(Vision-Language-Action)模型擅长静态抓取,但遇到运动中的物体就力不从心——感知延迟、缺乏时间预判、控制不够连续。DynamicVLA从三个层面解决问题:用卷积视觉编码器做快速多模态推理(0.4B参数保证速度);推理和执行重叠进行(Continuous Inference),降低感知-行动延迟;通过Latent-aware Action Streaming在时间维度上对齐感知和动作执行。配套发布的DOM基准包含20万合成episodes和2000个真实场景数据,实现了无需遥操作的快速数据收集。

原文:DynamicVLA: A Vision-Language-Action Model for Dynamic Object Manipulation

也值得关注

今日观察

今天至少三篇论文在挑战「越大越好」的直觉。LongCat-Flash-Lite把参数往embedding而非expert堆,DynamicVLA用0.4B模型做到了动态操作,MMFineReason只用7%的数据就逼近全量效果。共同指向的规律是:参数和数据的分配策略可能比绝对规模更重要。正在做模型训练和数据配比的团队,值得重新审视自己的资源分配是不是落入了「均匀撒胡椒面」的惯性。