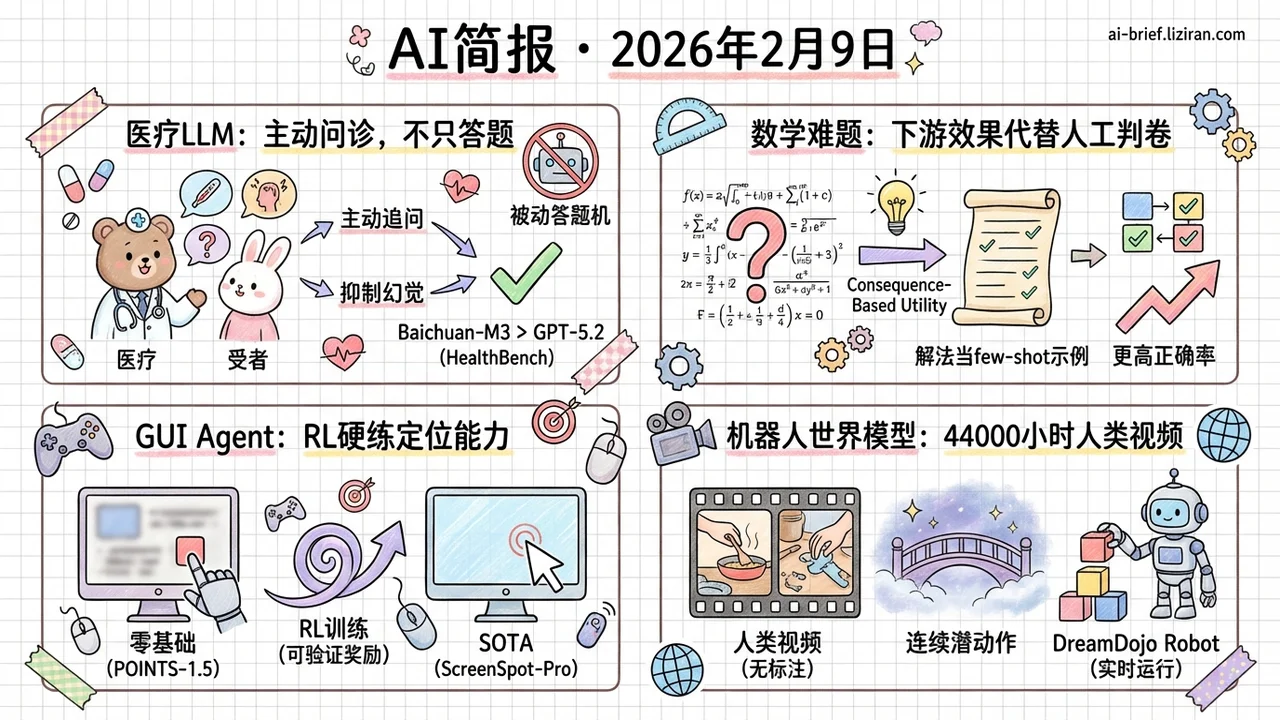

今日概览

- 医疗LLM不该只答题,应该像医生一样主动问诊。Baichuan-M3在HealthBench上全面超越GPT-5.2,关键不是模型更大,而是训练了主动追问和抑制幻觉的临床工作流

- 研究级数学难题没有标准答案怎么评分?用解法的「下游效果」代替人工判卷,Consequence-Based Utility把候选解当成few-shot示例去解相关题,好解法自然带来更高正确率

- GUI Agent的定位能力可以用RL硬练出来。POINTS-GUI-G从几乎零基础练到ScreenSpot-Pro SOTA,证明RL的可验证奖励在感知任务上同样有效

- 44000小时人类视频训出机器人世界模型,DreamDojo用连续潜动作绕开动作标注稀缺问题,蒸馏后实时运行,支持遥操作和策略规划

重点关注

01 安全对齐 医疗LLM不该只答题,应该像医生一样追问

现有的医疗LLM有个根本问题:它们是「被动答题机」。你问什么它答什么,但真正的临床决策不是这样的——医生会主动追问、排除、综合,不会在信息不全时就下结论。Baichuan-M3的训练方式模拟了这个流程:主动追问以消除歧义、长程推理整合分散证据、以及一个专门的幻觉抑制机制确保事实可靠性。在HealthBench上,它在临床问诊、建议和安全性三个维度都显著超过GPT-5.2。模型已开源,这对做医疗AI产品的团队来说是一个可以直接测试的基线。

原文:Baichuan-M3: Modeling Clinical Inquiry for Reliable Medical Decision-Making

02 评测 研究级数学没有标准答案,怎么判断解法对不对?

数学推理模型越来越强,但验证它们在前沿数学问题上的输出仍然极其困难——这些题往往没有公认答案,只能靠数学家人工审查。Consequence-Based Utility提出了一个巧妙的替代思路:如果一个解法是对的,它里面包含的方法论信息应该能帮助解决相关的、可验证的题目。具体做法是把候选解当成in-context示例喂给模型去做相关题,好的解法自然带来更高的下游正确率。在GPT-OSS-120B上,这个方法把Acc@1从67.2提到76.3,AUC从71.4提到79.6,显著优于reward model和LLM-as-judge等方案。

03 Agent GUI Agent精准点击,RL在感知任务上也能发力

GUI Agent要在真实界面上完成任务,第一步是「看得准」——精确定位按钮、文本框、图标等元素。大部分工作直接在已有强空间感知能力的模型(如Qwen3-VL)上微调,POINTS-GUI-G反其道而行,从一个几乎没有grounding能力的基座模型POINTS-1.5出发,走完了从数据工程到RL训练的全流程。三个关键:统一多源开源数据集并做难度分级、持续微调视觉编码器提升感知精度、用可验证奖励的RL做最后的精度提升。最终在ScreenSpot-Pro上拿到59.9(SOTA),ScreenSpot-v2上95.7。值得注意的是,RL在这里不是用来增强推理,而是提升感知精度——GUI grounding天然适合RL,因为奖励容易验证。

原文:POINTS-GUI-G: GUI-Grounding Journey

04 机器人 44000小时人类视频,能训出通用机器人世界模型吗?

训练机器人的世界模型(world model)——即「给定动作,预测环境会怎么变」——最大的瓶颈是数据:机器人采集的带动作标注的数据太少太窄。DreamDojo的解法是从人类视频里学。44000小时的第一人称视频涵盖了大量日常场景和精细操作,但没有动作标注。核心技巧是引入连续潜动作(continuous latent actions)作为统一的代理动作表示,让无标注视频中的交互知识能迁移到机器人域。在小规模目标机器人数据上post-training后,模型展现出对物理规则的理解和精确的动作控制。经过蒸馏加速到实时10.81FPS,支持遥操作、策略评估和基于模型的规划。

原文:DreamDojo: A Generalist Robot World Model from Large-Scale Human Videos

也值得关注

今日观察

今天有两条值得注意的线索。一是RL的可验证奖励正在从推理向感知扩展:POINTS-GUI-G用RL提升GUI定位精度,VowelPrompt用GRPO训练情绪识别,加上近期在代码生成、数学推理上的持续进展,RL with verifiable rewards正在成为一种通用的能力提升范式,不再局限于逻辑推理任务。二是GRPO的各种缺陷正在被密集修补——F-GRPO修正了稀有解遗忘,上一期LUSPO修了长度偏差,EBPO修了baseline方差——做RL训练的团队建议持续关注这些修正工作,它们对训练稳定性的影响往往比换更大模型更直接。