今日概览

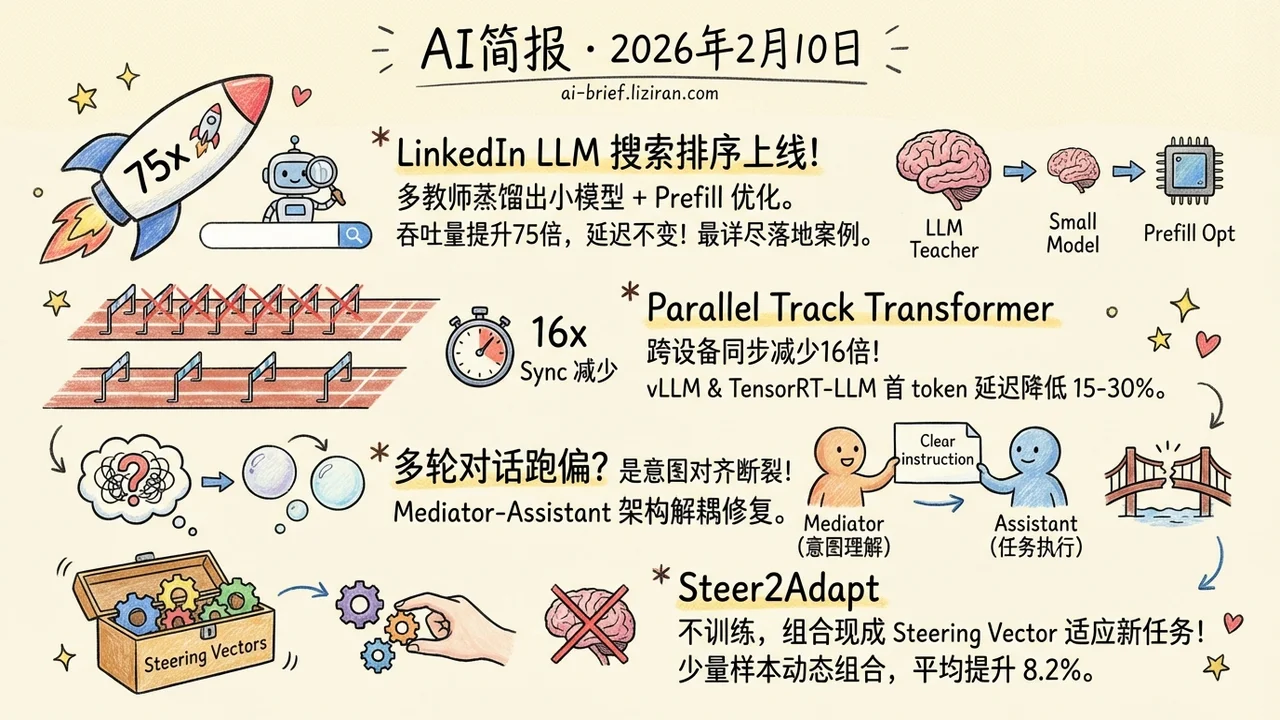

- LinkedIn把LLM搜索排序做到了上线水平,多教师蒸馏出小模型配合prefill优化,排序吞吐量提升75倍且延迟不变,这是目前公开的最详尽的LLM搜索落地案例之一

- 多GPU推理的同步开销一直是瓶颈,Parallel Track Transformer把跨设备同步减少16倍,在vLLM和TensorRT-LLM上实测首token延迟降低15-30%

- 多轮对话越聊越偏?问题不是模型能力不够,而是意图对齐出了结构性断裂,Mediator-Assistant架构通过解耦意图理解和任务执行来修复

- 不微调、不训练,只靠组合现成的steering vector就能让LLM适应新任务,Steer2Adapt用少量样本动态发现最佳组合,平均提升8.2%

重点关注

01 检索 LinkedIn把LLM搜索排序做到了上线标准,靠什么?

用LLM做搜索排序效果好,但推理延迟根本没法上线——这是所有想把LLM塞进搜索系统的团队都面对的问题。LinkedIn的解法分两步:先用LLM relevance judge做教师,再把embedding检索和一个蒸馏出的小语言模型组合成轻量级ranking系统,同时优化relevance和用户engagement两个目标。推理侧针对prefill阶段做了专门架构设计,配合模型剪枝和上下文压缩,在延迟约束不变的前提下排序吞吐量提升超75倍。这套方案已经在AI Job Search和AI People Search上线,是目前公开文献中最完整的LLM搜索落地实践之一。做搜索/推荐的团队值得仔细读——从蒸馏策略到serving架构都有可复用的工程细节。

原文:Semantic Search At LinkedIn

02 推理加速 多GPU推理每一步都要同步,能不能少同步点?

Tensor parallelism是大模型多卡推理的标配,但它有个痛点:每个矩阵乘法都要跨GPU all-reduce同步一次,卡越多通信开销越大。Parallel Track Transformer重新设计了计算图的拆分方式,让各设备上的计算轨道尽量独立运行,把同步操作减少到原来的1/16。关键是这不是一个近似方案——模型质量在实验中保持竞争力。集成到TensorRT-LLM和vLLM后实测:首token延迟降低15-30%,每token生成时间降低2-12%,吞吐量最高提升31.9%。对于正在做多卡serving的团队,这是一个值得关注的架构级优化方向。

原文:Parallel Track Transformers: Enabling Fast GPU Inference with Reduced Synchronization

03 Agent 多轮对话越聊越偏,是模型的锅还是交互的锅?

用过ChatGPT的人大概都有这个体验:追问几轮后模型开始「跑偏」,回答和你想要的越来越远。之前的研究管这叫「Lost in Conversation」,归因于模型能力不足。这篇论文给出了不同的诊断:问题的根源是意图对齐的结构性断裂,而非模型能力缺陷。作者从理论上论证了单靠增大模型或改进训练解决不了这个问题,因为对话上下文本身存在结构性歧义。他们提出的Mediator-Assistant架构把「理解用户到底想要什么」和「执行任务」分开——Mediator基于历史交互模式把模糊的用户输入翻译成明确的结构化指令,再交给Assistant执行。对做聊天产品或Agent系统的团队有直接参考价值。

原文:Intent Mismatch Causes LLMs to Get Lost in Multi-Turn Conversation

04 训练优化 不训练不微调,组合现有steering vector就能适配新任务?

Activation steering(在模型内部激活方向上做干预)是一种很轻量的LLM控制手段,但现有方法每个任务只用一个静态方向,碰到复杂任务就力不从心。Steer2Adapt的思路是:很多任务共享少数底层概念维度(比如推理能力、安全性),与其从头学新的steering vector,不如维护一个可复用的低维语义先验子空间,新任务来了就用少量样本动态发现最佳的线性组合。跨9个任务和3个模型的实验显示平均8.2%的提升,而且数据效率高、稳定性好。这是一个纯推理时的适配方法,不改模型权重,适合需要快速切换任务但又不想为每个场景微调的应用。

原文:Steer2Adapt: Dynamically Composing Steering Vectors Elicits Efficient Adaptation of LLMs

也值得关注

今日观察

今天没有高分highlight论文,但两篇来自LinkedIn的工业实践(语义搜索和用户表征)透露了一个信号:大厂正在密集验证「LLM judge蒸馏→小模型上线」这条路径在搜索和推荐场景的可行性。如果你在做搜索/推荐系统的LLM升级,LinkedIn这套从蒸馏到serving优化的全栈方案是目前最值得参考的公开案例。